1.11 数据集成的其他方式

使用数据虚拟化可以集成数据,但是这并不是集成来自不同数据存储中数据的唯一方式。正如1.4节所讲,存在不同的技术方法来集成数据,包括ETL、ELT和复制。本节会简要解释这些其他方式,更多信息参见2.7节。

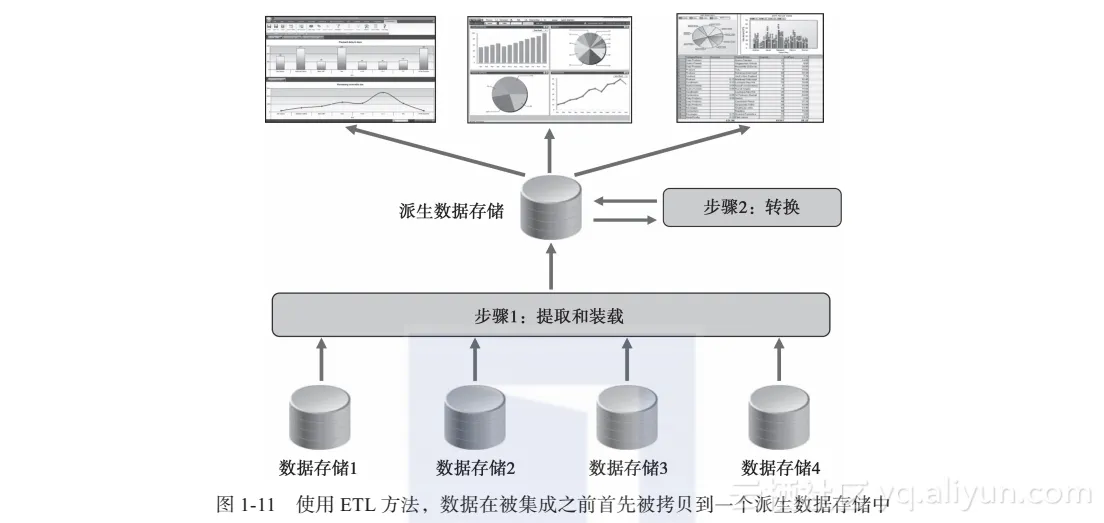

ETL(提取-转换-装载)是数据集成的一种方式,它在数据仓库环境中被大量使用。使用ETL,集成化可以通过从多个源数据存储中复制数据来实现,通过将集成的、转换的结果存储在独立的目标数据存储中来实现。保留集成化数据需要后者。目标数据存储可能是数据使用者正在访问的数据存储(如图1-10所示)。因为目标数据存储中的所有数据都是以某种方式从源数据存储中的数据导出的,所以它也被称为派生数据存储。

在复制过程中,数据被结合、转换和清洗。通常这个复制过程是预先安排好的。在确定的时间间隔内,新数据从数据源里被提取出来,集成并存储到派生数据存储中。如果数据虚拟化提供按需集成,那么ETL提供预定好的集成。

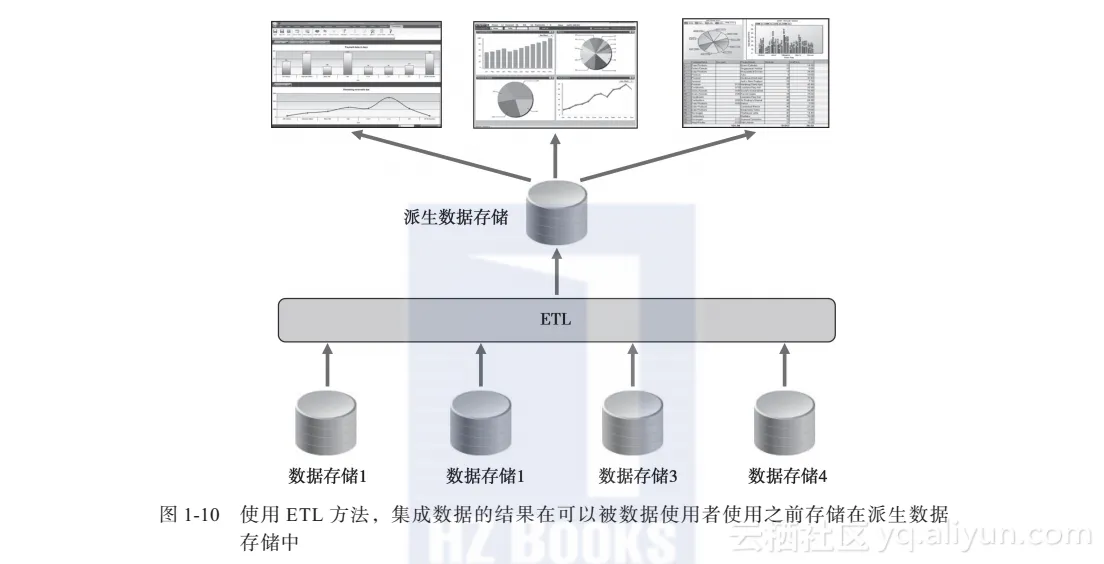

ELT(提取-装载-转换)从某种程度上来讲是ETL的一种特殊版本。通过ELT,数据仍然是被拷贝到一个派生的数据存储里并且转换也是预定好的。ETL和ELT的主要区别是动作执行的顺序。在ETL中,在派生数据存储中的数据已经被转换和清洗。在ELT中,提取的数据首先被存储在派生数据存储中,随后被转换和清洗,这导致了存储的第二种形式(如图1-11所示)。从某种程度上来讲,所有数据都被存储两遍。

第三种数据集成方法叫作复制。鉴于ETL和ELT,复制过程是预先安排好的,并且分批传送数据,当源数据已经被插入或现存数据已经被更新或删除,复制就开始了。实际上,就在这个改变发生之后,数据就会被复制到一个目标数据存储中。所以数据不是被分批复制的,而是或多或少地作为独立记录或小组记录。通常,复制只需要几微秒。

因为通过复制,拷贝就发生在源数据被改变之后,并且因为拷贝进程本身的速度是非常快的(只有一些记录),目标数据存储中的数据有一个非常低的接近于最新的延时。

复制通常被归类为一种数据集成技术,但这实际上可能不正确。尽管一些数据复制技术可以从多个数据源中复制并集成数据,但这不是它的强项。换句话说,复制与其说是一种数据集成技术,不如说是一种具有有限集成和转换特征的快速数据拷贝技术。实际上,复制的强项是拷贝数据的速度和保持目标数据存储中数据与源数据存储中数据同步的能力。