AI能做电影解说视频吗?

这个问题在2024年之前,答案是"勉强能,但质量很差"。到了2026年,答案变成了"能,而且质量接近人工"。

但很少有人知道,一个看似简单的"AI电影解说视频",背后涉及的技术链路有多复杂:视频理解、剧情摘要、文案生成、语音合成、视频剪辑、时间轴对齐……每一环都是独立的AI任务,每一环都有技术难点。

这篇文章拆解AI电影解说的完整技术链路,重点讲清楚每个环节的技术选型逻辑,以及为什么这个看似简单的任务对AI来说是个硬骨头。

为什么AI很难做好一个电影解说视频?

本质上,这是多个AI任务的串联,而且每个任务都有很高的技术门槛。

输入:一部电影(视频文件 + 剧情信息)

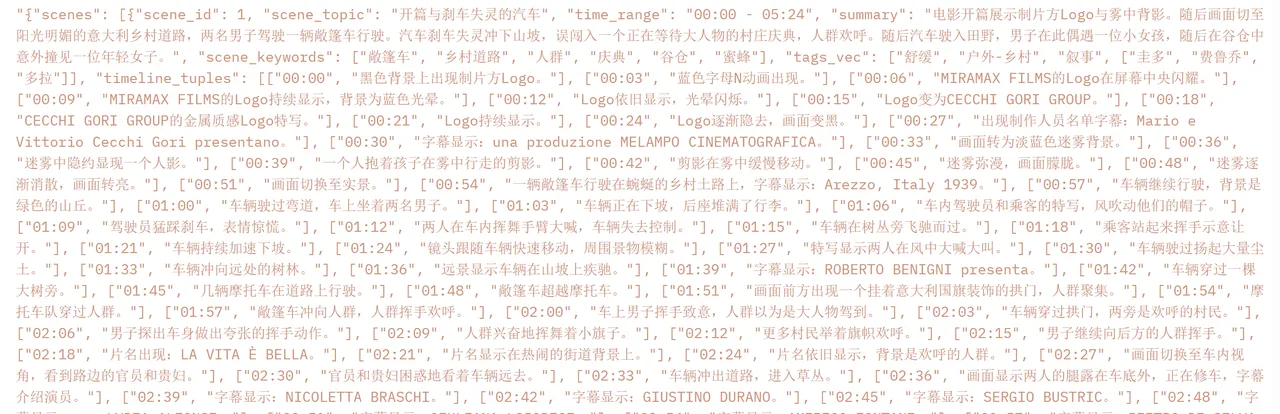

【任务1】视频理解(多模态)→ 理解画面内容、人物关系、剧情发展

【任务2】剧情摘要(文本生成) → 提取关键情节、压缩剧情线

【任务3】文案生成(风格化写作) → 生成符合特定风格的解说文案

【任务4】语音合成(TTS) → 生成带情感的配音

【任务5】视频剪辑(时序建模)→ 选择关键片段、卡点、转场

【任务6】时间轴对齐(同步控制)→ 配音时长与画面片段精确匹配

输出:完整的电影解说视频

这些任务之间有强依赖关系——前一步的输出质量直接影响后一步的效果。

举个例子:如果【任务1】视频理解出错,把男主角误认为反派,那么【任务2】剧情摘要就会错,【任务3】文案生成也会错,最终整个视频都是错的。

这就是为什么AI很难做好电影解说——不是单点技术难,而是全链路都难。

AI电影解说技术链路拆解:6个核心环节

环节1:多模态AI视频理解技术

核心问题:让AI"看懂"一部电影

这里有三个技术方案,选型逻辑是递进的:

CLIP(OpenAI,2021)能做图文匹配,但它的训练目标是单帧图像与文本对齐,没有跨帧的时序信息。用它理解"男主角从失意到振作"这样的剧情弧线,就像用词典翻译来理解一首诗——每个词都认识,但整体意思抓不住。

Video-LLaMA(2023)引入了Video Q-Former模块,把视频帧序列压缩成视觉token送入语言模型,能建模帧间的时序关系,理解"前因后果"。代价是计算量大,一部2小时电影在单卡A100上推理约需20-40分钟。

Gemini 1.5 Pro(Google,2024)用100万token的长上下文窗口直接处理视频帧序列和音频转录,不需要单独的视频编码模块,在人物关系理解和剧情伏笔识别上效果最好。缺点是不开源,API成本较高。

注:早期Gemini 1.0(2023年底)的视频理解能力相当有限,真正可用于电影解说场景的是Gemini 1.5 Pro(2024年2月)之后的版本。

电影解说的难点不是"描述画面",而是理解人物动机、剧情伏笔、情感转折——这需要长时序建模和因果推理,是当前多模态模型的核心瓶颈。

环节2:AI剧情摘要与内容压缩

核心问题:把2小时电影压缩成3分钟解说(压缩比约25:1)

方案1:基于规则的关键情节提取

定义"关键情节"的判断规则:

- 剧情转折点(主角做出重要决定)

- 情感高潮点(主角情绪爆发)

- 冲突点(主角与对立方正面交锋)

根据这些规则,从视频理解的输出中提取关键情节,过滤掉铺垫性场景。

优点是可控性强,缺点是规则难以覆盖所有类型的电影,尤其是文艺片和非线性叙事的电影。

方案2:基于LLM的智能摘要

基于LLM的智能摘要效果更好,但有一个内在矛盾:悬疑片的解说要保留悬念,但又要讲清楚剧情——"说多少"本身就是一个需要类型感知的判断,通用LLM在这类边界情况上表现不稳定。

环节3:AI文案生成与风格化写作

核心问题:给剧情骨架加上情感、节奏、吸引力

方案1:基于模板的文案生成

模板方案(预设钩子结构 + 槽位填充)风格统一但容易模板化;

方案2:基于LLM的风格化生成

LLM + Prompt工程的方案灵活性更强,但需要同时满足三个约束:风格化写作、节奏控制(3分钟朗读量约450字)、平台适配(抖音短句 vs B站长句)。三者同时满足,Prompt设计的工程量不小。

环节4:AI语音合成(TTS技术)

核心问题:生成带情感的配音,而不是"机器人朗读"

文案写好了,但配音不能是"机器人朗读",要有"演技"。

当前最佳方案:零样本声音克隆 + 情感控制

代表技术: - VALL-E(微软,2023):基于神经编解码语言模型,只需3秒参考音频即可克隆声音

- CosyVoice(阿里,2024):支持多语言、情感标签控制、语速调节

- ElevenLabs:商业产品,效果稳定,支持情感强度调节

核心能力:

- 零样本克隆(只需3秒参考音频)

- 情感控制(可以指定"愤怒""温柔"等情感标签)

- 节奏控制(停顿、重音、语速变化)

电影解说的特殊挑战

解说文案的情感变化非常快:

- 前一句还在温柔叙述

- 下一句突然愤怒爆发

- 再下一句又变成委屈哭泣

需要逐句情感控制,而不是整段统一情感。目前大多数TTS系统的情感控制粒度还停留在段落级别,逐句控制是工程上的难点。

环节5:AI视频剪辑与智能匹配

核心问题:从原片中选出与文案语义匹配的画面片段

方案1:基于规则的片段匹配

定义匹配规则:

- 文案提到"男主角开车"→ 检索视频理解输出中标注为"开车场景"的片段

- 文案提到"情感爆发"→ 优先选择特写镜头

- 配音停顿处 → 插入转场

方案2:基于语义相似度的智能匹配

工作流程:

- 用视频理解模型为每个片段生成文本描述

- 用文本嵌入模型(如text-embedding-3)计算文案句子与片段描述的语义相似度

- 选择相似度最高的片段

- 根据配音时长,调整片段的播放时长(裁剪或补帧)

节奏感(快切 vs 长镜头)、情感匹配(配音悲伤时不能放喜剧画面)、卡点(重音处要有视觉冲击)——这些属于视频美学理解,是当前AI剪辑最薄弱的环节。

环节6:视频时间轴对齐与同步控制

核心问题:配音时长与画面片段精确匹配

需要说明的是,电影解说视频的时间轴对齐和影视配音(替换原片人物声音)是两个不同的问题。解说视频不需要嘴型同步,核心是配音时长和画面片段时长的匹配。

技术方案:动态时间规整(DTW)+ 语速调节

工作流程:

- 计算每段配音的时长

- 计算对应画面片段的时长

- 如果时长不匹配,在0.85x-1.15x范围内调整配音语速(超出这个范围会听起来不自然)

- 如果语速调整不够,则裁剪或延长画面片段(补帧或跳帧)

- 用DTW算法对齐配音的节奏重音点与画面的视觉冲击点

电影解说的特殊挑战

多语言版本的时长差异:

- 中文:"我爱你"(3个字,约0.8秒)

- 英文:"I love you"(3个词,约1.2秒)

同一段剧情,不同语言版本的配音时长可能相差20%-30%,需要动态调整画面片段的时长,同时不能破坏剧情节奏。

AI电影解说完整技术栈一览

① 视频理解 — 用 CLIP / Video-LLaMA / Gemini 1.5 Pro 看懂电影内容,难点在长时序建模和因果推理。

② 剧情摘要 — 用 LLM + 类型感知策略把2小时压缩成3分钟,难点在悬疑片"该说多少"的边界判断。

③ 文案生成 — 用 LLM + Prompt工程把剧情骨架变成解说文案,难点在风格、节奏、平台适配三者同时满足。

④ 语音合成 — 用 VALL-E / CosyVoice / ElevenLabs 生成带情感的配音,难点在逐句情感控制的粒度。

⑤ 视频剪辑 — 用语义相似度匹配 + 规则引擎从原片中选对片段,难点在视频美学理解(节奏感、情感匹配)。

⑥ 时间轴对齐 — 用 DTW + 语速调节让配音与画面时长精确匹配,难点在多语言版本的时长差异处理。

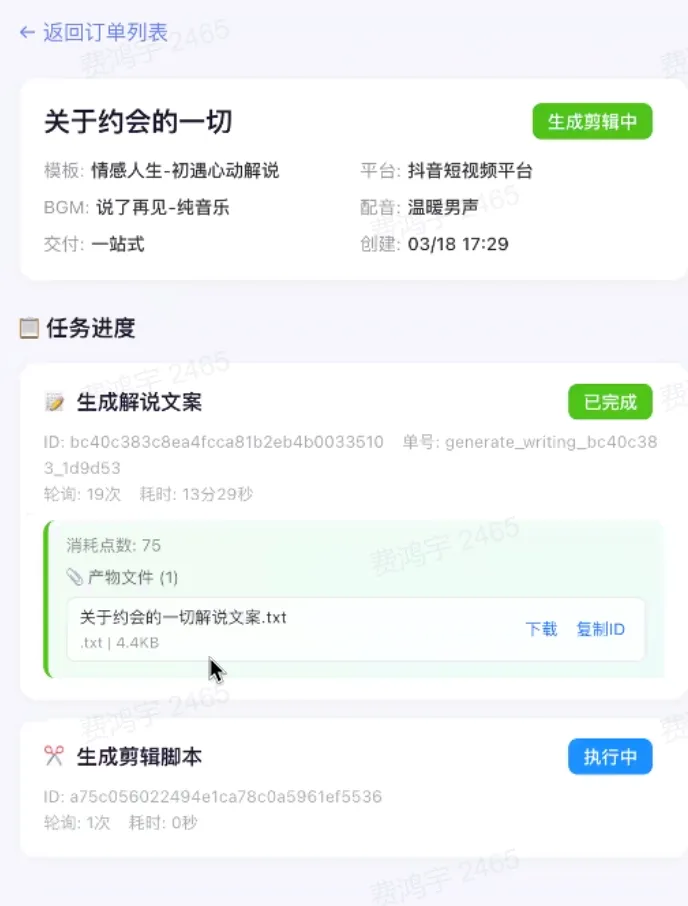

如果不想自己搭这套链路,可以直接试试 AI解说大师*叙影的电影解说功能——上传电影、选风格、一键出片,背后跑的就是这套技术栈的工程化实现,15分钟左右能出一条完整的解说视频。对于想快速验证效果、或者没有技术团队的创作者来说,是个省事的起点。

AI视频生成的未来趋势

实时AI视频生成:当前瓶颈在视频理解和渲染两端,突破点在更高效的视觉token压缩和边缘计算卸载。未来AI电影解说可能实现实时生成,1秒视频<1秒生成。

多模态AI联动:当前六个环节串行,误差逐步累积。未来方向是端到端训练,看到画面直接生成配音情感标签,Gemini 2.0的原生多模态输出是早期探索。

个性化AI风格定制:当前风格靠Prompt描述,未来可以提供参考视频,通过少样本学习迁移风格,让AI视频生成更符合个人需求。

交互式AI编辑:当前只能整体重新生成,未来方向是增量式更新——只重新生成被修改的片段,提升AI视频剪辑的效率。

总结:AI电影解说的技术难点与突破方向

AI电影解说看似简单,实则是六个AI任务的串联,每一环都有技术难点:

- 视频理解:CLIP只能处理单帧,Video-LLaMA能建模时序但计算量大,Gemini 1.5 Pro效果最好但不开源

- 剧情摘要:需要类型感知策略,通用LLM在悬疑片、非线性叙事上表现不稳定

- 文案生成:风格化写作 + 节奏控制 + 平台适配,三者同时满足有难度

- 语音合成:逐句情感控制是工程难点,大多数TTS系统还停留在段落级别

- 视频剪辑:语义匹配容易,视频美学理解(节奏感、情感匹配)是薄弱环节

- 时间轴对齐:多语言时长差异 + 语速调节边界,需要精细的工程处理

AI电影解说的技术栈还在快速演进,但核心目标始终是:让AI不只是"拼接素材",而是"理解电影、创作内容"。

参考资料

- Radford, A. et al. "Learning Transferable Visual Models From Natural Language Supervision." ICML 2021. (CLIP)

- Zhang, H. et al. "Video-LLaMA: An Instruction-tuned Audio-Visual Language Model for Video Understanding." EMNLP 2023.

- Team, G. et al. "Gemini 1.5: Unlocking multimodal understanding across millions of tokens of context." arXiv 2024.

- Wang, C. et al. "Neural Codec Language Models are Zero-Shot Text to Speech Synthesizers." ICLR 2023. (VALL-E)

- Du, Z. et al. "CosyVoice: A Scalable Multilingual Zero-shot Text-to-speech Synthesizer." arXiv 2024.