loss 是怎么一步步“骗”过工程师的

如果你做过大模型微调,几乎一定经历过这样一个时刻。

训练刚跑起来,你盯着屏幕上的 loss 曲线,看着它从一个比较高的值,慢慢、稳定地往下走。曲线很平滑,没有剧烈抖动,看起来一切都很健康。这时候你心里往往会产生一种非常强烈的安全感:

“这次应该稳了。”

但等你真正拿模型去测试时,问题就来了。

- 模型回答好像没什么变化

- 有时候甚至更奇怪了

- 你很难说清楚它到底“学到了什么”

这时候你会开始怀疑:

是不是数据不够多?

是不是训练还不够久?

是不是 learning rate 还要再调一调?

很少有人会在这个阶段反问一句:

有没有可能,是我一开始就不该把 loss 当成主要依据?

一个必须先说清楚的事实:loss 从来不是“效果指标”

这是整篇文章最重要的前提。

loss 的本质,是一个训练过程中的优化目标,而不是一个业务效果的衡量标准。

它回答的问题只有一个:

模型在多大程度上拟合了你给它的训练数据?

注意,这个问题里,没有“好不好用”,也没有“像不像你想要的”。

在预训练阶段,loss 非常重要,因为模型在学习语言本身;

但在微调阶段,尤其是 SFT / LoRA 这种微调里,loss 的解释力会急剧下降。

微调里,loss 在“很努力地干一件你并不关心的事”

这句话听起来有点刺耳,但非常真实。

在微调中,loss 在做的事情是:

尽可能让模型复现你给它的示例输出。

只要模型越来越像“背答案”,loss 就会下降。

至于这种“像”,是不是你真正想要的,那是另一个问题。

举个非常常见的例子。

你给模型准备了一批客服数据,希望它学会“更谨慎一点”。但这些数据里,恰好存在一些固定句式,比如大量出现“请您放心”“我们将尽快处理”。

模型非常聪明,它很快就学会:

只要多输出这些句子,就能显著降低 loss。

loss 会下降得非常好看,但你真正想要的“判断边界能力”,可能一点都没学到。

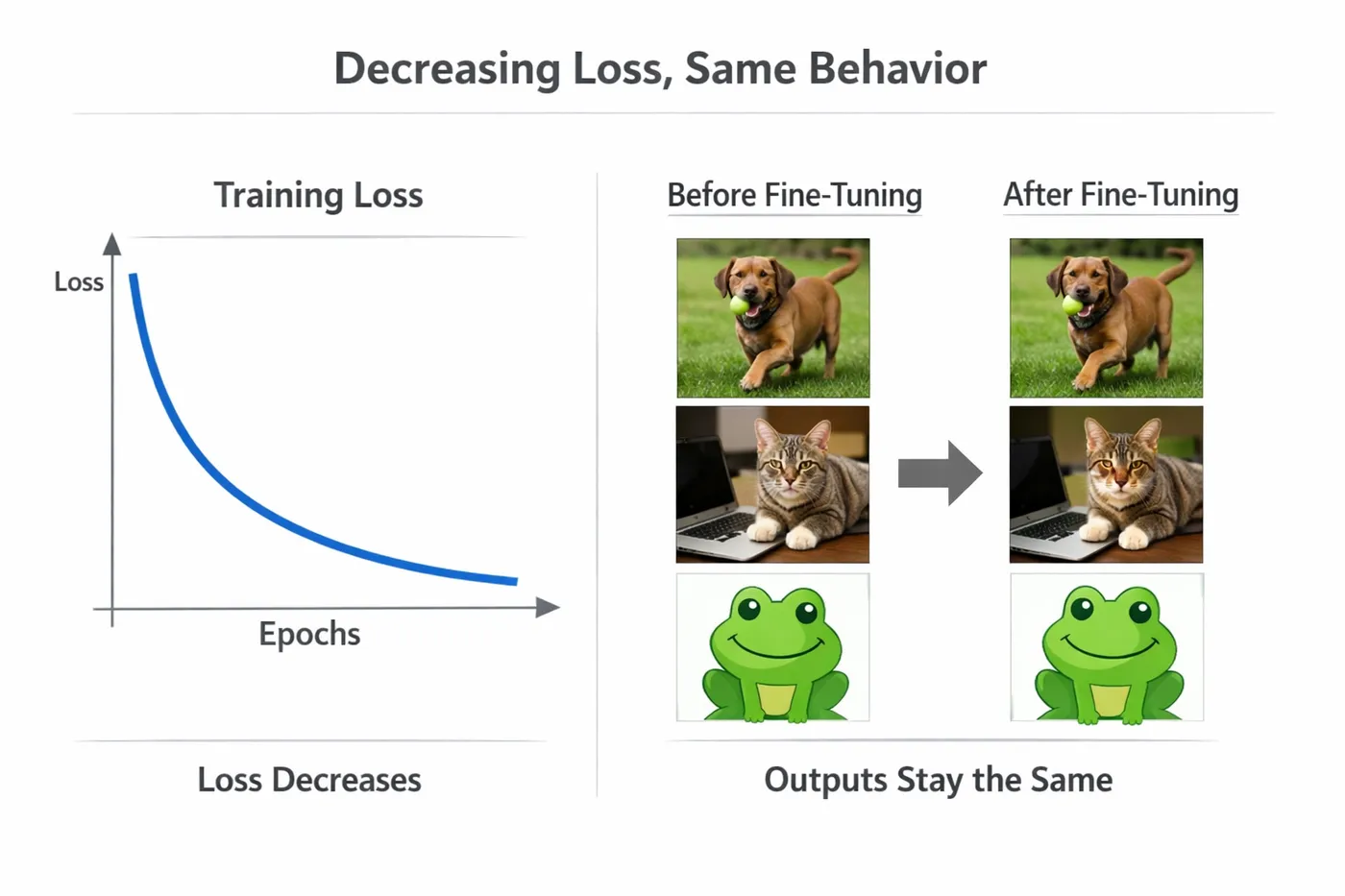

loss 下降但行为未变化的示意图

第一个典型误区:loss 降得快 ≠ 微调效果好

很多人第一次微调时,都会被一个现象“鼓舞”到。

loss 下降得非常快,甚至几百步就降了一大截。

这时候你会本能地觉得:

“模型学得好快!”

但在微调里,这往往不是好消息。

loss 降得越快,往往意味着一件事:

模型正在非常高效地记住你的示例。

如果你的数据规模很小、风格很统一,这种“快速记忆”几乎是必然的。但问题在于,记住示例 ≠ 学会泛化。

在真实测试中,你会发现模型只在“长得很像训练数据”的问题上表现不错,一旦问题稍微换个说法,效果就急剧下降。

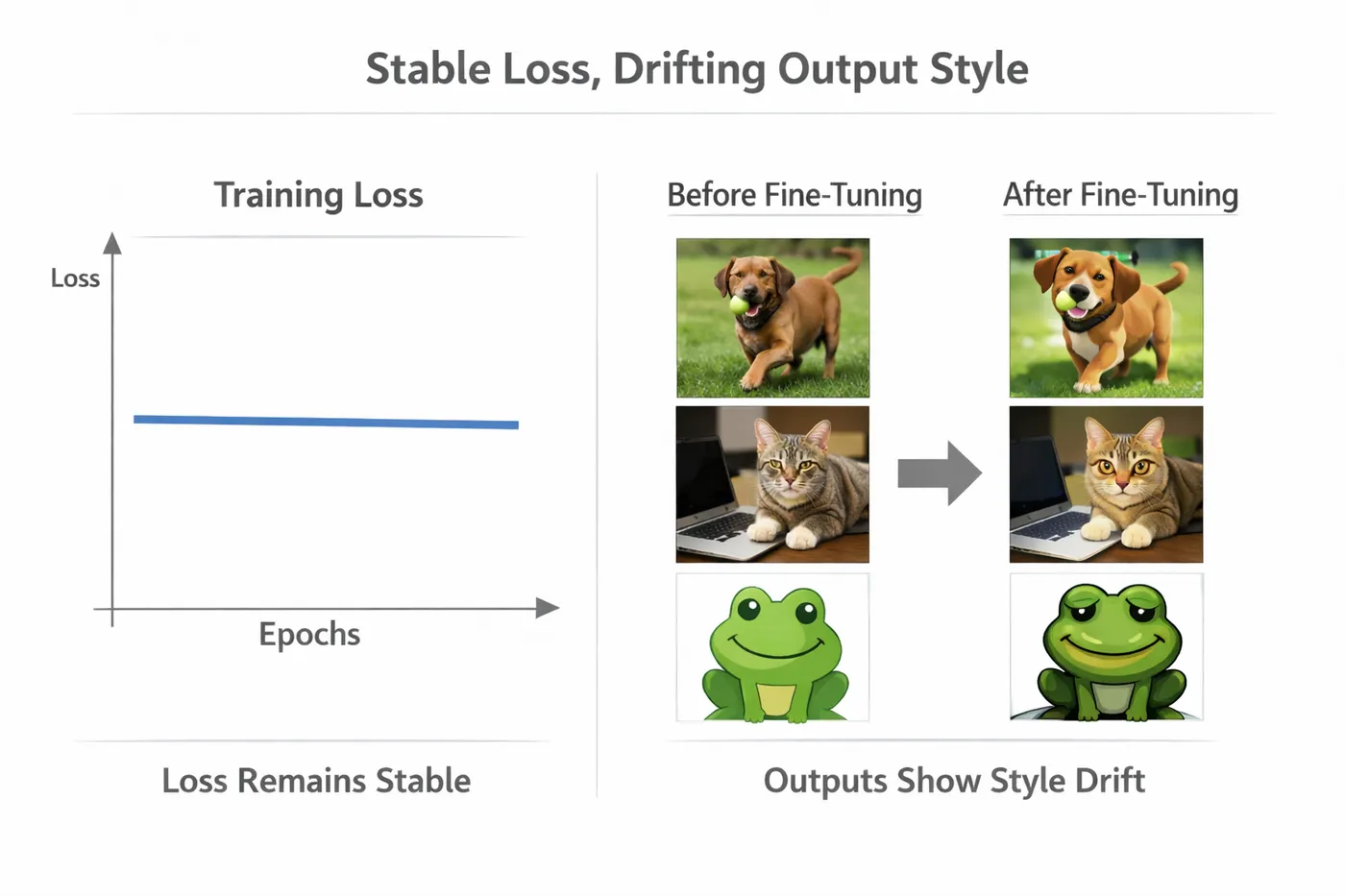

第二个典型误区:loss 稳定 ≠ 模型稳定

另一个非常容易让人放松警惕的情况是:

loss 曲线非常稳定,没有明显震荡。

这在很多教程里,被视为“训练健康”的标志。但在微调里,这个信号其实非常暧昧。

loss 稳定,只能说明:

训练过程在数值上是可控的。

它并不能告诉你:

- 模型行为有没有发生不可逆的偏移

- 模型是不是开始过度依赖某些模式

- 模型是不是在“牺牲原有能力换取拟合”

尤其是在 LoRA 微调中,这种“稳定但危险”的情况非常常见。

loss 稳定但输出风格漂移示意图

一个非常关键的现实:loss 只反映“训练分布内”的世界

这是 loss 在微调中解释力有限的根本原因。

loss 的计算对象,永远是你给它的训练数据。

也就是说,它只对“分布内表现”负责。

但你真正关心的,几乎永远是:

模型在真实使用场景下表现如何。

一旦训练数据和真实输入存在偏差,loss 就会立刻“失声”。

你会看到一个非常经典的现象:

训练集 loss 很低,验证集 loss 也不高,但真实问题一问就翻车。

不是模型突然变笨了,而是你拿着一个只会回答课后习题的学生,去参加了一场完全不同的考试。

为什么“看输出”比“看 loss”重要一百倍

这可能是最不“自动化”、但最有效的建议。

在微调阶段,尤其是前几轮微调,人工查看输出,几乎是不可替代的。

你要问的问题不是:

loss 降了多少?

而是:

- 模型是不是开始用你期望的结构回答?

- 它在不确定时有没有更谨慎?

- 它有没有学会你示例里的“潜台词”?

这些东西,loss 永远不会告诉你。

那 loss 是不是就完全没用了?

说到这里,很容易被误解成“loss 一点用都没有”。

这不是事实。

loss 在微调里,依然有几个非常重要、但非常有限的作用:

- 判断训练有没有正常跑起来

- 快速发现数值爆炸或异常

- 比较不同配置下的收敛趋势

但请注意,它的角色更像是:

“报警器”,而不是“方向盘”。

它告诉你“有没有出事”,却几乎不告诉你“该往哪开”。

为什么很多团队会被 loss 绑架

这是一个很现实的问题。

因为 loss 是:

- 自动的

- 可量化的

- 好画图的

- 看起来很“科学”的

而人工评估是:

- 慢的

- 主观的

- 难以规模化的

但在微调这种高度依赖目标定义的任务中,主观判断本身就是信息。

你想要什么样的模型,就必须通过人类判断来确认它是否在往那个方向走。

一个更健康的做法:loss + 对照输出

在真实工程中,我更推荐一种非常朴素、但有效的方式。

- 固定一组你非常熟悉的问题

- 在每一轮微调后,对比模型前后的输出

- 结合 loss 曲线,只作为参考

只要你能稳定地回答一句话:

“这一轮,模型在哪些行为上变得更像我想要的了?”

那这轮微调就是有价值的。

一个现实建议:别等 loss 完美了,才去看输出

这是我见过最多人踩的坑之一。

很多人会等训练跑完,loss 收敛得非常漂亮,才开始测试模型。

但这时候,如果方向错了,代价已经非常大。

更健康的节奏是:

早看、频繁看、反复对比。

在频繁验证输出变化、对比不同训练轮次效果时,使用像 LLaMA-Factory online 这种能快速切换模型版本、即时测试的方式,会比等一次完整训练结束更符合微调的真实节奏。

总结:loss 最大的危险,不是它没用,而是你太信它

写到这里,其实结论已经很清楚了。

loss 在微调里不是没用,而是作用范围被严重高估了。

它能告诉你“训练有没有在跑”,却几乎无法告诉你“模型有没有变成你想要的样子”。

如果你把 loss 当成主要决策依据,那你很可能会在一条看起来很平滑的曲线上,慢慢把模型带偏。

真正成熟的微调过程,永远是:loss 作为底线保障,输出评估作为核心依据