在敏捷开发成为主流的今天,API回归测试已成为保障软件质量的关键环节。然而,传统手动回归测试模式在快速迭代中显得力不从心。本文将完整分享我们团队如何利用Dify工作流平台,将API回归测试从耗时耗力的人工操作转变为高效可靠的全自动流程,实现测试效率的质的飞跃。

一、痛点剖析:传统API回归测试的困境

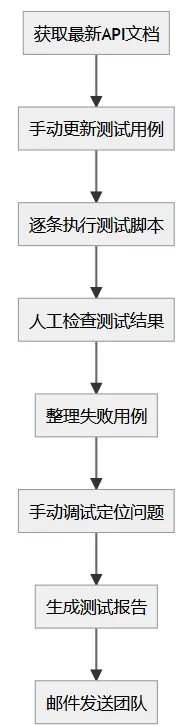

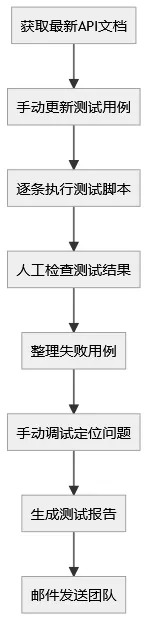

原始手动测试流程

在引入Dify之前,我们的API回归测试流程是这样的:

这个流程存在的主要问题:

时间成本高昂:完整执行一次回归测试需要3个工作日

人力投入巨大:需要2名测试工程师全职投入

错误率居高不下:人工操作导致的误判率约5-8%

反馈周期过长:问题发现到修复的平均时间超过24小时

知识难以沉淀:测试经验依赖个人能力,无法形成团队资产

具体痛点数据

二、技术选型:为什么选择Dify?

对比评估多个方案

在决定使用Dify之前,我们评估了多种自动化测试方案:

Dify的核心优势

可视化工作流编排

传统代码 vs Dify可视化

传统方式:

-编写Python测试脚本

-配置JenkinsPipeline

-手动触发执行

Dify方式:

-拖拽节点构建工作流

-自然语言配置参数

-事件驱动自动触发

AI增强的测试智能

自动生成测试用例

智能分析测试结果

预测性失败分析

强大的集成能力

支持REST API、数据库、消息队列等多种数据源

无缝对接CI/CD流水线

灵活的扩展机制

三、架构设计:全自动API回归测试系统

整体架构图

核心组件设计

- 智能触发模块

class TestTrigger:

def init(self):

self.sources = [

'git_webhook', # 代码变更

'api_doc_change', # API文档更新

'schedule', # 定时任务

'manual_trigger' # 手动触发

]

def detect_changes(self):

"""检测触发条件"""

changed_apis = self.parse_openapi_diff()

affected_cases = self.identify_affected_cases(changed_apis)

return affected_cases

- 测试用例工厂

class TestCaseFactory:

def generate_cases(self, api_spec):

"""基于OpenAPI生成测试用例"""

base_cases = self.generate_base_cases(api_spec)

edge_cases = self.generate_edge_cases(api_spec)

security_cases = self.generate_security_cases(api_spec)

return base_cases + edge_cases + security_cases

def optimize_coverage(self, cases):

"""优化测试用例覆盖度"""

# 使用AI分析用例优先级和覆盖范围

return self.llm_analyze_coverage(cases)

四、实战搭建:Dify工作流详细配置

环境准备与部署

Dify服务部署

使用Docker Compose部署

git clone https://github.com/langgenius/dify

cd dify/docker

配置环境变量

cat > .env << EOF

DIFY_API_KEYS=your_api_key_here

DEEPSEEK_API_KEY=your_deepseek_key

DATABASE_URL=postgresql://user:pass@db:5432/dify

REDIS_URL=redis://redis:6379

EOF

docker-compose up -d

依赖服务配置

docker-compose.override.yml

services:

postman-mock:

image:postman/mock

ports:

-"3000:3000"

test-db:

image:postgres:13

environment:

POSTGRES_DB:test_automation

POSTGRES_USER:tester

POSTGRES_PASSWORD:testpass

核心工作流节点配置

节点1:OpenAPI文档解析

节点类型: HTTP请求+JavaScript处理

配置:

URL:{

{api_doc_url}}

方法:GET

数据处理:

constopenapi=JSON.parse(response.body);

constendpoints=[];

for(const[path,methods]ofObject.entries(openapi.paths)){

for(const[method,spec]ofObject.entries(methods)){

endpoints.push({

path,

method:method.toUpperCase(),

parameters:spec.parameters||[],

responses:spec.responses

});

}

}

return{endpoints,openapi_version:openapi.openapi};

节点2:智能测试用例生成

你是一名资深API测试专家,基于OpenAPI规范生成全面的测试用例。

OpenAPI文档:

{

{openapi_spec}}

生成要求:

- 为每个API端点生成正向测试用例

- 为必填参数生成边界值测试用例

- 为枚举参数生成所有可能值的测试用例

- 生成异常场景测试用例(错误参数、缺失参数等)

- 生成安全测试用例(SQL注入、XSS等)

输出格式:

```json

{

"test_cases": [

{

"name": "测试用例名称",

"api_path": "/api/v1/users",

"method": "POST",

"headers": {"Content-Type": "application/json"},

"body": {"name": "test_user", "email": "test@example.com"},

"expected_status": 201,

"validation_rules": ["response.body.id exists", "response.body.name equals input.name"]

}

]

}

节点3:并行测试执行引擎

```yaml

节点类型: 并行执行

配置:

最大并发数: 10

超时时间: 300000

子节点配置:

- 类型: HTTP请求

配置:

URL: {

{base_url + test_case.api_path}}

方法: {

{test_case.method}}

Headers: {

{test_case.headers}}

Body: {

{test_case.body}}

- 类型: 断言验证

配置:

rules: {

{test_case.validation_rules}}

- 类型: 结果记录

配置:

storage: database

metrics: ["response_time", "status_code", "assertion_results"]

节点4:智能结果分析

你是一名测试分析师,请分析API测试结果并生成专业报告。

测试执行结果:

{

{test_results}}

历史基准数据:

{

{historical_data}}

分析维度:

- 通过率分析:总体通过率、各模块通过率对比

- 性能分析:响应时间趋势、性能退化识别

- 失败根因分析:对失败用例进行归类和分析根本原因

- 质量趋势:与历史测试结果对比分析质量趋势

- 风险评估:基于失败模式和影响范围评估发布风险

输出要求:

- 使用Markdown格式

- 包含具体数据支撑

- 给出明确的改进建议

- 评估本次构建的质量等级

节点5:自动化工单创建

节点类型: HTTP请求

配置:

URL:https://jira.example.com/rest/api/2/issue

方法:POST

Headers:

Content-Type:application/json

Authorization:Basic{

{jira_credentials}}

Body: |

{

"fields": {

"project": {"key": "BUG"},

"summary": "API测试失败: {

{failed_api}}",

"description": "{

{failure_analysis}}",

"issuetype": {"name": "Bug"},

"priority": {"name": "{

{priority}}"},

"labels": ["api-regression", "auto-created"]

}

}

五、关键技术实现与优化

- 测试数据管理策略

动态测试数据生成

class TestDataManager:

def generate_test_data(self, api_spec):

"""根据API规范生成测试数据"""

test_data = {}

for param in api_spec['parameters']:

if param['in'] == 'body':

test_data.update(self.generate_body_data(param['schema']))

elif param['in'] == 'query':

test_data.update(self.generate_query_data(param))

return test_data

def generate_body_data(self, schema):

"""生成请求体测试数据"""

generators = {

'string': self.faker.name,

'email': self.faker.email,

'integer': lambda: random.randint(1, 1000),

'boolean': lambda: random.choice([True, False])

}

return self.traverse_schema(schema, generators)

- 智能断言机制

多维度断言设计

class SmartAssertion:

def validate_response(self, response, test_case):

"""智能响应验证"""

validations = []

# 状态码验证

validations.append(self.validate_status_code(response, test_case))

# 响应结构验证

validations.append(self.validate_schema(response, test_case))

# 业务规则验证

validations.append(self.validate_business_rules(response, test_case))

# 性能指标验证

validations.append(self.validate_performance(response, test_case))

return all(validations)

def validate_business_rules(self, response, test_case):

"""基于知识库的业务规则验证"""

business_rules = self.knowledge_base.get_business_rules(test_case.api_path)

for rule in business_rules:

ifnot self.evaluate_rule(rule, response):

returnFalse

returnTrue

- 容错与重试机制

自适应重试策略

重试配置:

最大重试次数:3

重试条件:

-网络超时

-5xx状态码

-断言失败

重试间隔策略:指数退避

降级方案:

-标记用例为跳过

-记录详细错误信息

-通知相关人员

六、效果评估:自动化前后的对比分析

效率提升数据

质量改进指标

缺陷检测能力对比

手动测试阶段:

- 平均每次回归发现缺陷:8个

- 漏测缺陷:3-4个/版本

- 缺陷复现难度:高

自动化测试阶段:

- 平均每次回归发现缺陷:15个

- 漏测缺陷:0-1个/版本

- 缺陷复现:100%可复现

测试稳定性提升

测试稳定性指标计算

stability_metrics = {

'flaky_tests_rate': '从15%降至2%',

'false_positive_rate': '从8%降至1%',

'environment_dependency': '从强依赖降至弱依赖',

'maintenance_cost': '降低70%'

}

七、高级特性与最佳实践

- 智能测试用例优化

基于历史数据的用例优先级调整

def optimize_test_priority(self, test_cases, historical_results):

"""根据历史执行结果优化测试用例优先级"""

for case in test_cases:

# 计算用例的失败概率

failure_rate = self.calculate_failure_rate(case, historical_results)

# 计算用例的缺陷发现价值

defect_value = self.calculate_defect_value(case, historical_results)

# 计算用例的执行成本

execution_cost = self.estimate_execution_cost(case)

# 综合计算优先级分数

priority_score = (failure_rate * 0.4 +

defect_value * 0.4 +

(1 - execution_cost) * 0.2)

case.priority = self.score_to_priority(priority_score)

return sorted(test_cases, key=lambda x: x.priority, reverse=True)

- 持续学习与优化

测试知识库构建

知识库结构:

业务规则:

-路径:/api/v1/orders

规则:["订单金额必须大于0","用户必须存在"]

历史缺陷模式:

-模式:"空指针异常"

关联API:["/api/v1/users","/api/v1/products"]

触发条件:"参数为null"

性能基准:

-API:"/api/v1/search"

基准响应时间:"200ms"

最大并发数:"100"

- 安全与合规测试

自动化安全测试集成

class SecurityTester:

def run_security_checks(self, api_endpoints):

"""执行安全测试"""

checks = [

self.sql_injection_check,

self.xss_check,

self.authentication_bypass_check,

self.rate_limiting_check

]

results = []

for endpoint in api_endpoints:

for check in checks:

result = check(endpoint)

results.append(result)

return self.aggregate_security_results(results)

八、避坑指南:实施过程中的经验总结

常见挑战与解决方案

挑战1:测试环境稳定性

解决方案:

- 实施环境健康检查

- 配置自动环境恢复

- 建立测试数据隔离机制

- 实现环境快照和回滚

挑战2:测试数据管理

测试数据生命周期管理

class TestDataLifecycle:

def setup(self):

"""测试数据准备"""

self.cleanup() # 先清理

self.generate_base_data() # 生成基础数据

self.isolate_test_data() # 数据隔离

def cleanup(self):

"""测试数据清理"""

self.delete_test_data()

self.reset_sequences()

挑战3:持续集成集成

GitHub Actions 集成示例

name:APIRegressionTest

on:

push:

branches:[main]

schedule:

-cron:'0 2 *'# 每天凌晨2点

jobs:

api-test:

runs-on:ubuntu-latest

steps:

-uses:actions/checkout@v3

-name:TriggerDifyWorkflow

run: |

curl -X POST "${

{secrets.DIFY_WORKFLOW_URL}}" \

-H "Authorization: Bearer ${

{secrets.DIFY_API_KEY}}" \

-H "Content-Type: application/json" \

-d '{"inputs": {"git_commit": "${

{github.sha}}"}}'

九、未来规划:持续优化方向

- 预测性测试分析

基于机器学习的测试优化

class PredictiveTestOptimizer:

def predict_failures(self, code_changes, historical_data):"""预测可能失败的测试用例""" features = self.extract_features(code_changes) return self.ml_model.predict(features) - 自适应测试策略

智能测试策略:

变更影响分析:- 代码变更关联度分析

- 业务影响评估

风险驱动测试: - 基于风险评估调整测试深度

- 动态测试用例选择

- 全链路质量监控

class EndToEndQualityMonitor:

def monitor_quality_metrics(self):

十、总结:从成本中心到价值创造"""监控端到端质量指标""" return { 'api_performance': self.collect_performance_metrics(), 'error_rates': self.calculate_error_rates(), 'user_experience': self.assess_user_experience(), 'business_impact': self.analyze_business_impact() }

通过Dify重构API回归测试流程,我们实现了:

量化收益

时间效率:测试周期从3天缩短到3小时

成本节约:人力成本降低92%

质量提升:测试覆盖率提升46%,缺陷漏测率降低75%

反馈速度:问题发现时间从24小时缩短到实时

质化价值

工程卓越:建立了可复用的测试基础设施

知识沉淀:将个人经验转化为团队资产

流程优化:实现了真正的持续测试

文化变革:推动了质量左移和全员质量意识

实施建议

对于计划实施类似方案的团队,建议:

渐进式实施:从核心API开始,逐步扩展覆盖范围

跨团队协作:开发、测试、运维共同参与设计和实施

持续优化:建立度量体系,基于数据驱动持续改进

文化培育:培养自动化优先的工程文化

API回归测试的自动化不是终点,而是质量工程新时代的起点。通过Dify这样的现代化工具平台,测试团队可以从重复劳动中解放出来,专注于更高级别的质量策略和创新工作,真正从成本中心转变为价值创造中心。