本文在多平台同步更新

掘金:全面开测 - 零门槛,即刻拥有DeepSeek-R1满血版,百万token免费用

csdn:全面开测 - 零门槛,即刻拥有DeepSeek-R1满血版,百万token免费用

infoq:全面开测 - 零门槛,即刻拥有DeepSeek-R1满血版,百万token免费用

微信公众号:进阶架构师 ,欢迎大家关注

前言

在2024年的年尾遭受到了裁员的危机,过得迷迷糊糊的,幸好有了小棉袄的加持,也不会太过于郁闷,但是确实技术进步的学习少了很多,唯一没有落下学习的是突然大火的大模型 - - DS(DeepSeek)。

随着DeepSeek大模型的加入,大模型的圈子发生翻天覆地的变化,各个平台都在争相纳入DS,高效私有化部署满血版DeepSeek 成了云平台的一大优势。

在这里笔者来赘述下DeepSeek大模型的能力。DeepSeek 是热门的推理模型,能在少量标注数据下显著提升推理能力,尤其擅长数学、代码和自然语言等复杂任务。

那么,满血版与普通版相比差异在哪呢,很少看到有人讲清楚,在这里笔者把这个点给大家讲透,让大家理解DeepSeek火出圈,大家都在干个什么事以及为什么这么干。

作为当前AI领域的热门模型,满血版DeepSeek(通常指参数规模为671B的DeepSeek-R1或V3版本)与普通版(如蒸馏版或小参数版本)在多个维度存在显著差异,其部署需求也体现了技术、场景和战略层面的多重考量。以下是具体分析:

一、满血版的核心区别

模型参数与架构

满血版采用6710亿参数的庞大架构,基于混合专家系统(MoE)和稀疏激活技术,具备更复杂的神经网络结构和更精细的专家分配策略。相比之下,蒸馏版或小参数版本(如1.5B、7B、32B)是通过知识蒸馏技术压缩后的模型,参数规模仅为满血版的1/10甚至更低,导致性能大幅下降139。

性能表现

复杂任务处理能力:满血版在数学推理、编程代码生成、长文本分析等高难度任务中表现卓越,例如能生成符合逻辑的藏头诗、解决复杂几何问题(如三棱柱表面积计算)并输出详细解析,而小参数模型(如7B)可能连基础任务都无法完成911。

逻辑与联网能力:满血版支持实时联网数据更新和多轮深度对话,可结合最新信息生成回答(如解读当日政策或股市动态),而离线版或蒸馏版仅能依赖静态数据,功能受限611。

推理速度与资源需求

满血版需极高算力支持,例如单机部署需至少350G显存/内存(FP4量化版本)或专业服务器(如1T内存+双H100 GPU),推理速度可能低至10 token/s;而蒸馏版(如32B)仅需24G显存即可运行,但性能仅能实现满血版的90%4910。

二、为何争相部署满血版?

应对复杂场景需求

科研与教育:高校和研究机构依赖满血版处理高难度任务(如编程、数学建模、长文本分析),例如泉州职业技术大学通过本地部署保护科研数据隐私,同时提升学术研究效率5。

企业级应用:企业需满血版实现精准竞品分析、代码调试、政策解读等进阶功能,例如百度智能云通过集成满血版提供低延迟、高精度的API服务610。

数据安全与隐私保护

本地化部署满血版可避免敏感数据上传云端,尤其适用于政府、金融、医疗等领域。例如高校选择本地部署以保留科研项目交互数据,规避外部服务器风险5。

技术验证与国产化突破

国产芯片适配:华为、昆仑芯等企业通过适配满血版验证其AI芯片的算力与多机互联能力。例如昆仑芯P800支持单机部署满血版,显存和吞吐量达行业领先水平,推动国产芯片生态发展810。

行业标准竞争:满血版的成功部署被视为技术实力的象征,甚至可能影响AI芯片公司的上市前景8。

成本效益与长期价值

尽管满血版部署成本高(如单机硬件成本超2万元),但其在复杂任务中的表现远超免费或低配模型。以API调用为例,满血版每百万token成本仅16元,综合性价比显著410。

总体来说,满血版DeepSeek的核心价值在于其不可替代的高性能与复杂任务处理能力,而部署热潮则反映了行业对技术制高点、数据主权和国产化突破的迫切需求。尽管面临硬件与成本挑战,但其在科研、商业和战略层面的长期价值仍驱动各方积极投入。对于普通用户,建议通过云服务或API调用获取满血版能力,而企业及机构则可结合国产化方案实现高效部署。

那么,阿里云提供的满血版DeepSeek版本部署方案,就是对普通用户特别友好的方案。

本方案涵盖云上调用满血版 DeepSeek 的 API 及部署各尺寸模型的方式,无需编码,最快 5 分钟、最低 0 元即可部署实现。

解决方案链接:https://www.aliyun.com/solution/tech-solution/deepseek-r1-for-platforms?utm_content=g_1000401616

解决方案

正如我们知道的,对于我们技术人员来讲,如何快速了解云平台提供的解决方案,可以从下几点来进行阅读:

- 方案明细,哪几种方案,都是什么方式

- 架构技术细节,选型是否与现有兼容,技术人员是否适合

- 成本与定价,成本费用是否cover的住

- 各个方案优劣势

那么,我们对于阿里云提供的解决方案,我们仍然从这个方向去看。

方案明细

阿里云平台对于即刻拥有DeepSeek-R1满血版解决方案,推荐在云端部署您的专属 DeepSeek 模型,不仅部署门槛低、支持各类模型尺寸,并且可以做到自动弹性扩展,云产品功能唾手可得,加速企业创新。

共提供了四种部署方案:

- 借助阿里云大模型平台-百炼,百炼提供了 DeepSeek 模型调用的 API,其中 DeepSeek-R1 与 DeepSeek-V3 分别有 100万 的免费 token,另有多款开源 Qwen 及 Llama 蒸馏模型支持调用。

- 基于人工智能平台PAI进行部署满血版DeepSeek,无须编写代码,可一键部署 DeepSeek 系列模型。

- 基于函数计算部署,通过云原生应用开发平台 CAP 部署 Ollama 和 Open WebUI 两个 FC 函数。Ollama 负责托管模型,它是基于 DeepSeek-R1 的推理能力,通过蒸馏技术将推理模式迁移到较小的 Qwen 模型上,从而在保持高效性能的同时降低了计算成本。Open WebUI 则为用户提供友好的交互界面。

- 基于GPU云服务器部署,安装与配置 vLLM 和 Open WebUI。vLLM 负责托管 DeepSeek-R1 模型,Open WebUI 则为用户提供友好的交互界面。

架构技术细节

百炼大模型平台最为简单,所有企业内的技术人员都可以通过openapi接口完成DeepSeek的调用使用。

基于人工智能平台PAI,无须编写代码,需要技术人员对PAI平台进行一定的学习和熟悉,平台提供充分的文档帮助,总的来说,也对企业技术人员来说,没有太多压力,部署完毕,即可通过openapi接口完成调用使用。

基于函数计算部署,需要技术人员,熟悉函数计算平台和云原生应用开发平台CAP,有一点的代码量,需要评估技术人员是否能够适应,快速掌握相关的内容

基于GPU云服务器部署,了解GPU云服务器即可,没什么技术压力

成本定价

基于百炼平台对于企业来说可能是最便宜的,当前还有百万token可以免费调用。

其他的部署方式,由贵到便宜顺序为,GPU云服务器部署 -> 人工智能平台PAI -> 函数计算部署

方案优劣势

免部署、免代码、价格性价比高,这将是优势的典型表现

对于人工智能平台PAI部署来讲,可支持 DeepSeek 系列模型的微调训练,以满足企业特定的场景需求。适用于需要一键部署,同时需要推理加速、支持并发的用户。

对于GPU云服务器部署来讲,用户可以根据实际需求选择其他参数规模的 DeepSeek-R1 模型,并相应调整实例规格配置。适用于对模型推理速度有高要求,具备运维能力的用户。

对于函数计算部署来讲,支持自选择模型规模,无需代码,无需关心运维,适用于需要一键部署,不关注运维、按量付费的用户。

通过上边我们的解决方案学习评估,大致明白了每周方案的特点,我们就可以按照我们实际情况,来选择我们想要进行的方案进行尝试。

方案试用

通过百炼调用满血版 API

免费体验,快速调转到体验教程页面 链接

登录百炼平台,领取百万免费token

获取API-KEY,供后续api 调用鉴权使用

使用 Chatbox 客户端配置 百炼 API 进行对话 Chatbox下载地址

支持windows、mac、移动端等,体验文档内以mac为例,个人感觉,可以适当补充其他端的核心说明,因为就是一个配置api-key 的过程。

笔者在这分别对windows、网页端,进行配置

网页端

桌面端 windows

配置完毕,发布问题进行测试

DeepSeek原版回复是正确的,百炼存在异常回复

引导操作手册比较细致,使用顺畅,没有卡壳,但是内容确实有点失误!!

通过人工智能平台PAI部署

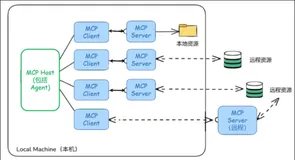

方案架构图如下:

跟着操作手册去操作

首先,开通PAI相关的服务,这里边涉及到各种授权,希望部署文档可以提供相关的示例文档,虽然不用重新在解决方案手册内编写,但是最好是有更多的细节可以看。

包括授权影响的范围、如何取消授权、相关说明等等,解决方案文档,这块是缺失的。

按照说明,选择DeepSeek-7b,相关模型进行部署,点击两个授权后,进入详情页面

此处页面展示与操作手册不符合

操作手册如下图:

希望编写解决方案的同学更加认真点

部署完毕,即可在chatbox种进行token调用了

基于函数计算部署

方案部署架构图如下:

- 1 个云原生应用开发平台 CAP 项目:全托管的 Serverless 计算服务,用于部署模型服务与 Web 应用。

- 1 个文件存储 NAS:存储 DeepSeek-R1 开源模型。

根据手册说明,我们进行CAP平台使用授权,完毕进入控制台

这时,

手册内,告诉我们打开提供的云原生应用开发平台CAP项目模板,即笔者截图中的目标应用,此处可以直接写清楚就好,没必要点击前往部署,再打开新的页面,才能知道这个应用

部署完毕,可以通过webui 进行访问

后边比较顺畅,能够让用户快速部署使用起来。

基于GPU云服务器部署

方案部署架构图如下:

通过在GPU 云服务器种部署模型服务与 Web 应用,来实现描述功能

根据操作手册,首先要进行VPC、交换机、安全组等的设置

这块对于老用户来讲,可能不需要,可以在描述时适当的区分新老用户的情况。

实例创建完毕,进行模型部署

使用 vLLM 框架来部署 DeepSeek-R1 模型,使用 Open WebUI 调用模型服务。

驱动安装完成

部署模型

/bin/bash -c "$(curl -fsSL https://help-static-aliyun-doc.aliyuncs.com/install-script/deepseek-r1-for-platforms/vllm_install.sh)" -- deepseek-ai/DeepSeek-R1-Distill-Qwen-7B

脚本都已经写了,比较贴心,可以快速执行模型安装脚本

模型安装完毕,出现api token,需要记录保存,供后续使用。这个地方,笔者希望能够有页面能够展现就更好了,省得丢了

后续,通过访问webui应用,进行问答。

方案评价

详细的对四种方案进行了部署体验,下面说下评价

部署文档内的指引相对来说准确,有异常的地方,在上述部署明细,已经有所提及

引导和文档可以更细节,更符合实际用户的需要

通过部署四种方案,对解决方案中DeepSeek有了充分的了解,方案的描述和优劣势,也有了体现,这块比以往的文档做的详尽多了

对于我来讲,最适合我个人来讲的话,可能是百炼,但是准确度存在异常,还是用官方的靠谱。

非要是推荐,相对来说百炼更靠谱,直接使用不用部署。不用运维。

总结

阿里云平台为了用户能够快速上手DeepSeek做了充分的模型融合与努力,出具的解决方案能够很好的承担起这个责任。对于用户来讲,如果有DeepSeek大模型API token调用需要,可以尝试起来。

相对来说,还是建议普通用户,选择百炼作为最佳的方案。