从前几年出尽风头的 GAN 到今年独占鳌头的 Stable Diffusion,预训练生成模型一直风头不减,相关论文、模型也是层出不穷。这就带来了一些问题:如何在众多模型中找到自己想要的那一个?如何找到对应模型的学习资料(比如代码库)?自己做了个新模型如何与更多的人分享(除了发推特)?

近日,卡内基梅隆大学助理教授朱俊彦等人开发了一个名为「Modelverse」的在线分享和搜索平台来解决这些问题。

Modelverse 是一个包含多种深度生成模型的模型共享和搜索平台,例如 GAN、扩散模型和自回归模型,题材包括动物、风景、肖像和艺术品等。你可以在这个平台上查找或者共享深度生成模型。

平台链接:https://modelverse.cs.cmu.edu/

平台提供的搜索方式是多样化的,你可以输入文字检索,也可以输入图像、简笔画或多模态信息检索。

比如,以一张飞机的简笔画作为输入,我们可以得到以下结果:

以大象的图片为输入,我们也能找到可以生成大象图像的 GAN 模型:

,时长00:42

那么,这些功能具体是怎么实现的呢?

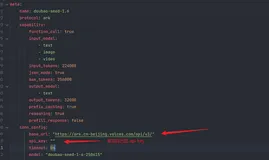

在最新公布的论文中,作者进行了详细的介绍。

论文链接:https://arxiv.org/pdf/2210.03116.pdf

该搜索系统由预缓存阶段(a,b)和推理阶段(c)组成。给定一组模型,(a)首先为每个模型生成 50K 的样本。(b)然后将图像编码为图像特征并计算每个模型的一阶和二阶特征统计。统计数据被缓存在系统中,以提高效率。(c)在推理时,系统支持不同模式(文本、图像或草图)的查询。系统将查询编码为特征向量,并评估查询特征与每个模型的统计数据之间的相似性,由此检索具有最佳相似性度量的模型。

搜索结果

模型检索的定性结果。下面展示了三种不同模态的模型检索结果,分别是图像、草图、文本。

该系统还支持多模态查询 (下图左) ,并支持使用模型作为查询来查找相似的模型 (下图右)。

图像重建与编辑。随着生成模型数量的爆发式增长,用户越来越不可能了解每一个有趣的模型,但是为自己的特定用途选择正确的模型可能是至关重要的。下图显示,选择正确的生成模型进行图像查询可以得到更好的转换结果,从而更好地进行潜在空间插值和图像编辑。

但我们可以发现,这个搜索系统还存在一些局限性。如下图(左)所示,有时侯草图查询(例如,鸟的草图)会匹配具有抽象风格的模型。CLIP 特征是否与草图的形状、样式、纹理相匹配是不明确的。如下图(右)所示,对于彼此冲突的多模态查询(大象文本 + 狗图像),系统就难以检索具有这两个概念的模型——排名靠前的模型中没有大象模型。

随着平台上共享的模型越来越多,平台的搜索体验有望逐步改善。