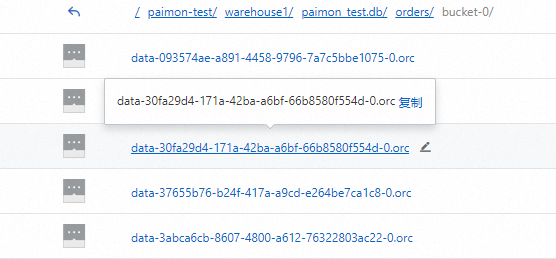

我在使用Flink + Flink cdc + Paimon + oss 做数据同步,在cdc的yaml里指定了paimon的文件格式是parquet,但生成的文件依然是默认的文件格式orc,请问是什么原因?

source:

type: mysql

name: MySQL Source

hostname: 192.168.xxx.xxx

port: 3306

username: xxxx

password: xxxx

tables: paimon_test.users,paimon_test.products,paimon_test.order_details,paimon_test.orders

server-id: 5401-5404

scan.startup.mode: initial

jdbc.properties.useSSL: false

server-time-zone: Asia/Shanghai

sink:

type: paimon

name: Paimon Sink

catalog.properties.file.format: parquet

catalog.properties.metastore: filesystem

catalog.properties.warehouse: oss://paimon-test/warehouse

catalog.properties.fs.oss.endpoint: oss-cn-shenzhen.aliyuncs.com

catalog.properties.fs.oss.accessKeyId: xxxxx

catalog.properties.fs.oss.accessKeySecret: xxx

pipeline:

name: MySQL to Paimon Pipeline OSS

parallelism: 1

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

请检查您的Flink CDC Paimon连接器配置,确保file.format确实设置为了parquet,并且没有其他配置项冲突,如sink.format等,如果问题依旧,建议询问一下阿里云的工作人员。如果对您有帮助的话,可以帮忙采纳一下。谢谢。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。