modelscope-funasr在安卓平台可以集成sense voice吗?

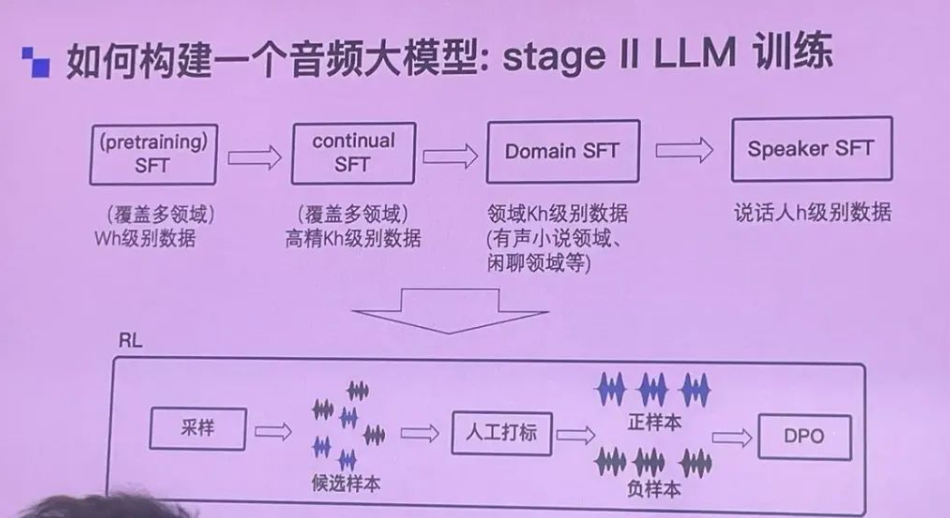

ModelScope的FUNASR是一个面向语音技术的模型,而Sense Voice是提供降噪、回声消除等功能的技术。理论上在技术实现上,如果两者接口兼容并且都能在Android平台上运行,那么是可以尝试集成的。具体来说,FUNASR可以在Android设备上处理语音识别或合成任务,而Sense Voice则负责改善音频质量,通过集成可以使语音应用在嘈杂环境中也能保持较高的识别准确率或语音质量。然而实际集成需要考虑两个系统的兼容性、性能影响以及是否满足各自的使用许可要求。

可以用small版本

你就把手机当成个linux系统的电脑就可以了,small版的模型比较小

https://www.modelscope.cn/models/iic/SenseVoiceSmall

回答不易请采纳

下载和安装:获取 ModelScope-FunASR 和 Sense Voice 的安卓库或SDK,并按照说明进行安装。

配置项目:在安卓项目中配置必要的依赖,并确保所有权限都已正确设置。

编写代码:使用 ModelScope-FunASR 提供的API来实现语音识别功能,并确保它可以与 Sense Voice 协同工作。

关于您询问的ModelScope-FunASR在安卓平台是否可以集成Sense Voice的问题,从提供的参考资料中并没有直接涉及到FunASR与Sense Voice在安卓平台集成的具体信息。不过,根据通用的语音处理技术和平台集成原则,理论上只要FunASR提供了适用于Android平台的SDK或者API,并且Sense Voice技术允许外部语音处理库的接入,两者之间的集成是可行的。

在安卓平台上集成 Sense Voice 技术到 ModelScope-FunASR,理论上是可以的,但具体实施起来需要考虑以下因素:

Sense Voice 提供的API或SDK是否与安卓平台兼容,并且可以与 ModelScope-FunASR 的代码库协同工作。Sense Voice 到 ModelScope-FunASR 中可能需要以下步骤:Sense Voice 的SDK或API接入权限。Sense Voice SDK。Sense Voice 可以正常工作。Sense Voice 的处理流程与 ModelScope-FunASR 的语音处理流程相结合,通常是在音频输入 ModelScope-FunASR 之前使用 Sense Voice 进行预处理。如果 Sense Voice SDK或API是开放的,并且提供了适用于安卓平台的集成指南,那么集成是可行的。否则,可能需要联系华为的相关部门或技术支持以获取进一步的帮助。

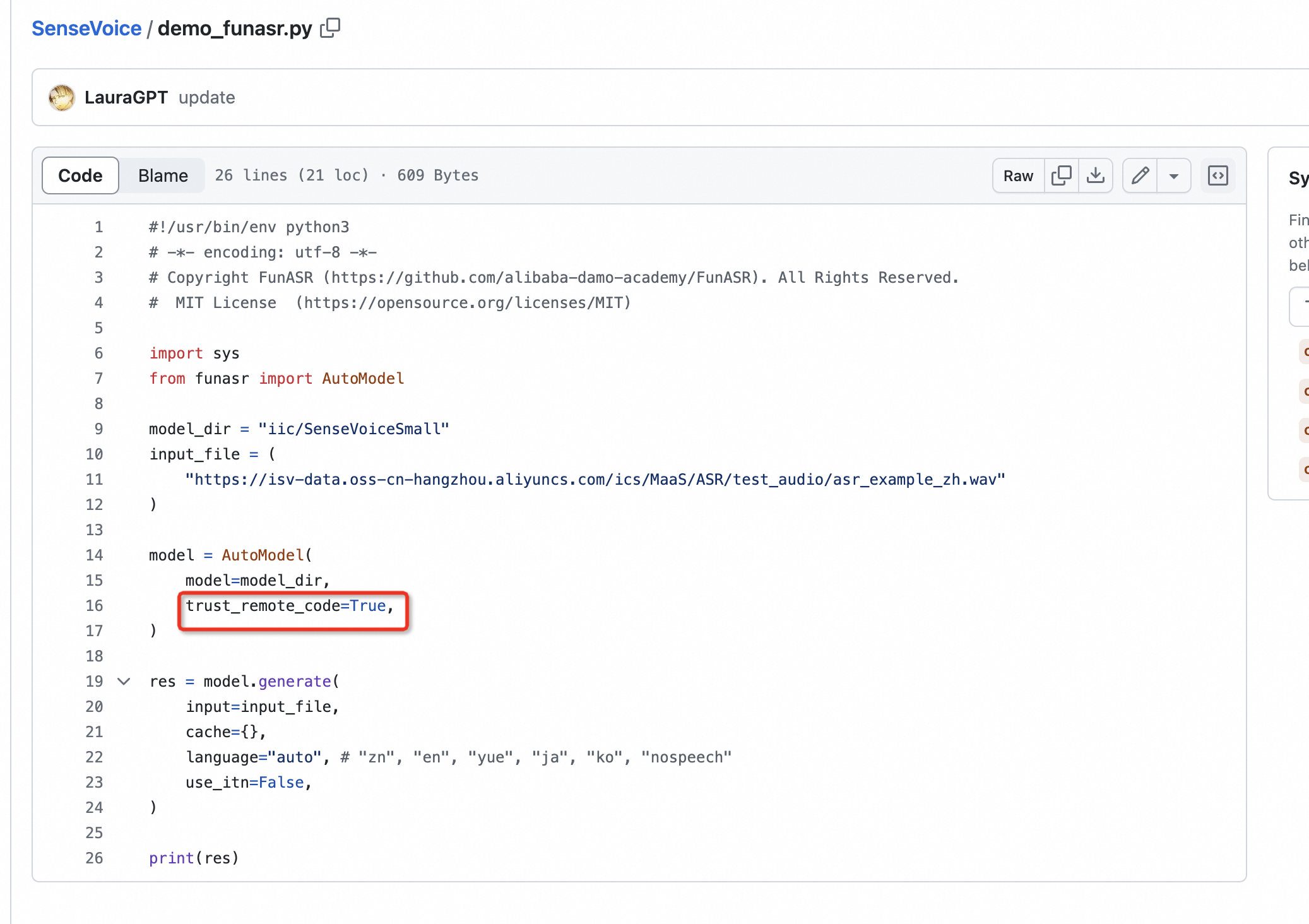

可以通过注册来集成sensevoice模型,模型代码都不在funasr里面,但是注册一下就可以被funasr调用:

@tables.register("encoder_classes", "SenseVoiceEncoderSmall")

这个表示,模型代码从本地load(默认路径是当前目录,如果不在当前目录,可以通过remote_code来指定),也就是无需集成到funasr里面 此回答整理自钉群“modelscope-funasr社区交流”

modelscope-funasr在安卓平台可以集成sense voice。虽然目前modelscope-funasr还没有提供针对安卓平台的官方部署教程,但开发者可以通过一些步骤尝试将funasr模型,包括sense voice模型,部署到安卓设备上。这些步骤通常包括准备开发环境(如安装Android Studio和JDK),创建新的Android项目,添加funasr模型的依赖项,将模型文件集成到项目中,编写代码以实现音频录制、预处理和模型推理等功能,最后在Android模拟器或实际设备上调试和测试应用程序。

需要注意的是,具体的实现方式可能会因开发者的具体需求和环境而有所不同。因此,建议开发者在尝试集成时参考相关的文档和资源,并根据实际情况进行调整和优化。

此外,由于技术和平台的不断发展,modelscope-funasr和sense voice的集成方式也可能会有所更新和变化。因此,开发者需要保持对新技术和新方法的关注和学习,以确保能够充分利用这些工具和技术来提升自己的开发效率和产品质量。

modelscope-funasr在安卓平台可以集成sense voice。

modelscope-funasr是一个基于C++的语音识别引擎,它具备在安卓平台上运行的基础架构。而sense voice是阿里开源的一个语音大模型,支持多种语言识别以及情感和声音事件的检测。这两个库都提供了适用于安卓的SDK或库文件,并且它们之间的兼容性也是可能的。

在实际操作中,需要确保两个系统之间的数据格式、通信协议等细节兼容,并且可能需要一定的开发工作来完成集成。具体能否集成还要看FUNASR和目标语音技术的开放程度以及是否有相应的API支持。

modelscope-funasr在安卓平台可以集成sense voice。

根据搜索结果,未能查询到关于modelscope-funasr是否能在安卓平台集成sense voice的直接信息。不过,从搜索结果中可以推断一些相关信息。

modelscope-funasr是一个基于C++的语音识别引擎,而runtime/csharp是其用于安卓平台的运行时库。这意味着modelscope-funasr具备在安卓平台上运行的基础架构。同时,sense voice作为阿里开源的一个语音大模型,其实测效果和效率优于Whisper,并且支持多种语言识别以及情感和声音事件的检测。这些特性表明sense voice具有强大的语音处理能力,理论上应该能够与modelscope-funasr集成。

综上所述,虽然无法直接确认modelscope-funasr在安卓平台是否可以集成sense voice,但考虑到两者都是阿里巴巴开源的项目,且都具备在安卓平台上运行的能力,可以合理推测它们之间存在集成的可能性。建议开发者尝试进行集成测试,并参考相关文档或社区资源以获得更具体的指导。

ModelScope的FUNASR是一个专注于语音技术的模型,而Sense Voice则是与语音识别、自然语言处理等领域相关的技术。如果指的是将FUNASR与某种特定的语音技术或SDK(如某些厂商提供的语音解决方案)进行集成,那么理论上,在技术实现上是可行的,只要两者之间的接口兼容并且能够正确地进行数据交换。但在实际操作中,需要确保两个系统之间的数据格式、通信协议等细节兼容,并且可能需要一定的开发工作来完成集成。需要注意的是具体能否集成还要看FUNASR和目标语音技术的开放程度以及是否有相应的API支持。在进行集成前,建议详细查阅双方的技术文档并评估集成的可行性。

ModelScope-FunASR 是一个基于 FunASR 框架的语音识别解决方案,而 Sense Voice 是商汤科技(SenseTime)提供的一种语音处理技术,通常用于语音识别、语音合成等场景。要在安卓平台上集成这两种技术,需要考虑以下几个方面:

假设你已经获得了 Sense Voice SDK,以下是一个简单的集成示例:

添加 SDK 到项目:

app/libs 目录。build.gradle 文件中添加依赖:dependencies {

implementation fileTree(dir: 'libs', include: ['*.aar'])

}

配置权限:

AndroidManifest.xml 中添加必要的权限:<uses-permission android:name="android.permission.RECORD_AUDIO" />

<uses-permission android:name="android.permission.INTERNET" />

初始化 SDK:

在 Application 类或主 Activity 中初始化 SDK:

import com.sensetime.sensevoice.SenseVoice;

public class MyApplication extends Application {

@Override

public void onCreate() {

super.onCreate();

// 初始化 Sense Voice SDK

SenseVoice.init(this, "YOUR_APP_KEY", "YOUR_APP_SECRET");

}

}

调用 API 进行语音处理:

在需要进行语音处理的地方调用相应的 API:

import com.sensetime.sensevoice.SenseVoice;

import com.sensetime.sensevoice.SenseVoiceCallback;

public class MainActivity extends AppCompatActivity {

private SenseVoice senseVoice;

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

senseVoice = new SenseVoice();

Button startButton = findViewById(R.id.start_button);

startButton.setOnClickListener(v -> {

senseVoice.startRecognition(new SenseVoiceCallback() {

@Override

public void onResult(String result) {

// 处理识别结果

Log.d("VoiceRecognition", "Result: " + result);

}

@Override

public void onError(int errorCode, String errorMessage) {

// 处理错误

Log.e("VoiceRecognition", "Error: " + errorCode + ", " + errorMessage);

}

});

});

Button stopButton = findViewById(R.id.stop_button);

stopButton.setOnClickListener(v -> {

senseVoice.stopRecognition();

});

}

}

通过上述步骤,你应该能够在 Android 平台上集成 ModelScope-FunASR 和 Sense Voice。如果你有具体的集成需求或遇到具体问题,建议参考官方文档或联系技术支持获取更多帮助。