"

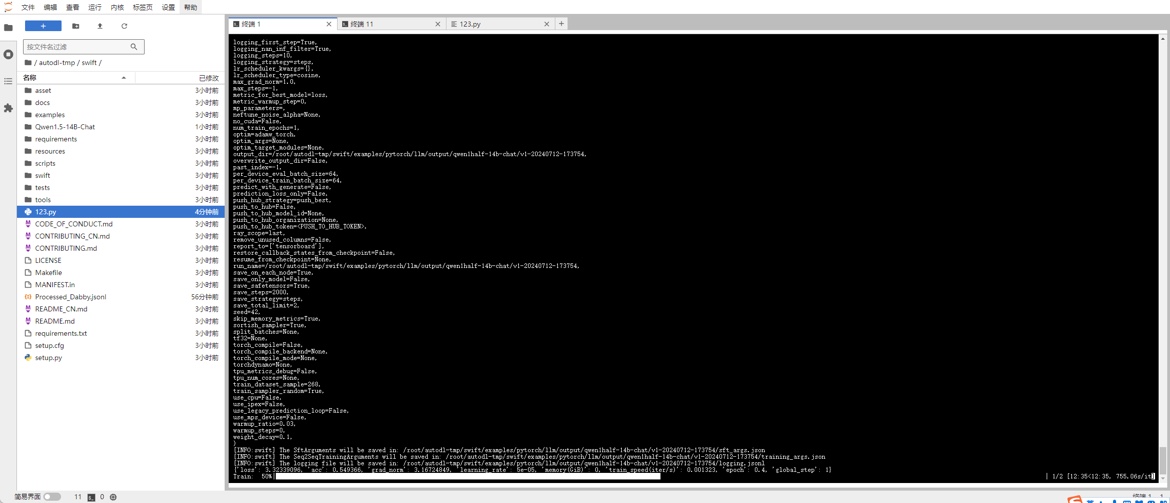

CUDA_VISIBLE_DEVICES=1 \

python llm_sft.py \

--model_type qwen1half-14b-chat \

--model_id_or_path /root/autodl-tmp/swift/Qwen1.5-14B-Chat\

--custom_train_dataset_path /root/autodl-tmp/swift/Processed_Dabby.jsonl\

--batch_size 64 \

--max_length 4096 \

--use_loss_scale true \

--gradient_accumulation_steps 2 \

--learning_rate 5e-5 \

--use_flash_attn true \

--eval_steps 2000 \

--save_steps 2000 \

--train_dataset_sample -1 \

--num_train_epochs 1 \

--check_dataset_strategy none \

--gradient_checkpointing true \

--weight_decay 0.1 \

--max_grad_norm 1.0 \

--warmup_ratio 0.03 \

--save_total_limit 2 \

--logging_steps 10 \

--use_flash_attn false \

--sft_type lora \

--lora_target_modules ALL \

--lora_rank 8 \

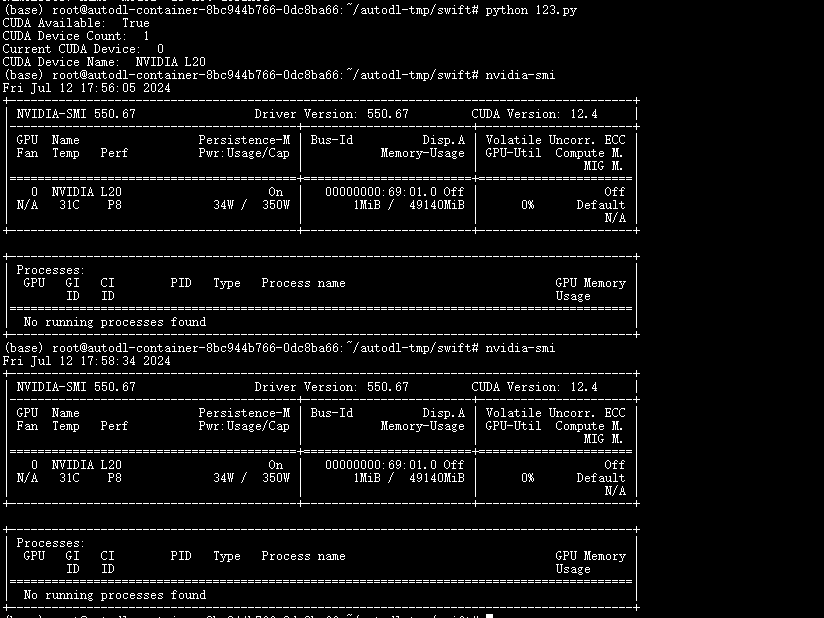

--lora_alpha 32 ModelScope中,为 啥gpu使用率上不去 ? 数据有200条 ,以上是运行脚本。"

--use_flash_attn true 单卡,CUDA_VISIBLE_DEVICES=0 此回答整理自钉群“魔搭ModelScope开发者联盟群 ①”

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352