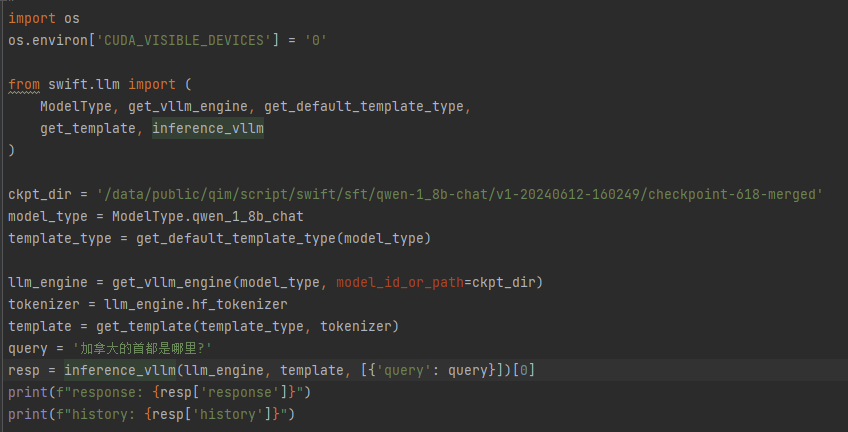

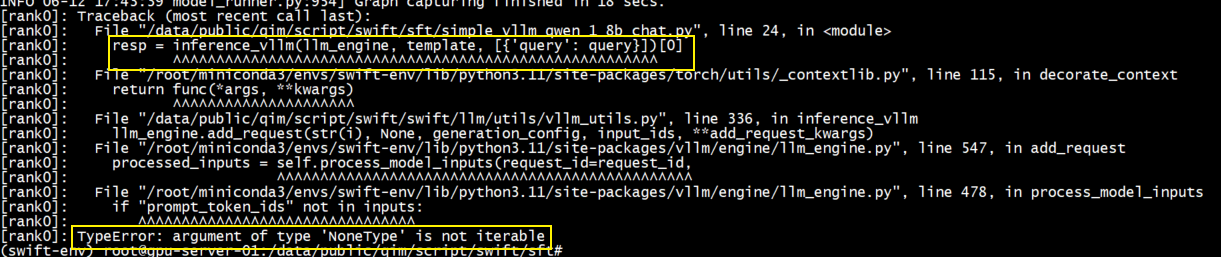

"ModelScope中,使用样例代码,进行vllm推理加速报错,已经安装了vllm,本机cuda版本12.1满足vllm最新版本,怎么解决?

"

"您拉最新代码安装一下,参考以下链接 https://github.com/modelscope/swift

pip install -e . 此回答整理自钉群“魔搭ModelScope开发者联盟群 ①”"

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352