flinkcdc3.0.1版本同步pgsql,能从pg源数据表读到数据,但过一会会挂,怎么处理?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

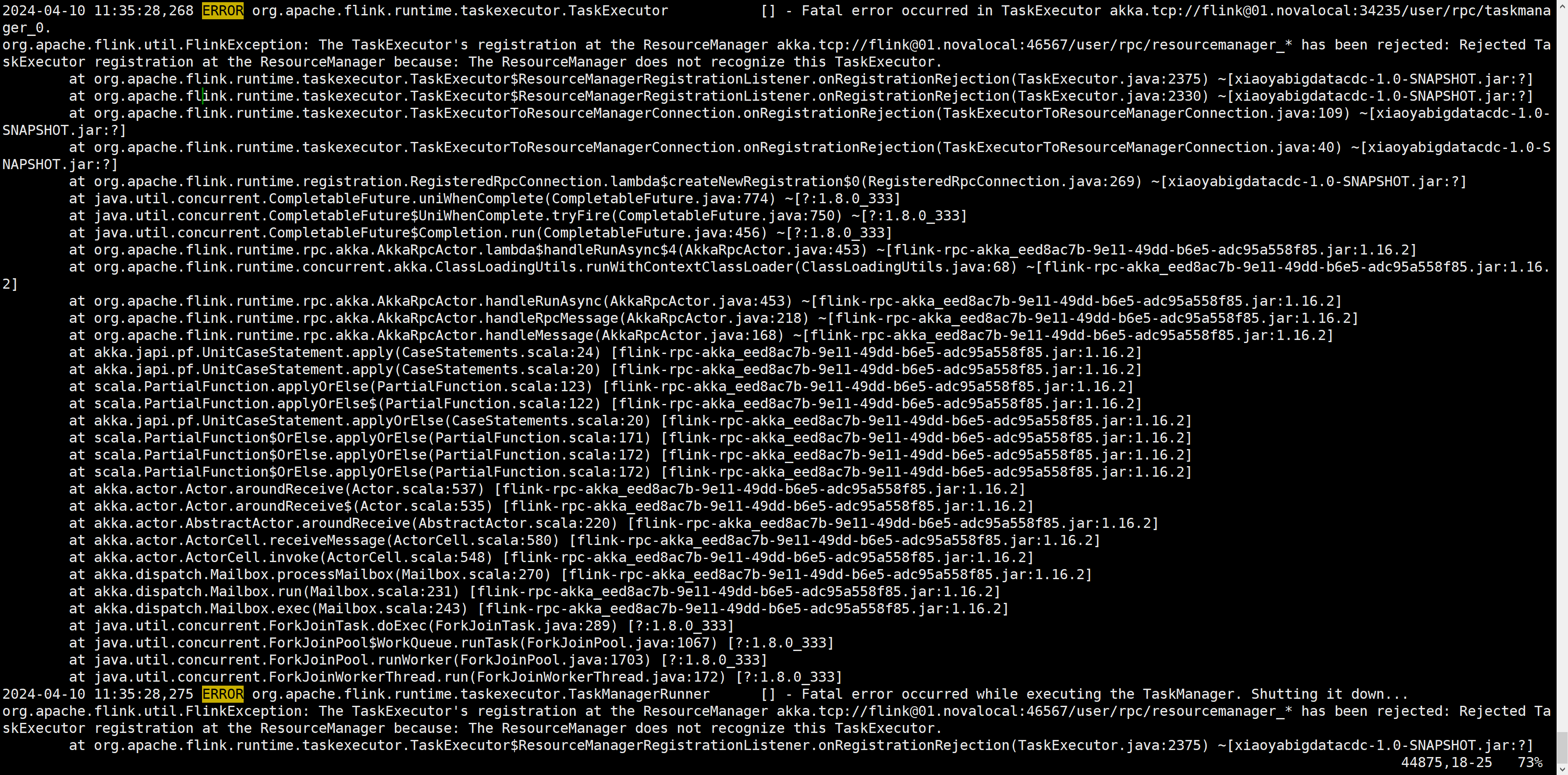

根据您描述的问题,Flink CDC 3.0.1版本在同步PostgreSQL(Pg)数据时能够正常读取源表数据,但运行一段时间后作业挂掉。以下是可能的原因分析及解决方案:

首先需要查看Flink作业的日志,尤其是TaskManager的日志,以定位具体的异常信息: - 在运维中心 > 作业运维页面,单击目标作业名称。 - 进入状态总览页签,找到Source节点。 - 在SubTasks页签的操作列,单击Open TaskManager Log Page。 - 查看日志中最后一个Caused by信息,这通常是导致作业失败的根本原因。

重要提示:

如果日志中出现与PostgreSQL连接相关的问题(如超时、连接中断等),请优先排查网络和数据库配置。

Flink CDC依赖于与PostgreSQL的稳定连接。如果网络不稳定或存在中断,可能导致作业挂掉。建议进行以下检查: - 确认Flink集群与PostgreSQL实例之间的网络是否连通:确保两者位于同一VPC内,或者通过NAT网关实现公网访问。 - 检查PostgreSQL的连接数限制:如果PostgreSQL的连接数达到上限,可能会导致CDC任务无法维持连接。可以通过以下SQL查询当前连接数:

SELECT COUNT(*) FROM pg_stat_activity;

如果连接数接近上限,请调整PostgreSQL的max_connections参数。

Flink CDC依赖PostgreSQL的WAL(Write-Ahead Logging)日志来捕获增量数据。如果WAL日志配置不当,可能导致CDC任务无法持续读取数据。请检查以下配置: - wal_level:必须设置为logical。 - max_replication_slots:确保有足够的复制槽供CDC任务使用。 - max_wal_senders:确保有足够的WAL发送进程。

可以通过以下SQL检查当前配置:

SHOW wal_level;

SHOW max_replication_slots;

SHOW max_wal_senders;

如果配置不符合要求,请修改PostgreSQL的配置文件(postgresql.conf)并重启服务。

Flink CDC任务对资源的需求较高,尤其是在处理大规模数据时。如果Flink集群资源不足,可能导致任务挂掉。建议进行以下优化: - 增加Flink TaskManager的内存和CPU资源:确保TaskManager有足够的资源处理数据流。 - 调整并发度:根据数据量大小合理设置并发度,避免资源争抢。 - 监控Kafka或其他下游存储的写入压力:如果下游存储写入延迟过高,可能导致整个作业阻塞。

Flink CDC 3.0.1可能存在已知的Bug或兼容性问题。建议尝试以下步骤: - 升级到最新版本:检查是否有更高版本的Flink CDC修复了相关问题。 - 启用新增表读取功能:如果源表有新增表的情况,确保启用了以下配置:

SET 'table.cdas.scan.newly-added-table.enabled' = 'true';

并按照文档中的步骤从快照恢复作业。

如果上述步骤均未解决问题,可能是数据本身存在问题。例如: - PostgreSQL表结构变更:如果源表的结构发生变更(如新增字段、删除字段),可能导致CDC任务失败。建议在变更前暂停作业,并重新部署。 - 数据格式不一致:确保源表和目标表的字段类型、顺序和大小写完全一致。

VACUUM或AUTOVACUUM,可能导致CDC任务读取的数据不完整。建议调整autovacuum参数或手动控制VACUUM操作。通过以上步骤,您可以逐步排查并解决Flink CDC任务挂掉的问题。如果问题仍未解决,建议提供详细的日志信息以便进一步分析。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。