有没有遇到过这种情况呀,flinkcdc读mysql数据的时候,checkpoint 一直卡着也不报错,有什么排查的思路吗?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

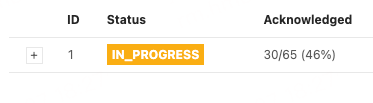

在使用 Flink CDC 读取 MySQL 数据时,如果遇到 Checkpoint 一直卡着且不报错的情况,可能是由于多种原因导致的。以下是详细的排查思路和解决方案:

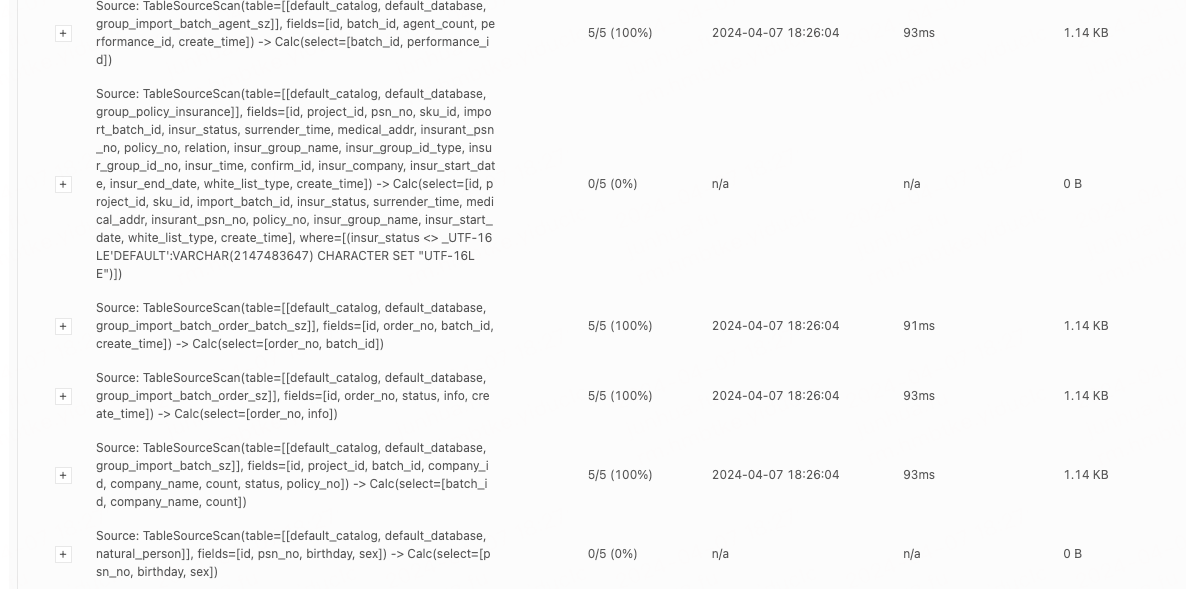

反压是导致 Checkpoint 卡住的常见原因之一。当作业中某些算子处理速度较慢时,会导致数据积压,从而影响 Checkpoint 的完成。

排查方法:

解决方案:

python.fn-execution.bundle.size: 50000 # 默认值为100000

python.fn-execution.bundle.time: 500 # 默认值为1000

Flink CDC 会读取 MySQL 的 Binlog 数据,而 Binlog 是实例级别的,可能包含大量无关表的变更记录。这会导致带宽占用过高,进而影响 Checkpoint 的完成。

排查方法:

解决方案:

在 MySQL CDC 全量读取完成后,进入增量阶段前需要等待一个 Checkpoint 完成,以确保全量数据已写入下游。如果 Checkpoint 间隔时间设置过长(如 20 分钟),会导致增量阶段延迟。

排查方法:

解决方案:

execution.checkpointing.interval: 60000 # 单位为毫秒

- 确保全量读取阶段的并发度合理,避免单个分片数据量过大导致 OOM。

如果作业中同时包含 WindowAggregate 和 GroupAggregate,并且未正确配置 MiniBatch 参数,可能导致 LocalGroupAggregate 节点长时间卡住无输出。

排查方法:

table.exec.mini-batch.size 参数是否未配置或设置为负值。解决方案:

table.exec.mini-batch.size 为正值,例如:table.exec.mini-batch.size: 1000 # 单位为条数

- 缩短 Checkpoint 间隔时间,确保 LocalGroupAggregate 节点能够及时触发输出。

如果上游数据源(如 Kafka)存在空闲分区,且未设置合理的超时时间,可能导致 Watermark 无法推进,进而影响 Checkpoint。

排查方法:

解决方案:

table.exec.source.idle-timeout: 1s

每个 MySQL CDC 数据源需要配置唯一的 Server ID。如果多个 CDC 数据源共享相同的 Server ID,可能导致 Binlog 位点错乱,进而影响 Checkpoint。

排查方法:

解决方案:

SELECT * FROM source_table /*+ OPTIONS('server-id'='123456') */;

如果开启增量快照框架且并行度大于 1,需指定 Server ID 范围:

SELECT * FROM source_table /*+ OPTIONS('server-id'='123456-123458') */;

如果以上方法均未解决问题,可以通过日志进一步排查。

排查方法:

error 或 exception,定位具体问题。解决方案:

通过以上步骤,您可以逐步排查 Flink CDC 读取 MySQL 数据时 Checkpoint 卡住的问题。重点检查反压、Binlog 数据量、全量到增量切换、MiniBatch 配置、空闲分区、Server ID 配置以及日志信息。根据具体问题采取相应的优化措施,确保作业稳定运行。

如果问题仍未解决,建议联系阿里云技术支持团队获取进一步帮助。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。