Flink CDC里提交任务的时候,卡死,查日志也没查出哪里报错,要怎么办?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

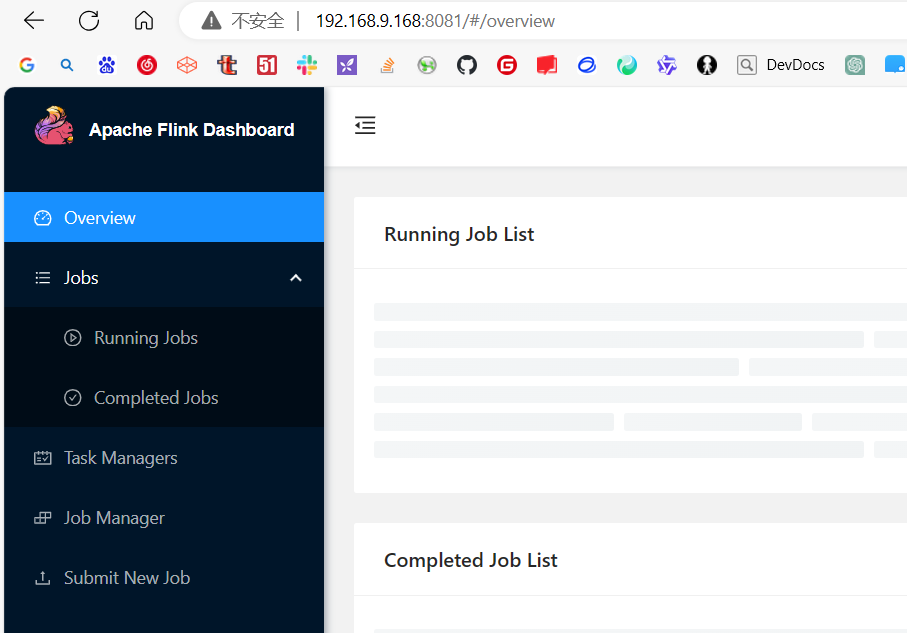

在Flink CDC任务提交时出现卡死且日志未明确报错的情况下,可以按照以下步骤进行排查和解决:

exceeded quota: resourcequota的报错信息。TimeOut类的报错信息。tableList选项是否正确配置,表名需包含数据库名,格式为yourDatabaseName.yourTableName。Caused by部分)定位根因,并针对性解决问题。Task did not exit gracefully within 180 + seconds的报错信息。close方法阻塞)。INFO调整为DEBUG,以获取更详细的日志信息。ROW模式,避免使用Mixed或Statement模式。ROW,并延长Binlog保留时间(如7天)。Replication slot "xxxx" is active的报错。debezium.slot.drop.on.stop=true。Encountered change event for table xxx.xxx whose schema isn't known to this connector的报错,确认数据库用户权限是否正确。The connector is trying to read binlog starting at GTIDs ...的报错,延长Binlog保留时间或加快处理速度。通过以上步骤,您可以逐步排查Flink CDC任务卡死的原因。如果问题仍未解决,建议结合具体日志信息进一步分析,或联系阿里云技术支持团队获取帮助。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。