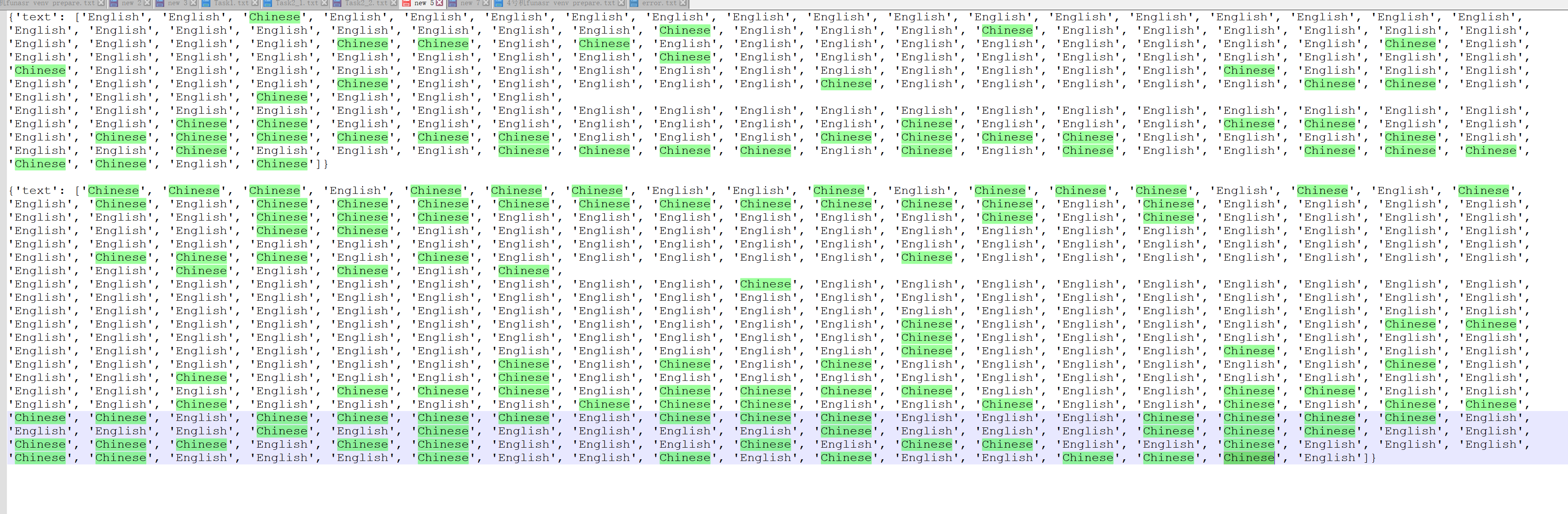

根据您描述的情况,使用modelscope-funasr语种识别模型时,全英数据集中有四分之一被错误识别为中文语种,这可能与以下几个因素有关。以下是详细分析和解决建议:

1. 音频数据特性与模型适配性

- 您提到的数据集包含40%中国人朗读的英语音频和60%北美人朗读的英语音频。这种混合口音的语音数据可能会对模型的语种识别能力造成干扰。

- 原因:语种识别模型通常基于语言的声学特征进行判断。如果中国口音的英语发音中带有较多的中文语音特征(如音调、韵律等),模型可能会误判为中文。

- 建议:

- 确保音频数据的标注准确无误,并尽量避免混入口音过重或非标准发音的样本。

- 如果可能,尝试对模型进行微调(Fine-tuning),以适应特定口音的英语数据。

2. 模型配置与参数设置

- 在使用语种识别模型时,是否正确设置了

language_hints参数?该参数可以帮助模型更准确地识别目标语种。

- 原因:如果没有明确指定目标语种提示,模型可能会在多语种环境中产生混淆,尤其是在中英文混合场景下。

- 建议:

3. 音频质量与格式要求

- 根据知识库文档,语种识别模型对输入音频的格式和质量有严格要求:

- 支持的音频格式:PCM编码(无压缩的PCM或WAV文件)。

- 音频采样率:8000 Hz。

- 音频通道:单声道(mono)。

- 原因:如果音频不符合上述要求(例如双声道或多声道音频),可能会导致模型误判。

- 建议:

4. 模型性能与定制化需求

- 默认的语种识别模型可能无法完全满足特定场景的需求,尤其是当数据集中存在大量带口音的英语时。

- 原因:通用模型在训练时可能未充分覆盖带口音的英语数据,导致识别效果不佳。

- 建议:

- 使用自定义热词功能,将常见的英语单词或短语加入热词列表,以提高识别准确率。

- 如果问题依然存在,可以考虑开通自学习模型训练服务,通过上传特定领域的音频数据对模型进行定制化训练。

5. 排查与验证

- 如果以上方法仍无法解决问题,建议按照以下步骤进一步排查:

- 对比测试:使用阿里云提供的示例音频进行测试,确认模型在标准数据上的表现是否正常。

- 日志记录:记录每次请求的

taskid,并结合日志信息定位问题。

- 网络状况:使用抓包工具(如Wireshark)检查网络延迟或丢包情况,确保请求传输稳定。

6. 其他注意事项

- 重要提醒:语种识别模型的准确率受多种因素影响,包括音频质量、口音分布、模型配置等。如果您的数据集中存在大量带口音的英语音频,建议提前与阿里云技术支持团队沟通,评估是否需要定制化解决方案。

- 商务支持:如有模型定制化需求或商务问题,可以通过钉钉群号23369411联系专家团队获取进一步支持。

通过以上分析和建议,您可以逐步排查问题并优化语种识别的效果。如果仍有疑问,请提供具体的音频样本和调用参数,以便进一步协助您解决问题。