函数计算使用魔搭搭建的chatglm2 输出好像是流式输出,每次都只有一个字?怎么让他一次输出所有内容啊?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

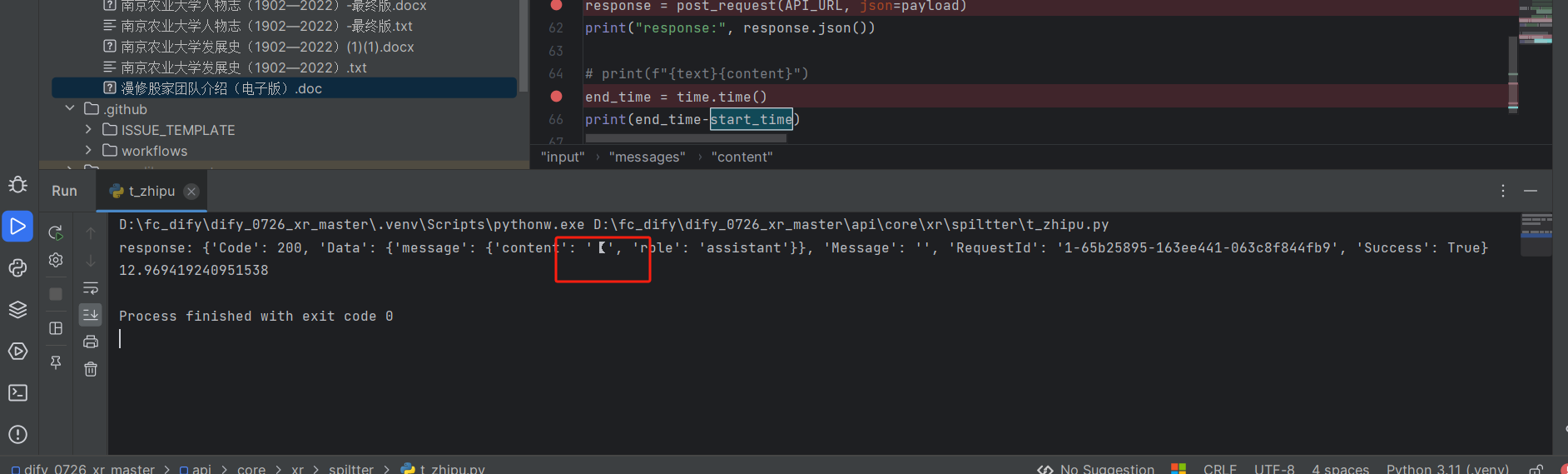

根据您的描述,函数计算使用魔搭(ModelScope)搭建的ChatGLM2模型时,输出内容似乎是流式输出,每次只返回一个字。这种情况可能与函数计算的响应方式或模型本身的输出逻辑有关。以下是解决该问题的具体方法和建议:

函数计算支持通过Web函数实现流式响应(Server-Sent Events, SSE)。如果您的函数是以Web函数方式部署的,并且响应头中包含Transfer-Encoding: chunked,则说明启用了流式响应。

某些大语言模型(如ChatGLM2)在生成文本时,默认会以逐字或逐词的方式逐步输出结果。这种行为通常由模型的推理参数控制。

stream参数,将其设置为False可以禁用流式输出。response = model.generate(input_text, stream=False) # 禁用流式输出

print(response) # 输出完整内容

如果模型本身已经返回了完整内容,但函数计算仍然逐字输出,可能是函数代码中的返回逻辑存在问题。

def handler(event, context):

# 假设model_output是模型生成的完整内容

model_output = generate_response_from_model(event)

return {

"statusCode": 200,

"body": model_output # 返回完整内容

}

函数计算的Initializer函数会在实例初始化时执行一次,用于加载依赖或初始化资源。如果Initializer函数中存在影响模型输出的逻辑(如分块处理),也可能导致逐字输出。

函数计算访问VPC内资源时,需要正确配置网络。如果网络配置不当,可能导致数据传输异常,进而影响输出内容。

如果上述方法仍未解决问题,可以通过日志分析进一步排查。

要解决函数计算使用魔搭搭建的ChatGLM2模型逐字输出的问题,您可以按照以下步骤操作: 1. 确认是否启用了流式响应(SSE),并根据需要禁用。 2. 调整模型推理参数,确保禁用逐字生成模式。 3. 优化函数计算的返回逻辑,确保返回完整内容。 4. 检查Initializer函数的实现,避免分块处理。 5. 验证网络配置,确保函数计算能够正常访问模型服务。 6. 通过日志分析进一步排查问题。

如果问题仍未解决,建议提供更多上下文信息(如函数代码片段或模型调用方式),以便进一步分析。