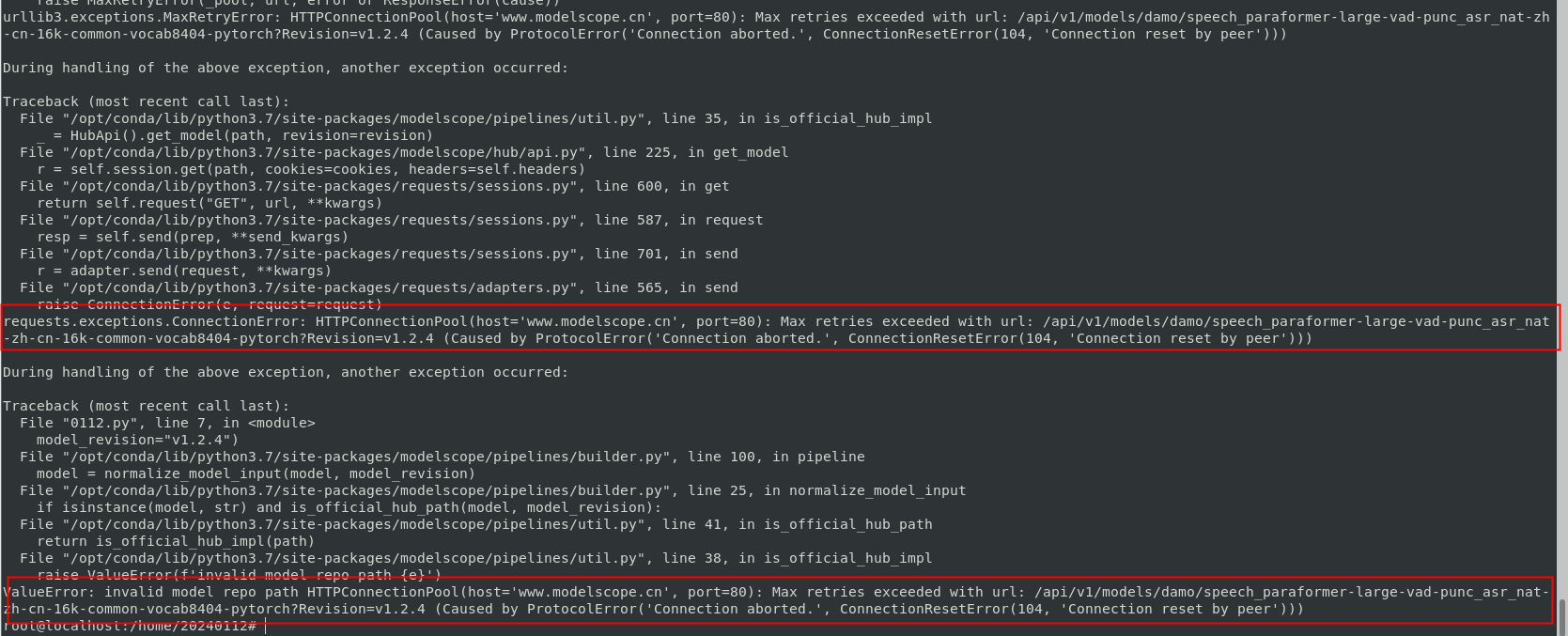

在modelscope-funasr我调用语音识别长音频 识别功能时,一直报这个错误,是什么问题?我的网络环境是可以连互联网的

根据您提供的错误描述和知识库中的相关信息,以下是可能导致问题的原因及解决方案:

语音识别服务对输入音频的时长有明确限制。如果您的音频文件过长,可能会导致报错。例如: - 一句话识别仅支持60秒以内的音频。 - 录音文件识别或录音文件识别闲时版支持的最大音频时长为12小时,超过此限制会报错AUDIO_DURATION_TOO_LONG。

解决方法: - 如果您的音频文件超过60秒,请使用实时语音识别、录音文件识别或录音文件识别闲时版服务。 - 如果音频时长超过12小时,建议使用工具(如ffmpeg)将音频切分为多个小于12小时的片段,分别进行识别。示例命令如下:

ffmpeg -i input_audio.wav -ss 00:10:00 -to 5:10:00 -c copy output_audio.wav

参数说明: - -ss:指定开始时间。 - -to:指定结束时间。 - -c copy:直接复制音频数据,不做重新编码。

语音识别服务对音频格式有严格要求。如果音频格式不正确,可能会导致识别失败。常见支持的格式包括pcm、wav、opus、speex、aac、amr等,推荐使用pcm或wav格式。

解决方法: - 确保音频文件格式符合要求。如果格式不正确,可以使用工具(如ffmpeg)进行转换。例如:

ffmpeg -i input_audio.mp3 -ar 16000 -ac 1 -f wav output_audio.wav

参数说明: - -ar 16000:设置采样率为16kHz。 - -ac 1:设置为单声道。 - -f wav:输出为WAV格式。

语音识别模型对采样率有明确要求。如果音频采样率与模型配置不一致,可能会导致识别失败。例如: - 模型支持的采样率为16000 Hz及以上,电话语音采样率为8000 Hz及以上。 - 如果音频采样率为8000 Hz,应直接使用支持8000 Hz的模型,无需转换为16000 Hz。

解决方法: - 检查音频采样率是否与模型配置一致。如果不一致,可以使用工具(如ffmpeg)调整采样率。例如:

ffmpeg -i input_audio.wav -ar 16000 output_audio.wav

尽管您提到网络环境可以连接互联网,但可能存在以下问题: - SSL连接失败:可能是由于SSL证书问题或网络不稳定导致。 - DNS解析失败:可能是本地DNS服务异常。 - WebSocket连接问题:高并发场景下,同时创建过多WebSocket连接可能导致阻塞。

解决方法: - 检查网络连接是否稳定,确保服务URL和本地网络正常。 - 如果是高并发场景,建议逐步提升并发量或增加预热任务,避免同时创建过多WebSocket连接。

如果SDK内部状态异常,可能会导致调用失败。例如: - STATE_INVALID:SDK内部状态错误,可能是在错误状态下调用了接口。 - ILLEGAL_FUNC_CALL:该模式无法调用接口,可能是接口调用不合理。

解决方法: - 确认SDK初始化是否成功,并按照SDK流程图检查调用逻辑。 - 如果出现异常,主动关闭WebSocket连接并归还对象池。例如:

recognizer.getDuplexApi().close(1000, "bye");

MEM_ALLOC_ERROR)。解决方法: - 检查接口调用参数是否完整。 - 确保系统内存充足,避免资源耗尽。

根据上述分析,建议您按照以下步骤排查问题: 1. 检查音频时长是否超出限制,并按需切分音频。 2. 确认音频格式和采样率是否符合要求,并进行必要的转换。 3. 检查网络连接是否稳定,避免高并发场景下的连接阻塞。 4. 确认SDK初始化和调用逻辑是否正确,避免内部状态错误。 5. 检查是否缺少必要参数或系统资源不足。

如果问题仍未解决,请提供具体的错误码或日志信息,以便进一步定位问题。

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉群号:44837352