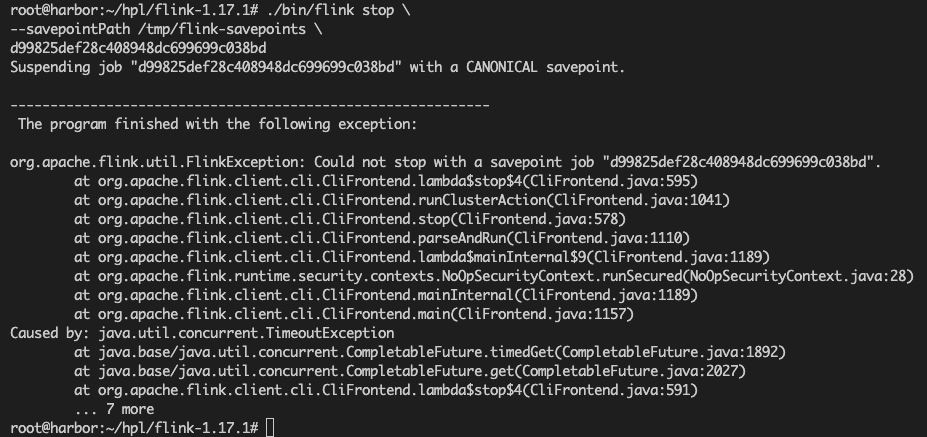

想对Flink提交到k8s上的任务进行savepoint保存。报超时的错误,如下图。请问如何解决呀?

运行语句是: ./bin/flink stop --savepointPath /tmp/flink-savepoints \d99825def28c408948dc699699c038bd

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

当执行 Flink 的 stop 命令并指定 --savepointPath 参数时,如果操作超时,可能是由于不同原因导致的。以下是一些建议,你可以尝试解决该问题:

1.检查 Flink Job 是否处于正常状态:

2.确保 Flink Job 处于正常运行状态。

3.使用 Flink 的 Web UI 或者命令行工具查看作业的状态,确保它没有失败或处于异常状态。

4.确认 Savepoint 路径存在并且可用:

5.确保指定的 --savepointPath 路径存在,并且 Flink 进程有足够的权限访问该路径。

6.验证文件系统是否正常,以确保 Flink 能够正确读取和写入 Savepoints。

7.查看 Flink 日志:

8.检查 Flink 的日志,特别是 JobManager 和 TaskManager 的日志,以查看是否有任何与 Savepoint 相关的错误或警告消息。

9.Flink 的日志通常位于 log/ 目录下,可以使用 tail 或其他日志查看工具实时监控日志文件。

10.增加超时时间:

11.如果超时是因为 Savepoint 过程比较耗时,可以尝试增加 stop 命令的超时时间。例如,可以使用 --timeout 参数来指定更长的超时时间,例如 --timeout 600000(单位是毫秒)。

./bin/flink stop --savepointPath /tmp/flink-savepoints -d d99825def28c408948dc699699c038bd --timeout 600000

12.手动执行 Savepoint:

13.如果 stop 命令仍然失败,尝试手动执行 Savepoint。可以使用以下命令:

bash

./bin/flink savepoint <jobID> <savepointDirectory>

其中,<jobID> 是作业的 JobID,可以在 Flink 的 Web UI 或者日志中找到,<savepointDirectory> 是 Savepoint 保存的目录。

14.版本兼容性问题:

15.确保 Flink 的版本与执行 Savepoint 和 Stop 命令的版本兼容。有时,不同版本之间的兼容性问题可能导致异常。

如果以上方法都无法解决问题,可能需要更详细的日志信息或者进一步调查。在这种情况下,建议查阅 Flink 的官方文档、社区论坛或者向 Flink 社区寻求帮助。 ,此回答整理自钉群“【③群】Apache Flink China社区”

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。