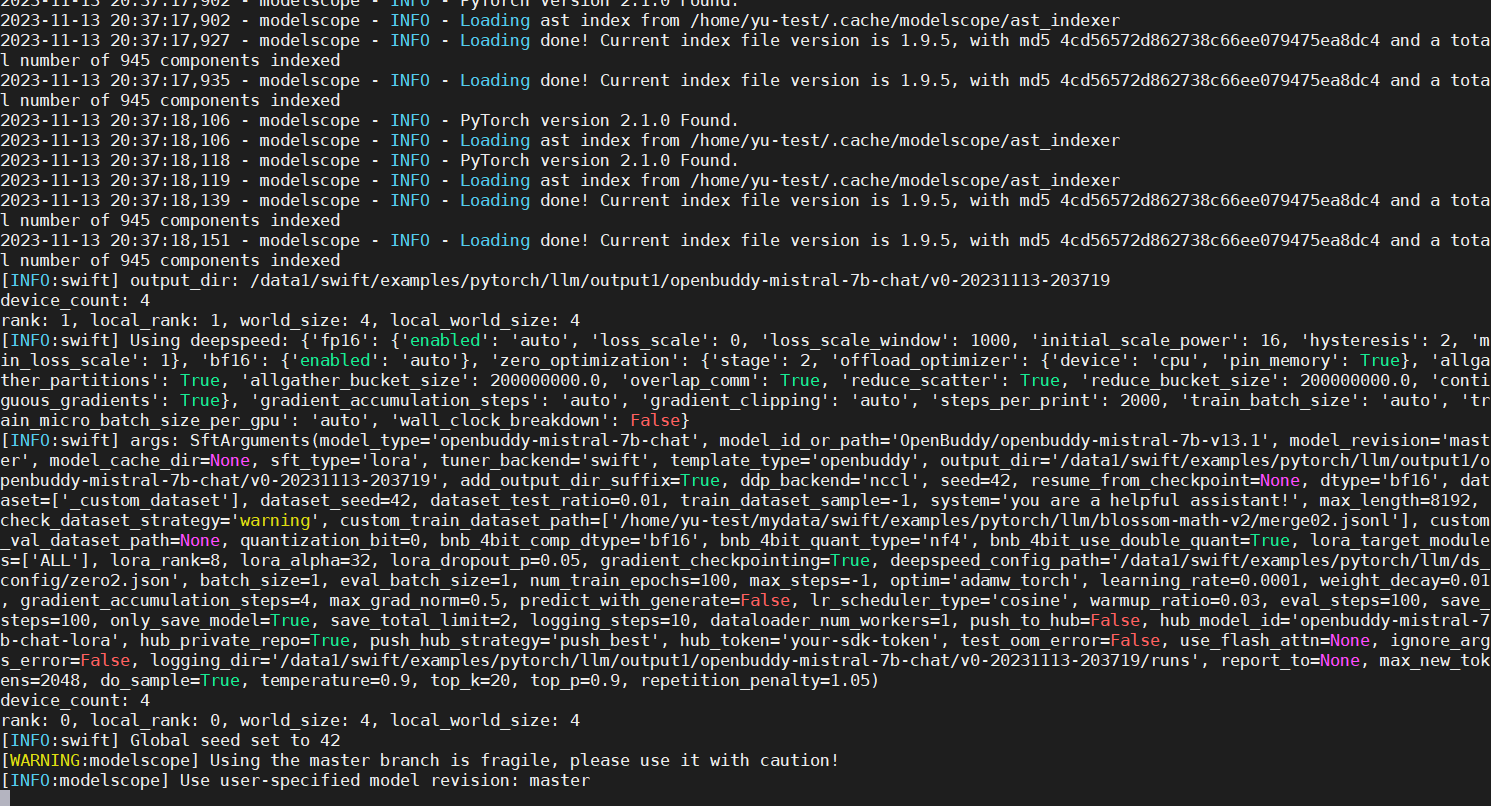

ModelScope中openbudy-mistral-7b 我用4卡lora微调,为啥卡住不走了?

ModelScope中,大佬们。openbudy-mistral-7b 我用4卡lora微调,为啥卡到这里不走了

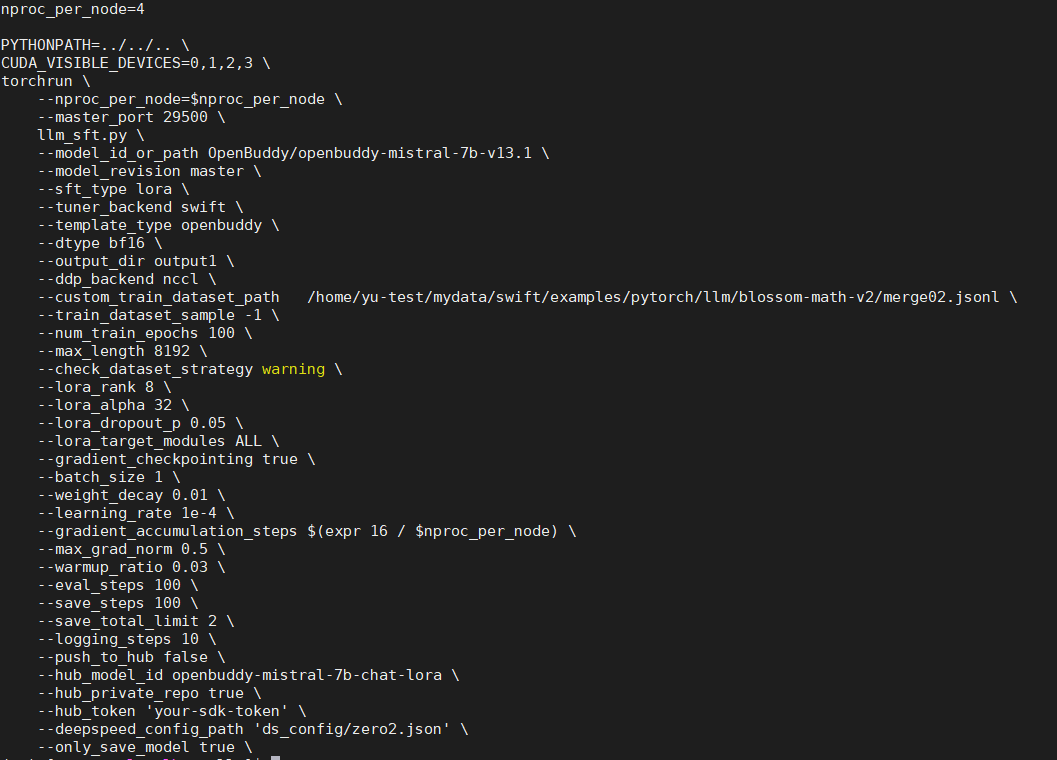

这是执行命令大佬们有用4卡 跑 sft.sh的吗?就是我想用4卡去跑,还跑不了了?,但是2卡跑的时候数据集大的时候报显存不够

这是执行命令大佬们有用4卡 跑 sft.sh的吗?就是我想用4卡去跑,还跑不了了?,但是2卡跑的时候数据集大的时候报显存不够

展开

收起

3

条回答

写回答

-

面对过去,不要迷离;面对未来,不必彷徨;活在今天,你只要把自己完全展示给别人看。

在ModelScope中使用openbuddy-mistral-7b模型进行训练时,出现卡住不动的情况可能是由于多种原因导致的。以下是一些可能的原因:

计算资源不足:如果你正在使用的计算设备(例如GPU)没有足够的内存或计算能力来处理模型训练,那么训练可能会卡住。

数据问题:如果输入数据存在问题(例如格式错误、缺失值等),也可能会导致模型训练卡住。

模型参数问题:某些模型需要手动调整超参数以获得良好的性能。如果超参数设置不当,可能会导致模型训练无法收敛或者性能不佳。

环境问题:操作系统、驱动程序或其他软件的问题也可能导致模型训练失败。

2023-11-29 13:14:59赞同 展开评论 -

根据您提供的信息,看起来您在使用4张显卡进行微调时遇到了问题。首先,请确保您的系统和硬件配置支持使用4张显卡。然后,您可以尝试以下方法来解决问题:

检查您的代码是否正确地使用了多张显卡。您可以使用

nvidia-smi命令来查看当前正在使用的显卡数量。如果发现只有部分显卡被使用,您可能需要检查您的代码以找出原因。尝试调整batch size。较大的batch size可能会占用更多的显存,导致其他任务无法获得足够的资源。您可以尝试减小batch size,看看是否能解决问题。

如果可能的话,尝试使用更大的显存。如果您的模型和数据集允许,您可以考虑升级到具有更大显存的GPU。

检查您的数据集是否过大,导致在2张显卡上运行时显存不足。在这种情况下,您可能需要对数据集进行预处理,例如分批加载数据或使用数据生成器。

2023-11-29 11:36:13赞同 展开评论 -

相关问答

相关文章

热门讨论

热门文章

展开全部

展开全部

还有其他疑问?

咨询AI助理