函数计算,一直部署不起来有这样的报错有什么办法吗?百川,glm,qwen都不太行。。。

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

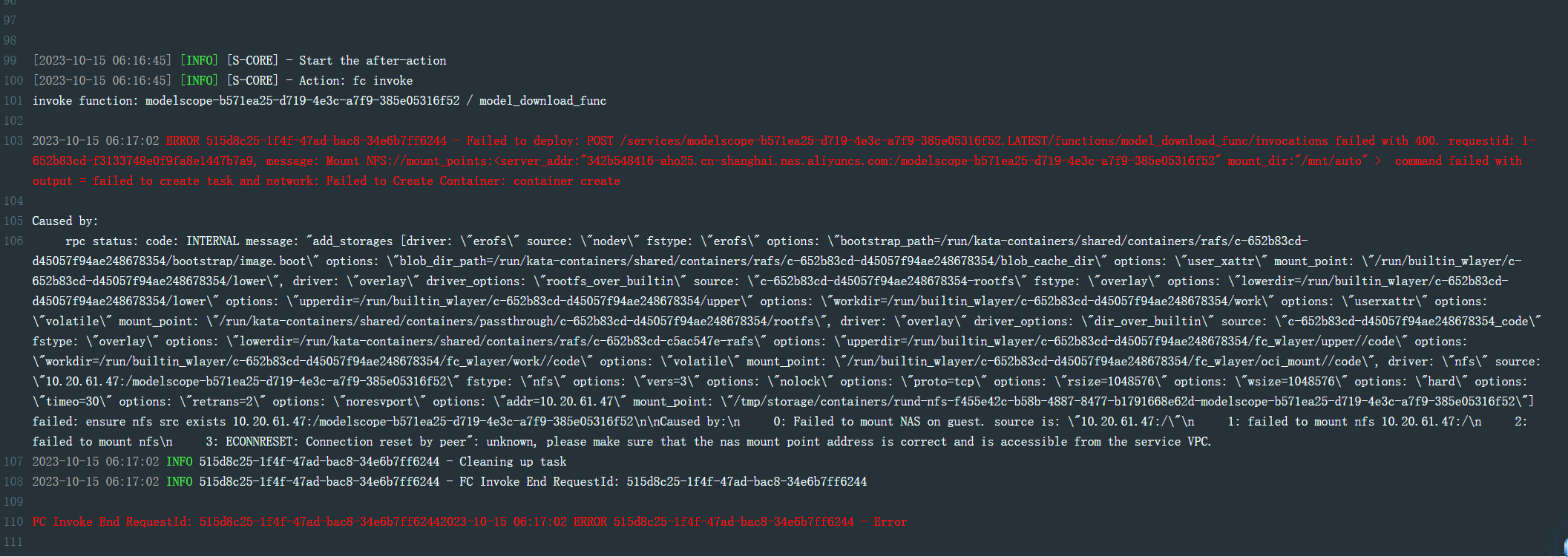

根据您提供的问题描述,函数计算在部署过程中遇到报错,且涉及多个模型(百川、GLM、通义千问)均无法成功部署。以下是针对该问题的详细分析和解决方案:

在使用函数计算部署模型时,DASHSCOPE_API_KEY 是一个关键的环境变量,用于调用模型服务。如果未正确配置或API-KEY无效,会导致部署失败。

解决方法: - 登录百炼控制台,检查是否已生成有效的API-KEY。 - 在函数计算中设置环境变量 DASHSCOPE_API_KEY,确保其值为正确的API-KEY。 - 如果API-KEY过期或无效,请重新生成并更新到函数计算的环境变量中。

不同模型对计算资源的需求不同,尤其是大模型(如Qwen-14B、Baichuan2-13B等)需要更高的GPU显存支持。如果资源不足,可能导致部署失败。

解决方法: - 检查模型资源需求: - Qwen系列模型推荐使用Tesla或Ada系列GPU。 - Baichuan2-13B及以上模型建议使用至少48G显存的GPU。 - 调整资源配置: - 在函数计算中,进入资源配置页面,选择适合的GPU型号和规格。 - 如果当前地域的GPU资源不足,建议更换其他地域进行部署。

部分模型需要手动上传模型文件(如.ckpt或.safetensors),如果文件缺失或格式不正确,会导致应用启动失败。

解决方法: - 确认模型文件已上传: - 检查是否已将模型文件上传至指定路径(如NAS文件系统)。 - 如果未上传,可以通过KodBox或其他管理工具上传模型文件。 - 检查文件格式: - 确保模型文件后缀为.ckpt或.safetensors。 - 如果从Hugging Face下载的模型文件后缀为.txt,需手动修改为.ckpt。

账户欠费或权限不足也可能导致部署失败,尤其是在挂载NAS文件系统时。

解决方法: - 检查账户状态: - 确保当前账号无欠费情况。 - 如果存在欠费,请及时充值并重试。 - 验证NAS挂载权限: - 确认NAS文件系统的挂载点地址正确,并且可以从服务VPC访问。

如果使用自定义代码部署模型,可能存在代码错误或依赖项缺失的问题。

解决方法: - 检查构建命令: - 确保本地构建命令与函数计算的构建环境一致。例如,Node.js项目的构建命令可能如下: bash npm install ./code -production --registry=https://registry.npmmirror.com zip code.zip -r ./code/* - 将构建产物(如code.zip)上传至函数计算。 - 验证依赖项: - 确保所有依赖项已正确安装,并通过s.yaml文件配置代码路径。

如果手动配置复杂且容易出错,可以尝试使用函数计算提供的一键部署模板。

解决方法: - 基于模板部署: - 登录函数计算控制台,选择应用 > CAP 应用平台,然后单击创建项目 > 基于模板创建。 - 搜索目标模型(如DeepSeek或Qwen),选择对应模板并单击立即部署。 - 部署完成后,通过公网访问测试应用是否正常运行。

如果以上方法仍无法解决问题,建议联系阿里云技术支持团队获取进一步帮助。

解决方法: - 加入钉钉用户群(群号:64970014484),与函数计算工程师即时沟通。 - 提供详细的错误日志和操作步骤,以便技术支持快速定位问题。

通过以上步骤逐一排查,您应该能够解决函数计算部署失败的问题。如果仍有疑问,请提供更多具体的错误信息以便进一步分析。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。