Flink CDC中用Flink1.17.1和Hive3.1.3,遇到问题,怎么解决?

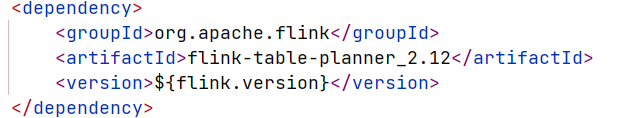

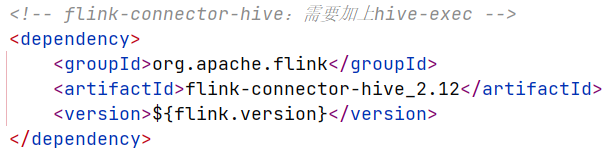

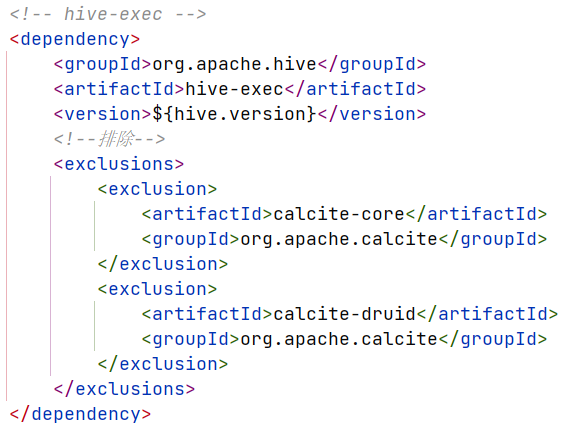

"Flink CDC中用Flink1.17.1和Hive3.1.3,我在pom.xml中设置了:

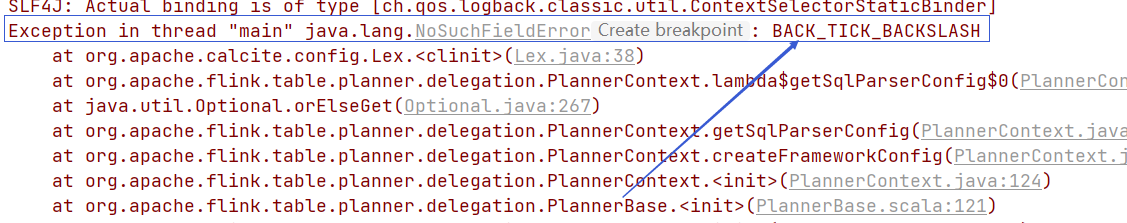

但是,遇到一个问题:

这个怎么解决呀?

https://blog.csdn.net/weixin_45181338/article/details/130740756"

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

-

北京阿里云ACE会长

根据提供的错误信息,这个问题似乎与 Flink 和 Hive 之间的依赖冲突有关。具体而言,它涉及到 SLF4J(Simple Logging Facade for Java)的绑定和 Apache Calcite 的配置。

为了解决这个问题,可以尝试以下几个步骤:

排除冲突的依赖:在您的项目中,排除引起冲突的依赖项,特别是 SLF4J 和 Apache Calcite 相关的依赖项。根据您提供的错误信息,似乎需要排除 ch.gos.logback.classic.util.ContextSelectorStaticBinder 类的绑定。您可以使用 Maven 或 Gradle 等构建工具,在 Flink 和 Hive 相关的依赖项中添加排除规则,以排除冲突的类或模块。例如,使用 Maven 的 标签。

调整依赖版本:检查您的项目中的 Flink 和 Hive 版本,确保它们与您使用的 Flink CDC 版本兼容。不同版本之间可能存在不兼容或冲突的依赖关系。尝试升级或降级 Flink 和 Hive 的版本,以找到兼容的组合。

查看日志和错误信息:根据提供的错误信息,查看更详细的日志以了解问题的具体细节。可能会提供更多有关冲突依赖项的信息,以及如何解决它们的线索。请注意查看 Flink、Hive、SLF4J 和 Apache Calcite 的日志和文档,以找到更多关于特定问题的信息。

2023-08-11 21:32:03赞同 展开评论

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。