-

北京阿里云ACE会长

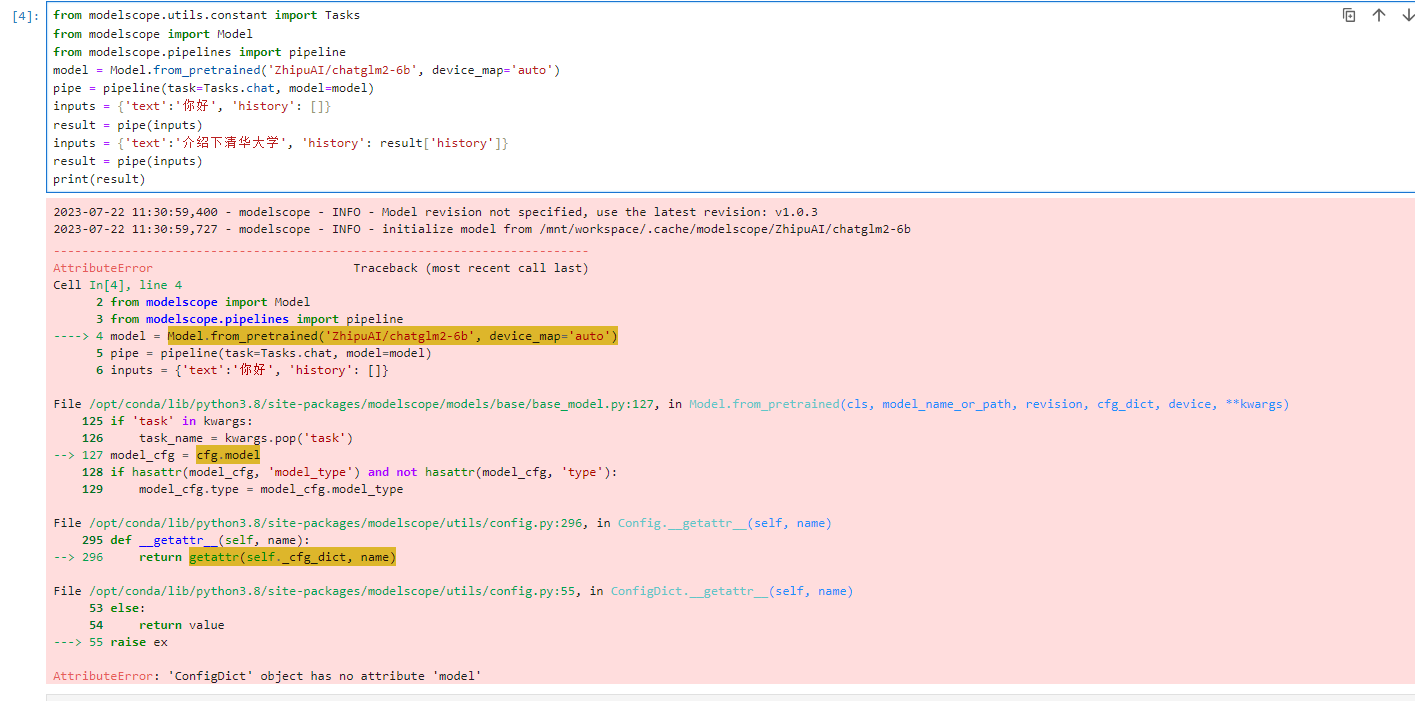

调用chatglm2-6b模型时有个错误:

AttributeError

主要可能的原因有两点:

ModelScope版本和chatglm2-6b对应版本不匹配

Model没有正确导入

具体分析:

python

Copy

from modelscope import Model

from modelscope.pipelines import pipelinemodel = Model.from_pretrained('ZhipuAI/chatglm2-6b', device='auto')

AttributeError 报错,说明 Model 类没有成功导入

pipe = pipeline(task=Tasks.chat, model=model)

你调用模型的代码存在以下问题:导入的是 from modelscope import Model,但实际应该是:

python

Copy

from modelscope.models import Model

device 参数应该是device而不是device map

要解决这个错误,需要做以下修改:python

Copy

from modelscope.models import Modelmodel = Model.from_pretrained('ZhipuAI/chatglm2-6b', device='auto')

正确导入Model类,并修改device参数的写法。希望此答案能帮助你解决AttributeError。主要是Model类没有正确导入。

2023-07-27 18:48:48赞同 展开评论 -

报错的具体原因可能有很多种,我无法确定您遇到了什么错误。但是,以下是一些可能导致使用 chatglm2-6b 模型报错的常见原因:

未正确安装依赖项:确保已正确安装并配置了 chatglm2-6b 模型所需的所有依赖项。这可能包括正确的 Python 版本、相关库和模块等。请参考 ModelScope 的官方文档或示例代码,以了解正确的安装步骤。

输入数据格式错误:检查输入给 chatglm2-6b 模型的数据格式是否符合预期。chatglm2-6b 模型可能对输入数据的类型、形状和值范围有特定的要求。确保输入数据与模型的要求相匹配。

文件路径错误:如果您正在尝试加载 chatglm2-6b 模型的权重文件或其他相关文件,请确保文件路径是正确的,并且您具备访问这些文件的权限。

模型版本不兼容:确保您使用的 chatglm2-6b 模型版本与您正在使用的 ModelScope 版本兼容。不同版本之间的 API 和功能可能存在差异,导致报错。

网络连接或服务器问题:如果 chatglm2-6b 模型需要从远程服务器下载或加载文件,网络连接不稳定或服务器出现问题可能会导致报错。请确保您的网络连接正常,并且服务器可访问。

2023-07-24 13:21:05赞同 展开评论