各位大佬,我测试起了3条线程同时往3个mysql表中写入,每条线程分别写入100000条数据,用了f

各位大佬,我测试起了3条线程同时往3个mysql表中写入,每条线程分别写入100000条数据,用了fink mysqlcdc 抽取数据,跑了大概10来分钟,后面的数据变更就读不到了,是怎么回事?改怎么分析问题呢

展开

收起

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

阿里云 AI 助理回答

遇到您描述的问题,可能涉及多个方面的原因,包括但不限于Flink作业配置、MySQL CDC源的设置、网络状况、MySQL服务器性能等。以下是一些分析和排查问题的建议:

-

检查Flink作业状态:

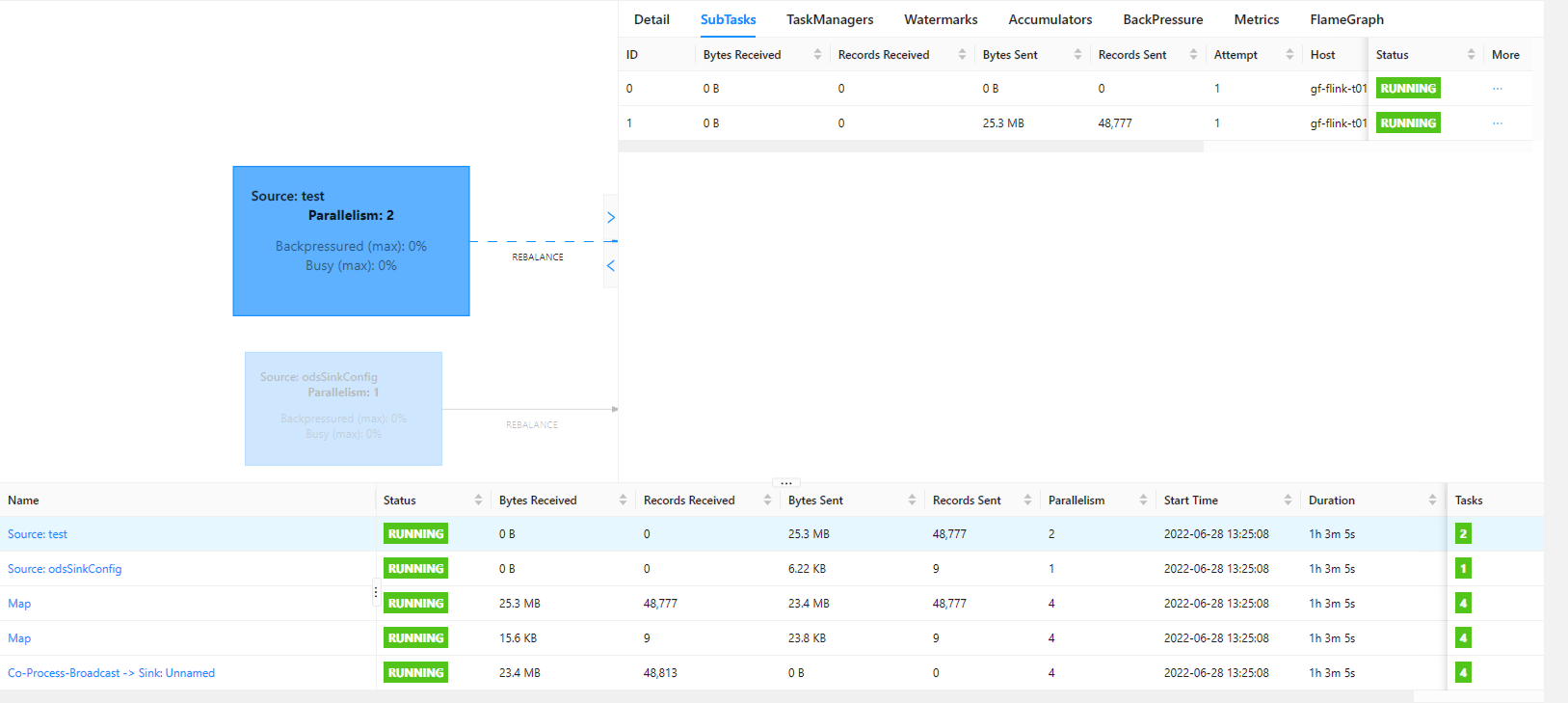

- 首先,查看Flink作业管理界面(例如通过Flink Web UI)的状态,确认作业是否还在运行,是否有异常或失败的任务。注意观察作业的背压(backpressure)情况,高背压可能会导致数据处理速度变慢。

-

检查MySQL CDC源配置:

- 确认

mysql-cdc连接器的配置是否正确,特别是与MySQL的连接参数(如地址、端口、用户名、密码)、数据库名、表名以及启动模式(如initial、latest-offset或特定时间点)。 - 检查是否设置了合理的

fetch-size(拉取数据的批次大小),过小的批次会增加网络交互次数,影响效率;过大则可能导致内存压力。

- 确认

-

监控MySQL服务器:

- 查看MySQL服务器的资源使用情况,包括CPU、内存、磁盘I/O和连接数。大量并发写入可能导致资源紧张,甚至触发MySQL的限流机制。

- 检查MySQL的错误日志和慢查询日志,看是否有相关错误信息或查询效率低下的SQL语句。

-

网络状况:

- 确保网络连接稳定,没有频繁的丢包或延迟高的情况,因为这会影响数据传输的效率和稳定性。

-

Flink作业资源分配:

- 检查Flink作业的并行度设置是否合理,确保任务管理器(TaskManager)有足够的slot来并行执行任务。如果资源不足,可能会导致任务排队等待执行。

-

Checkpoint配置:

- 如果开启了Checkpoint,检查Checkpoint的配置是否合理,过于频繁的Checkpoint会消耗资源,影响数据处理速度。同时,Checkpoint失败也可能导致作业暂停或重启。

-

日志分析:

- 仔细查看Flink作业的日志输出,通常错误信息或警告会直接指向问题所在。

- 同时,MySQL CDC源也会有相应的日志输出,关注这些日志以获取更详细的错误信息。

-

测试环境与生产环境差异:

- 如果在测试环境中未出现问题,而在生产环境中出现,考虑两者之间的配置差异,比如网络环境、硬件资源、MySQL版本及配置等。

通过上述步骤,您可以逐步定位问题所在,并针对性地进行调整优化。如果问题依然存在,建议查阅Flink官方文档或在社区论坛寻求帮助,提供更详细的错误信息和配置详情以便获得更专业的支持。

有帮助

无帮助

AI 助理回答生成答案可能存在不准确,仅供参考

问答地址:

开发者社区

>

大数据与机器学习

>

实时计算 Flink

>

问答

相关问答

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。

收录在圈子:

+ 订阅

实时计算 Flink 版(Alibaba Cloud Realtime Compute for Apache Flink,Powered by Ververica)是阿里云基于 Apache Flink 构建的企业级、高性能实时大数据处理系统,由 Apache Flink 创始团队官方出品,拥有全球统一商业化品牌,完全兼容开源 Flink API,提供丰富的企业级增值功能。

相关文章

热门讨论

热门文章

展开全部

展开全部

还有其他疑问?

咨询AI助理