下载地址:http://pan38.cn/i7c10bd81

项目编译入口:

package.json

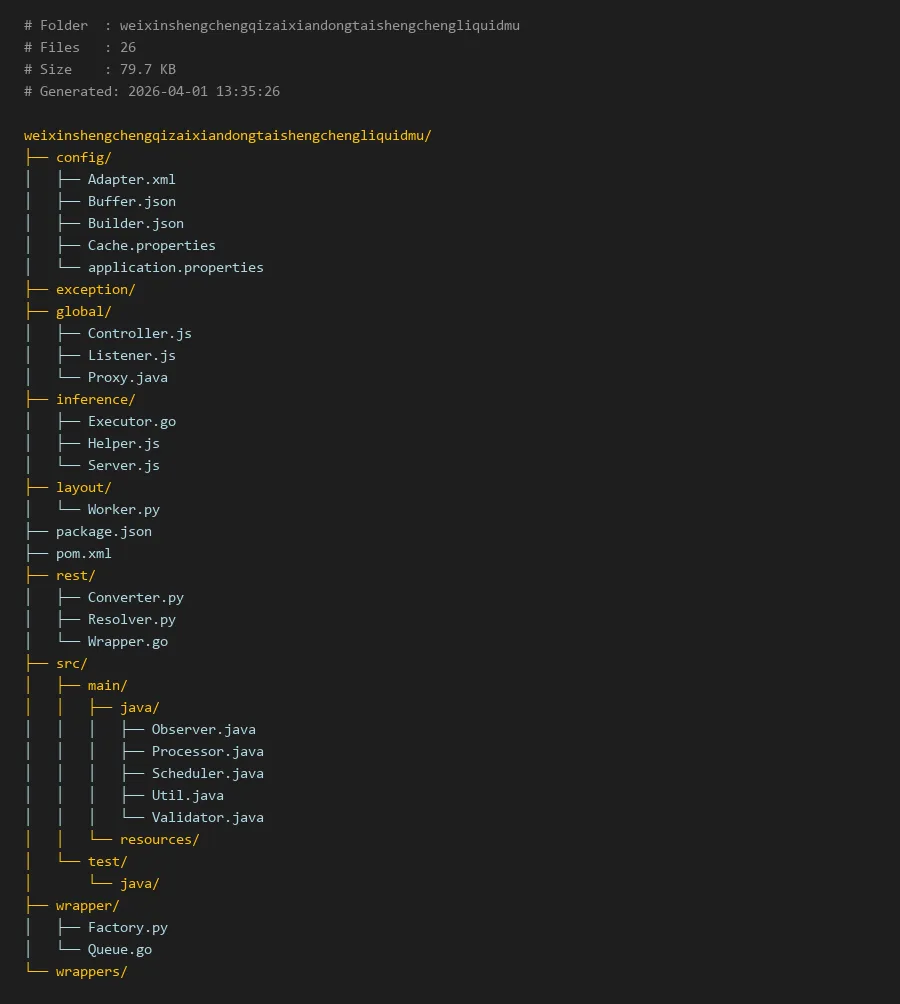

# Folder : weixinshengchengqizaixiandongtaishengchengliquidmu

# Files : 26

# Size : 79.7 KB

# Generated: 2026-04-01 13:35:26

weixinshengchengqizaixiandongtaishengchengliquidmu/

├── config/

│ ├── Adapter.xml

│ ├── Buffer.json

│ ├── Builder.json

│ ├── Cache.properties

│ └── application.properties

├── exception/

├── global/

│ ├── Controller.js

│ ├── Listener.js

│ └── Proxy.java

├── inference/

│ ├── Executor.go

│ ├── Helper.js

│ └── Server.js

├── layout/

│ └── Worker.py

├── package.json

├── pom.xml

├── rest/

│ ├── Converter.py

│ ├── Resolver.py

│ └── Wrapper.go

├── src/

│ ├── main/

│ │ ├── java/

│ │ │ ├── Observer.java

│ │ │ ├── Processor.java

│ │ │ ├── Scheduler.java

│ │ │ ├── Util.java

│ │ │ └── Validator.java

│ │ └── resources/

│ └── test/

│ └── java/

├── wrapper/

│ ├── Factory.py

│ └── Queue.go

└── wrappers/

weixinshengchengqizaixiandongtaishengchengliquidmu

简介

weixinshengchengqizaixiandongtaishengchengliquidmu 是一个用于动态生成微信群聊界面的技术项目。该项目采用多语言混合架构,通过配置驱动的方式实现高度可定制的聊天界面生成。系统能够根据不同的业务需求,实时生成包含用户头像、昵称、消息内容和时间戳的聊天记录视图。这个项目特别适合需要快速构建微信群聊展示功能的在线应用,比如"微信群聊生成器在线"服务,可以让用户无需编写复杂代码就能生成逼真的聊天截图。

核心模块说明

项目采用模块化设计,主要分为配置管理、全局控制、推理引擎、布局渲染和REST接口五个核心模块。

config/ 目录存放所有配置文件,支持XML、JSON、Properties多种格式,用于定义生成规则、缓存策略和适配器逻辑。

global/ 包含全局控制器、监听器和代理类,负责协调各个模块的工作流程。

inference/ 是核心推理引擎,包含执行器、助手和服务器,负责处理生成逻辑和业务规则。

layout/ 中的工作器专门负责界面布局的渲染和组装。

rest/ 提供对外接口,包括数据转换器、解析器和包装器,确保系统可以轻松集成到各种Web服务中。

代码示例

以下展示几个关键模块的代码实现,演示如何利用项目结构构建微信群聊生成功能。

1. 配置加载示例

首先看配置文件如何定义生成规则。config/Builder.json 控制聊天消息的构建逻辑:

{

"messageBuilder": {

"maxMessages": 50,

"defaultAvatar": "https://cdn.example.com/default_avatar.png",

"timeFormat": "YYYY-MM-DD HH:mm:ss",

"enableRandomDelay": true,

"delayRange": [0, 300]

},

"userPool": {

"minUsers": 2,

"maxUsers": 20,

"nameSource": ["config/user_names.txt", "api"],

"avatarSource": ["local", "gravatar"]

}

}

config/application.properties 定义基础配置:

# 应用基础配置

generator.mode=dynamic

generator.output.format=png

generator.output.quality=90

generator.cache.enabled=true

generator.cache.ttl=3600

# 在线服务配置

service.endpoint=/api/v1/generate

service.max.concurrent=100

service.timeout.ms=5000

2. 全局控制器实现

global/Controller.js 是系统的核心协调器:

class WeChatGroupController {

constructor(config) {

this.config = config;

this.inferenceExecutor = require('../inference/Executor');

this.layoutWorker = require('../layout/Worker');

this.cacheAdapter = this.initCacheAdapter();

}

async generateConversation(requestData) {

try {

// 检查缓存

const cacheKey = this.generateCacheKey(requestData);

const cached = await this.cacheAdapter.get(cacheKey);

if (cached) return cached;

// 执行推理生成消息数据

const messages = await this.inferenceExecutor.execute(requestData);

// 渲染布局

const result = await this.layoutWorker.render(messages, requestData.layout);

// 存入缓存

await this.cacheAdapter.set(cacheKey, result, this.config.cache.ttl);

return result;

} catch (error) {

console.error('生成失败:', error);

throw new Error('微信群聊生成失败');

}

}

generateCacheKey(data) {

return `wechat_group_${

JSON.stringify(data)}`;

}

initCacheAdapter() {

const config = require('../config/Cache.properties');

// 根据配置初始化缓存适配器

return new CacheAdapter(config);

}

}

module.exports = WeChatGroupController;

3. 推理引擎执行器

inference/Executor.go 处理消息生成的业务逻辑:

```go

package inference

type Message struct {

UserID string json:"user_id"

UserName string json:"user_name"

AvatarURL string json:"avatar_url"

Content string json:"content"

Timestamp int64 json:"timestamp"

IsSelf bool json:"is_self"

}

type Executor struct {

config map[string]interface{}

helper *Helper

}

func NewExecutor(configPath string) *Executor {

config := loadConfig(configPath)

return &Executor{

config: config,

helper: NewHelper(),

}

}

func (e *Executor) Execute(request Request) ([]Message, error) {

var messages []Message

// 生成用户池

users := e.generateUserPool(request.UserCount)

// 生成消息序列

for i := 0; i < request.MessageCount; i++ {

user := e.selectRandomUser(users)

content := e.generateMessageContent(request.Topic)

message := Message{

UserID: user.ID,

UserName: user.Name,

AvatarURL: user.Avatar,

Content: content,

Timestamp: e.generateTimestamp(request.StartTime, i),

IsSelf: user.ID == request.SelfID,

}

messages = append(messages, message)

}

// 按时间排序

messages = e.sortMessagesByTime(m