下载地址:http://pan38.cn/i9607f232

项目编译入口:

package.json

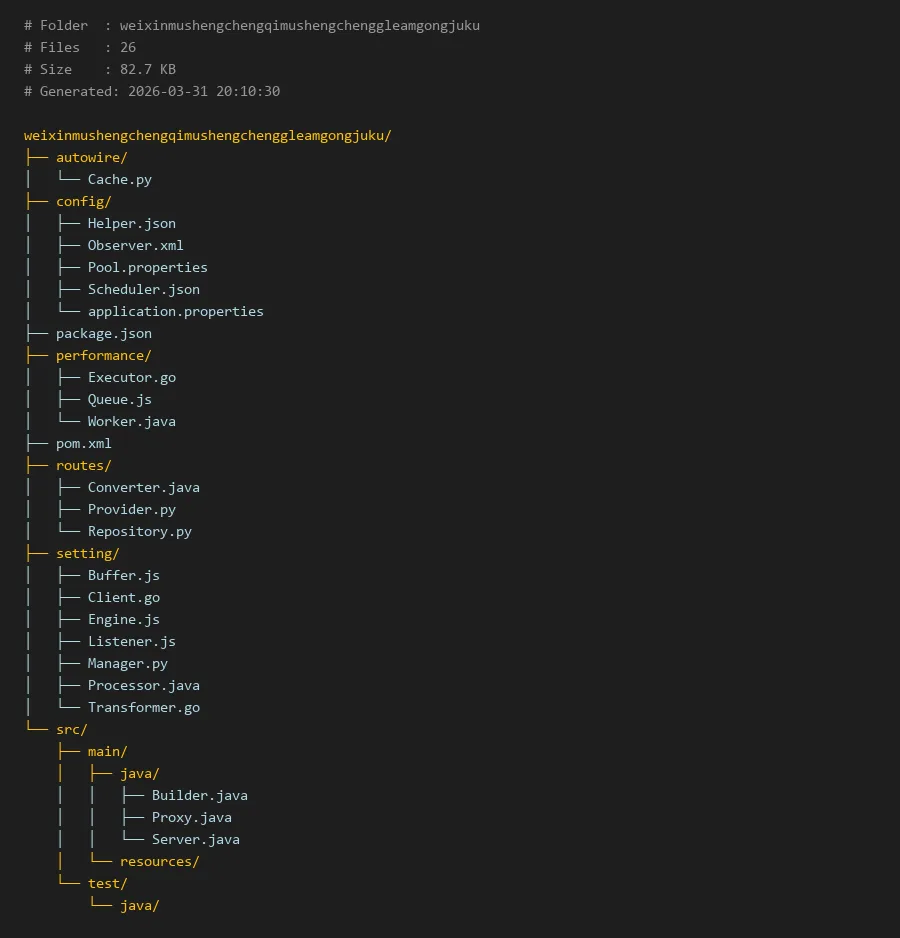

# Folder : weixinmushengchengqimushengchenggleamgongjuku

# Files : 26

# Size : 82.7 KB

# Generated: 2026-03-31 20:10:30

weixinmushengchengqimushengchenggleamgongjuku/

├── autowire/

│ └── Cache.py

├── config/

│ ├── Helper.json

│ ├── Observer.xml

│ ├── Pool.properties

│ ├── Scheduler.json

│ └── application.properties

├── package.json

├── performance/

│ ├── Executor.go

│ ├── Queue.js

│ └── Worker.java

├── pom.xml

├── routes/

│ ├── Converter.java

│ ├── Provider.py

│ └── Repository.py

├── setting/

│ ├── Buffer.js

│ ├── Client.go

│ ├── Engine.js

│ ├── Listener.js

│ ├── Manager.py

│ ├── Processor.java

│ └── Transformer.go

└── src/

├── main/

│ ├── java/

│ │ ├── Builder.java

│ │ ├── Proxy.java

│ │ └── Server.java

│ └── resources/

└── test/

└── java/

微信模拟生成器:一个多语言工具库的架构解析

简介

在当今快速发展的软件开发领域,模拟数据生成工具已成为测试和开发过程中不可或缺的组成部分。微信模拟生成器下载需求日益增长,开发者需要一个能够生成逼真微信交互数据的工具库。本文介绍的项目正是一个多语言实现的微信模拟生成器工具库,它采用模块化设计,支持Java、Python、Go和JavaScript等多种编程语言,为开发者提供了灵活的集成方案。

该项目采用微服务架构思想,将不同功能模块分离,通过配置文件进行统一管理。工具库的核心目标是生成模拟微信消息、用户资料、聊天记录等数据,适用于自动化测试、演示系统开发和教育培训等多种场景。随着微信生态系统的扩展,微信模拟生成器下载和使用已成为许多开发团队的常规需求。

核心模块说明

配置管理模块

位于config/目录下的配置文件是整个系统的控制中心。application.properties定义了全局参数,如生成器的工作模式、默认语言设置和输出格式。Helper.json和Scheduler.json分别提供了辅助函数配置和任务调度规则,而Observer.xml和Pool.properties则负责监控机制和资源池管理。

路由处理模块

routes/目录包含了数据转换和提供的核心逻辑。Converter.java负责不同数据格式之间的转换,Provider.py实现数据生成算法,Repository.py则管理生成数据的存储和检索。这三个文件共同构成了数据生成流程的主干。

性能优化模块

performance/目录下的文件针对高并发场景进行了优化。Executor.go实现了高效的协程管理,Queue.js处理任务队列,Worker.java则是工作线程的具体实现。这种多语言混合的设计使得系统能够根据具体场景选择最合适的执行策略。

自动装配模块

autowire/Cache.py实现了依赖注入和缓存机制,显著提高了数据生成的速度。通过智能缓存策略,重复生成相似数据时可以直接从缓存中读取,避免了重复计算。

设置管理模块

setting/目录包含了客户端配置和引擎设置。Engine.js是生成器的核心引擎,Client.go提供了命令行接口,Buffer.js和Listener则分别处理数据缓冲和事件监听。

代码示例

配置文件示例

首先,让我们查看主配置文件的结构:

# config/application.properties

# 微信模拟生成器基础配置

generator.mode=balanced

generator.default_language=zh_CN

output.format=json

output.encoding=UTF-8

cache.enabled=true

cache.ttl=3600

concurrency.max_workers=10

concurrency.queue_size=1000

wechat.api_version=3.0

wechat.simulate_delay=true

wechat.delay_range=100-500

接下来是辅助配置文件的示例:

// config/Helper.json

{

"message_templates": {

"text": {

"patterns": [

"你好,{name}!",

"{name},在忙什么呢?",

"今天天气不错,{name}要出去走走吗?"

],

"variables": {

"name": ["张三", "李四", "王五", "赵六"]

}

},

"image": {

"sources": [

"local://images/nature/",

"remote://cdn.wechat-simulator.com/"

],

"formats": ["jpg", "png", "gif"]

}

},

"user_profiles": {

"avatar_styles": ["casual", "formal", "cartoon"],

"region_distribution": {

"北京": 0.15,

"上海": 0.12,

"广州": 0.10,

"深圳": 0.08,

"其他": 0.55

}

}

}

核心生成器实现

以下是Python提供者的关键代码:

```python

routes/Provider.py

import json

import random

from datetime import datetime, timedelta

from typing import Dict, List, Any

class WeChatMessageProvider:

def init(self, config_path: str = "config/Helper.json"):

with open(config_path, 'r', encoding='utf-8') as f:

self.config = json.load(f)

self.message_templates = self.config["message_templates"]

self.user_profiles = self.config["user_profiles"]

def generate_text_message(self, sender_id: str, receiver_id: str) -> Dict[str, Any]:

"""生成文本消息"""

template = random.choice(self.message_templates["text"]["patterns"])

name_var = random.choice(self.message_templates["text"]["variables"]["name"])

content = template.replace("{name}", name_var)

return {

"msg_id": self._generate_msg_id(),

"sender": sender_id,

"receiver": receiver_id,

"content": content,

"type": "text",

"timestamp": self._generate_timestamp(),

"status": "sent"

}

def generate_user_profile(self, user_id: str = None) -> Dict[str, Any]:

"""生成用户资料"""

if not user_id:

user_id = f"wxid_{random.randint(10000000, 99999999)}"

region = self._select_region()

return {

"user_id": user_id,

"nickname": self._generate_nickname(),

"avatar": self._generate_avatar_url(),

"region": region,

"gender": random.choice