下载地址:http://lanzou.co/i210e2b8f

项目编译入口:

package.json

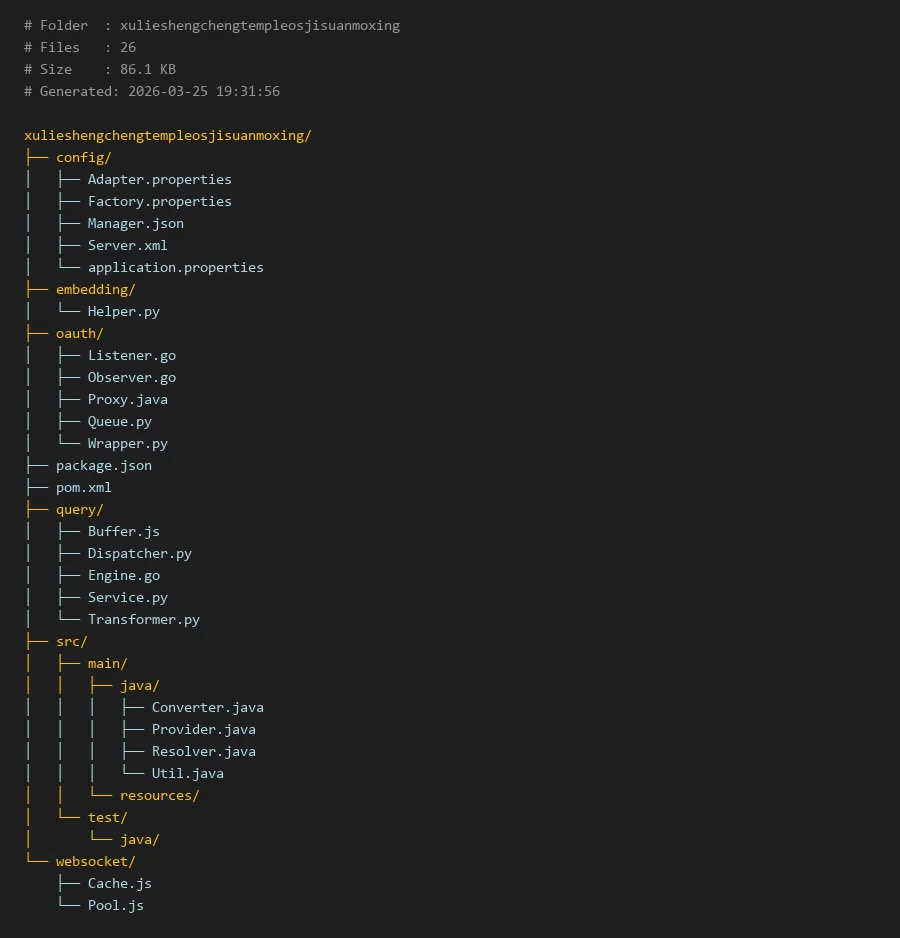

# Folder : xulieshengchengtempleosjisuanmoxing

# Files : 26

# Size : 86.1 KB

# Generated: 2026-03-25 19:31:56

xulieshengchengtempleosjisuanmoxing/

├── config/

│ ├── Adapter.properties

│ ├── Factory.properties

│ ├── Manager.json

│ ├── Server.xml

│ └── application.properties

├── embedding/

│ └── Helper.py

├── oauth/

│ ├── Listener.go

│ ├── Observer.go

│ ├── Proxy.java

│ ├── Queue.py

│ └── Wrapper.py

├── package.json

├── pom.xml

├── query/

│ ├── Buffer.js

│ ├── Dispatcher.py

│ ├── Engine.go

│ ├── Service.py

│ └── Transformer.py

├── src/

│ ├── main/

│ │ ├── java/

│ │ │ ├── Converter.java

│ │ │ ├── Provider.java

│ │ │ ├── Resolver.java

│ │ │ └── Util.java

│ │ └── resources/

│ └── test/

│ └── java/

└── websocket/

├── Cache.js

└── Pool.js

序列生成模板OS计算模型

简介

序列生成模板OS计算模型是一个多语言混合架构的序列生成系统,采用操作系统设计理念构建。该系统将序列生成任务分解为多个核心模块,每个模块使用最适合的编程语言实现,通过统一的配置管理和进程间通信机制协同工作。系统借鉴了操作系统中的进程调度、内存管理和设备驱动等概念,为大规模序列生成任务提供了可扩展、高性能的解决方案。

核心模块说明

系统包含五个核心模块:配置管理、嵌入处理、认证授权、查询引擎和主程序模块。每个模块都有明确的职责和接口定义。

配置管理模块位于config目录,采用多种配置文件格式(properties、JSON、XML)管理不同粒度的配置信息。Adapter.properties定义适配器参数,Factory.properties配置工厂模式,Manager.json管理运行时状态,Server.xml定义服务端配置,application.properties包含应用级设置。

嵌入处理模块在embedding目录下,Helper.py提供词向量嵌入和序列编码功能,支持多种预训练模型集成。

认证授权模块位于oauth目录,实现OAuth 2.0协议和权限管理。Listener.go处理认证请求,Observer.go监控认证状态,Proxy.java提供代理服务,Queue.py管理请求队列,Wrapper.py封装第三方认证服务。

查询引擎模块在query目录下,负责序列查询和转换。Buffer.js实现缓存机制,Dispatcher.py分配查询任务,Engine.go执行核心查询逻辑,Service.py提供查询服务接口,Transformer.py处理序列格式转换。

主程序模块在src目录中,包含系统的主要业务逻辑和启动入口。

代码示例

配置管理模块示例

# config/application.properties

# 序列生成基础配置

sequence.max_length=1024

sequence.batch_size=32

generation.temperature=0.7

generation.top_p=0.9

generation.beam_size=5

# 模型路径配置

model.path=/models/sequence_generator

embedding.model=bert-base-chinese

cache.enabled=true

// config/Manager.json

{

"runtime": {

"max_workers": 8,

"memory_limit": "4G",

"timeout": 300,

"retry_attempts": 3

},

"modules": {

"embedding": {

"enabled": true,

"provider": "local",

"dimension": 768

},

"query": {

"cache_size": 10000,

"concurrent_queries": 100

},

"oauth": {

"token_expiry": 3600,

"refresh_enabled": true

}

}

}

嵌入处理模块示例

# embedding/Helper.py

import numpy as np

import torch

from transformers import AutoTokenizer, AutoModel

from typing import List, Union

class EmbeddingHelper:

def __init__(self, model_name: str = "bert-base-chinese"):

"""初始化嵌入助手"""

self.tokenizer = AutoTokenizer.from_pretrained(model_name)

self.model = AutoModel.from_pretrained(model_name)

self.model.eval()

def encode_sequence(self, text: Union[str, List[str]],

max_length: int = 512) -> np.ndarray:

"""

编码文本序列为向量

Args:

text: 输入文本或文本列表

max_length: 最大序列长度

Returns:

文本嵌入向量

"""

if isinstance(text, str):

text = [text]

inputs = self.tokenizer(

text,

padding=True,

truncation=True,

max_length=max_length,

return_tensors="pt"

)

with torch.no_grad():

outputs = self.model(**inputs)

embeddings = outputs.last_hidden_state[:, 0, :].numpy()

return embeddings

def batch_encode(self, sequences: List[str],

batch_size: int = 32) -> List[np.ndarray]:

"""批量编码序列"""

embeddings = []

for i in range(0, len(sequences), batch_size):

batch = sequences[i:i + batch_size]

batch_embeddings = self.encode_sequence(batch)

embeddings.extend(batch_embeddings)

return embeddings

查询引擎模块示例

```python

query/Dispatcher.py

import asyncio

import threading

from concurrent.futures import ThreadPoolExecutor

from typing import Dict, List, Any, Callable

import time

class QueryDispatcher:

def init(self, max_workers: int = 4):

"""初始化查询分发器"""

self.max_workers = max_workers

self.executor = ThreadPoolExecutor(max_workers=max_workers)

self.task_queue = asyncio.Queue()

self.results_cache = {}

self.lock = threading.Lock()

async def dispatch_query(self,

query_id: str,

query_func: Callable,

*args, **kwargs) -> Any:

"""

分发查询任务

Args:

query_id: 查询ID

query_func: 查询函数

*args, **kwargs: 查询参数

Returns:

查询结果

"""

# 检查缓存

with self.lock:

if query_id in self.results_cache:

return self.results_cache[query_id]

# 提交任务到线程池

loop = asyncio.get_event_loop()

result = await loop