基于 YOLO26 的火灾火焰智能检测系统(中英文双版) | 附完整源码与效果演示

引言

随着人工智能技术的快速发展,计算机视觉在安防监控、工业安全、森林防火等领域的应用日益广泛。火焰检测作为计算机视觉的重要研究方向之一,对于预防火灾、保障人民生命财产安全具有重要意义。传统的火焰检测方法主要依赖烟雾传感器和温度传感器,存在响应延迟、易受环境干扰等局限性。基于深度学习的视觉火焰检测技术能够实时分析视频流,实现早期火灾预警,具有检测速度快、准确率高的优势。

本文介绍一种基于YOLO26目标检测算法的火焰检测系统,该系统能够在复杂环境下快速准确地识别火焰目标,为智能安防和火灾预警提供可靠的技术支持。

背景意义

火灾是威胁公共安全的重大灾害之一,据统计,全球每年因火灾造成的经济损失高达数千亿美元,更有大量人员伤亡。传统的火灾报警系统主要依赖物理传感器,如烟雾探测器和热敏传感器,这些设备虽然在一定程度上能够发挥作用,但存在明显的局限性:

- 响应延迟:物理传感器需要烟雾或热量达到一定浓度和温度才能触发报警,往往错过了最佳灭火时机

- 覆盖范围有限:单个传感器的监测范围较小,大面积区域需要部署大量设备

- 环境适应性差:在户外、大风、高粉尘等恶劣环境下,传统传感器容易出现误报或漏报

- 无法定位火源:传统传感器只能报警,无法提供火源的精确位置信息

基于计算机视觉的火焰检测技术利用摄像头采集图像或视频,通过深度学习算法实时分析画面内容,能够在火焰出现的早期阶段进行识别和定位。这种技术具有以下优势:

- 检测速度快:基于GPU加速的深度学习模型可以实现毫秒级响应

- 检测范围广:单个摄像头可以覆盖数百平方米的监控区域

- 定位精度高:可以精确标注火焰在画面中的位置,便于后续处置

- 适应性强:通过大量数据训练,模型可以适应各种复杂环境

项目视频展示

https://www.bilibili.com/video/BV1X7ADz9EPx

包含:

📦完整项目源码

📦预训练模型权重

🗂️数据集

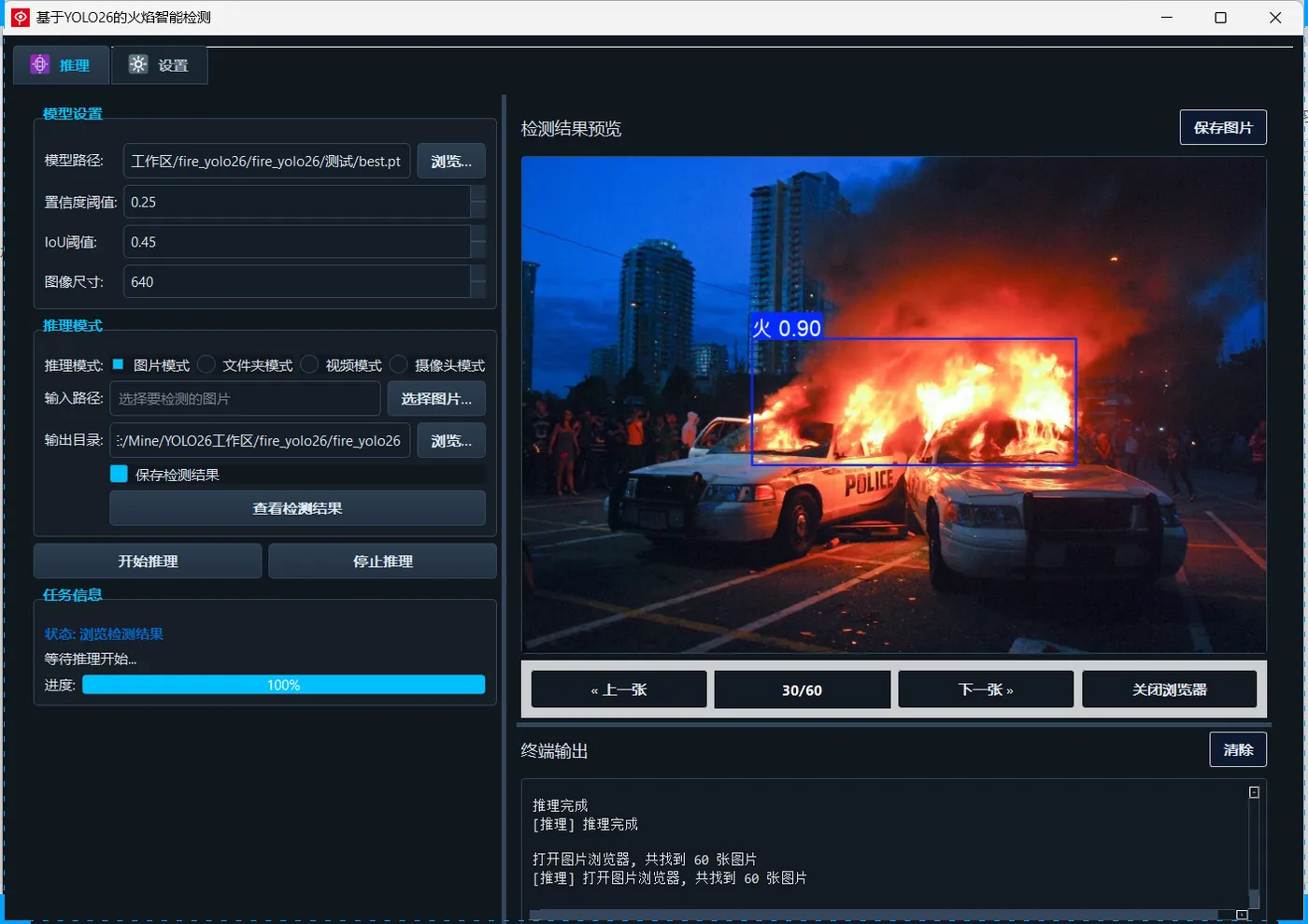

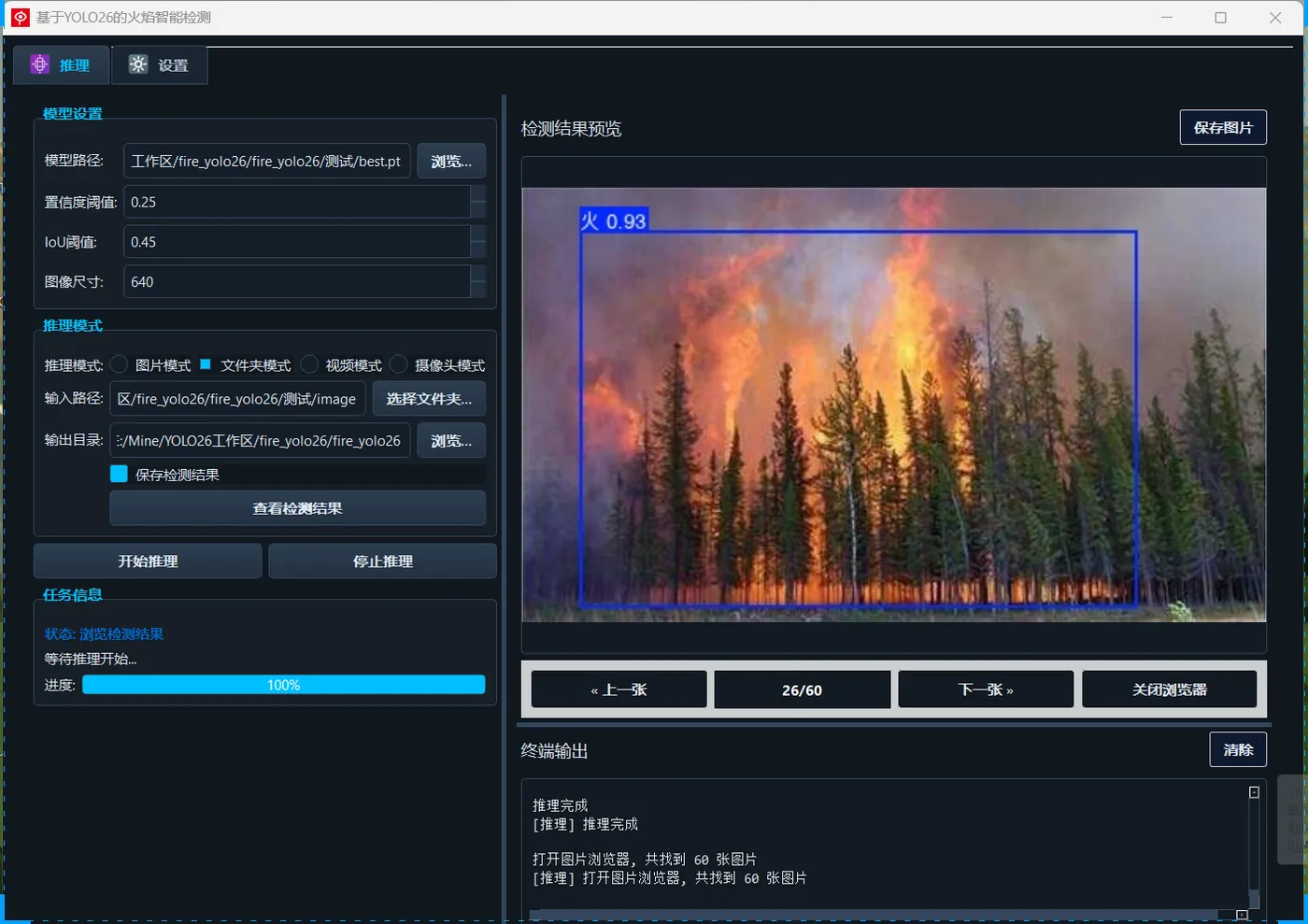

项目详细效果展示

数据集信息

本项目使用的火焰检测数据集采用YOLO格式标注,包含训练集和验证集两个部分。数据集配置文件data.yaml定义了数据路径、类别数量以及类别名称等关键信息。

数据集采用标准的YOLO标注格式,每个图像对应一个同名的txt标注文件。标注文件中的每一行代表一个目标对象,包含五个数值:类别索引、目标中心点的归一化x坐标、目标中心点的归一化y坐标、归一化宽度、归一化高度。这种格式简洁高效,便于模型训练和推理。

数据集包含单一类别"fire"(火焰),所有标注都围绕火焰目标进行。训练过程中采用了数据增强技术,包括随机翻转、色彩抖动、Mosaic增强等,以提高模型的泛化能力和鲁棒性。

本项目主要工作

本项目的主要工作包括以下几个方面:

数据集构建与预处理:收集并整理火焰图像数据,进行人工标注,构建高质量的火焰检测数据集。对数据进行清洗、格式转换和增强处理,确保训练数据的质量和多样性。

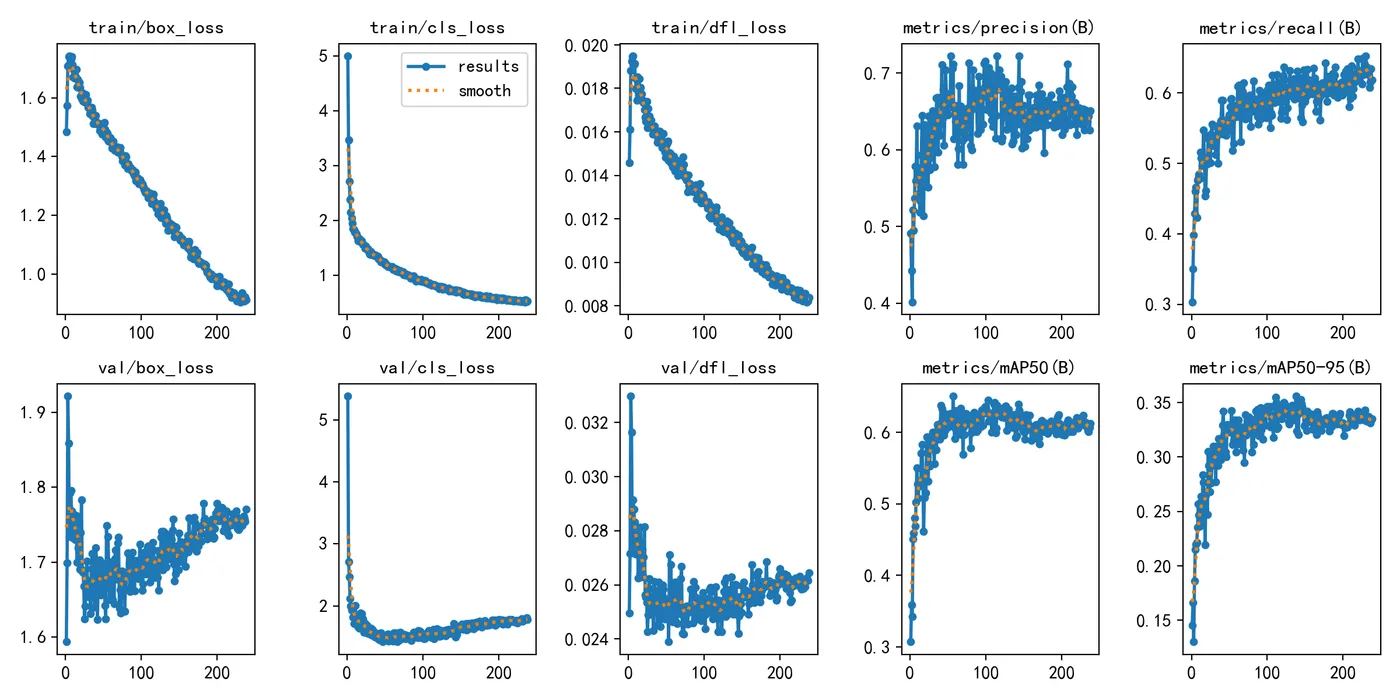

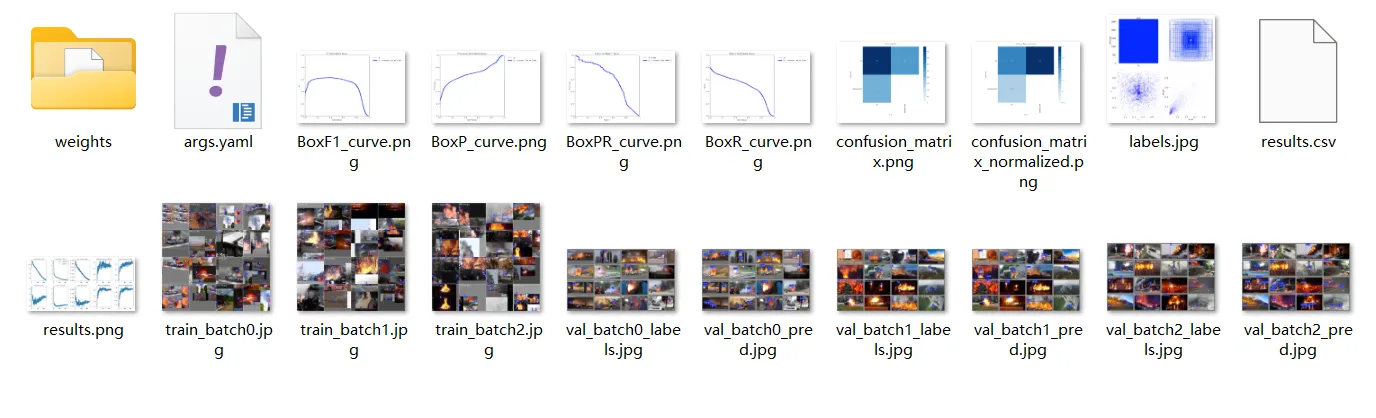

模型选型与训练:选用YOLO26作为基础检测模型,该模型在速度和精度之间取得了良好的平衡。针对火焰检测任务的特点,调整模型结构和训练参数,进行多轮迭代训练优化。

模型优化与评估:通过调整学习率、批量大小、数据增强策略等超参数,优化模型性能。使用混淆矩阵、PR曲线、F1曲线等多种指标全面评估模型效果。

部署与测试:将训练好的模型导出为部署格式,在实际场景中进行测试验证,评估模型的实时性和准确性。

国内外研究现状

火焰检测技术的研究经历了从传统图像处理方法到深度学习方法的演进过程。

传统方法阶段:早期的火焰检测主要基于图像的颜色特征、纹理特征和运动特征。研究人员利用火焰在RGB或HSV颜色空间中的特定分布规律,结合火焰闪烁的频率特性进行检测。这类方法计算简单,但在复杂背景下容易产生误检,且对光照变化敏感。

机器学习阶段:随着机器学习技术的发展,支持向量机(SVM)、随机森林(Random Forest)等算法被应用于火焰检测。这些方法通过手工设计的特征(如颜色直方图、纹理描述子)结合分类器进行火焰识别,相比纯规则方法有一定提升,但特征设计依赖专家经验,泛化能力有限。

深度学习阶段:近年来,基于卷积神经网络(CNN)的目标检测算法在火焰检测领域取得了突破性进展。从R-CNN系列到YOLO系列,检测速度和精度不断提升。

国际上,研究人员在火焰检测数据集构建、模型轻量化、多场景适应性等方面开展了大量工作。国内学者则结合中国特有的应用场景,在森林火灾监测、工业火灾预警等方向取得了丰硕成果。

快速开始-部署指南

本项目的部署流程如下所示:

flowchart TD

A[环境准备] --> B[安装依赖]

B --> C[数据集配置]

C --> D[模型训练]

D --> E[模型评估]

E --> F[模型导出]

F --> G[部署推理]

A --> A1[Python 3.8+]

A --> A2[CUDA 11.0+]

A --> A3[PyTorch 2.0+]

B --> B1[pip install ultralytics]

C --> C1[配置data.yaml]

C --> C2[准备图像数据]

C --> C3[准备标注文件]

D --> D1[选择预训练模型]

D --> D2[设置训练参数]

D --> D3[启动训练]

E --> E1[验证集测试]

E --> E2[性能指标分析]

F --> F1[导出ONNX格式]

F --> F2[导出TensorRT格式]

G --> G1[本地推理]

G --> G2[摄像头实时检测]

环境要求:

- Python 3.8或更高版本

- PyTorch 2.0或更高版本

- CUDA 11.0或更高版本(GPU训练)

- ultralytics库

训练配置参数:

- 输入尺寸:640x640

- 训练轮数:250轮

- 批次大小:16

- 学习率:自动优化

- 数据增强:Mosaic、MixUp、随机翻转等

推理部署:

训练完成后,模型可以导出为多种格式进行部署,包括PyTorch格式、ONNX格式、TensorRT格式等,以适应不同的部署环境需求。

技术亮点

本项目的技术亮点主要体现在以下几个方面:

高效的网络架构:采用YOLO26作为基础框架,该模型采用了先进的C2f模块和SPPF模块,在保持较高检测精度的同时,大幅提升了推理速度,能够满足实时检测的需求。

优化的训练策略:训练过程中采用了多种优化技术,包括:

- Mosaic数据增强:将四张图片随机拼接,增加小目标检测能力

- 混合精度训练:使用AMP自动混合精度,减少显存占用,加速训练

- 学习率调度:采用Cosine Annealing策略,帮助模型更好地收敛

- 早停机制:设置耐心值,防止过拟合

完善的评估体系:项目建立了全面的模型评估体系,通过混淆矩阵分析各类别的检测性能,通过PR曲线和F1曲线评估模型的精确率和召回率平衡,确保模型在实际应用中的可靠性。

灵活的部署方案:支持多种导出格式,可以根据部署环境选择最合适的模型格式。无论是在服务器端进行大规模视频分析,还是在边缘设备进行实时检测,都能找到合适的解决方案。

单类别专注优化:针对火焰这一单一类别进行专门优化,模型可以集中学习火焰的视觉特征,避免了多类别之间的干扰,提高了检测的准确性和稳定性。

总结

本文介绍了一种基于YOLO26的火焰检测系统,从数据集构建、模型训练到部署应用进行了全面的阐述。该系统具有以下特点:

检测性能优异:通过充分的训练和优化,模型在验证集上表现出良好的检测精度和召回率,能够有效识别各种场景下的火焰目标。

实时性强:基于YOLO26的单阶段检测架构,模型推理速度快,能够满足实时监控的需求,为火灾早期预警提供了技术保障。

部署灵活:支持多种导出格式和部署方式,可以根据实际应用场景选择合适的部署方案,具有良好的工程实用性。

扩展性好:项目架构清晰,代码规范,便于后续功能扩展和性能优化。可以在此基础上增加烟雾检测、多类别火灾检测等功能。

未来工作可以从以下几个方向进行改进:

- 收集更多场景的数据,进一步提升模型的泛化能力

- 探索模型轻量化技术,使其能够在更低算力的设备上运行

- 结合时序信息,利用视频帧之间的关联提升检测稳定性

- 开发完整的火灾预警系统,集成报警、通知等功能

火焰检测技术在智能安防、工业监控、森林防火等领域具有广阔的应用前景。随着深度学习技术的不断发展和计算能力的持续提升,基于视觉的火焰检测系统将发挥越来越重要的作用,为构建安全和谐的社会环境贡献力量。