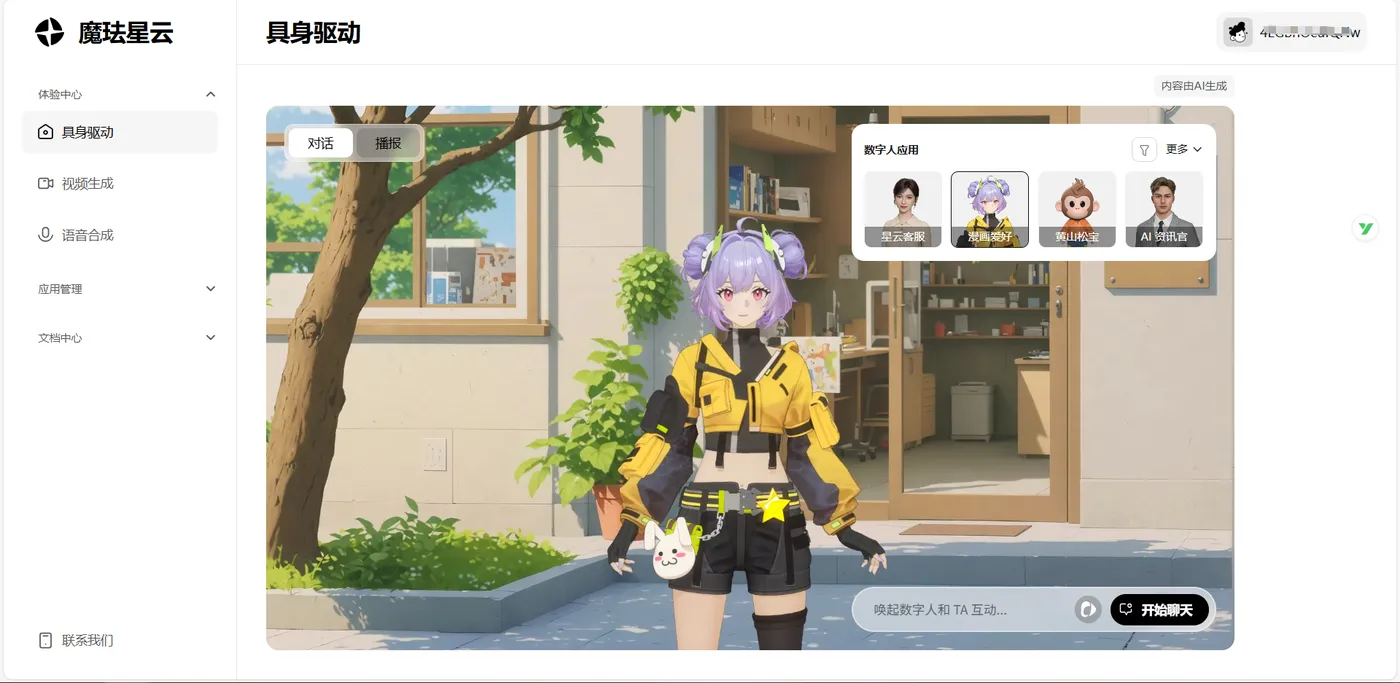

最近在研究具身智能时,我发现了一个让人眼前一亮的平台——魔珐星云。

它解决了一个困扰行业已久的问题:如何让大模型不仅能"思考",还能拥有真实的"身体"去表达和交互?

传统的AI要么只输出文字,要么顶多加个语音,但星云做到了让AI以3D数字人的形式,实时生成语音、表情和动作,用他们自己的话说,这是"具身智能的iPhone时刻"。

1 什么是具身智能?为什么说星云是基础设施?

具身智能(Embodied AI)简单理解就是"大模型有了身体"。

当你和ChatGPT对话时,如果它不只是冷冰冰的文字回复,而是以一个3D数字人的形象出现,能做出恰当的表情、手势,甚至根据对话内容跳个舞,这种交互体验完全不在一个次元。

星云平台正是要做具身智能的基础设施,它提供了一整套SDK,涵盖3D数字人渲染、语音合成、动作驱动、端侧渲染等核心能力。

开发者不需要从零搭建复杂的图形引擎或动作捕捉系统,只需调用SDK接口,就能快速构建出能看、能听、能说、能动的具身智能应用。

平台的六大核心优势——高质量渲染、低延时交互、高并发支持、低成本部署、多端适配、多风格兼容,真正做到了工业级水准。

下方是六大核心能力的详细描述:

- 高质量:逼真 3D 形象,实时生成自然生动的声音、表情与动作,赋予人物真实可信的表达力。

- 低延时:500ms 驱动响应,交互实时流畅自然;支持随时打断,贴近真人对话体验。

- 低成本:百元级芯片即可运行,大幅降低部署门槛,支持大规模普及。

- 高并发:支持千万级设备同时驱动,轻松应对批量化接入,保障体验稳定可靠。

- 多风格:覆盖超写实、二次元、卡通、美型等多样角色风格和人设,场景和角色可灵活选择。

- 多终端:全面适配手机、车机、Pad、PC、电视与大屏,兼容 Android、iOS、鸿蒙等主流系统。

更关键的是,星云打破了3D数字人领域的"不可能三角"——高质量、低延时、低成本,三者以往很难兼得。

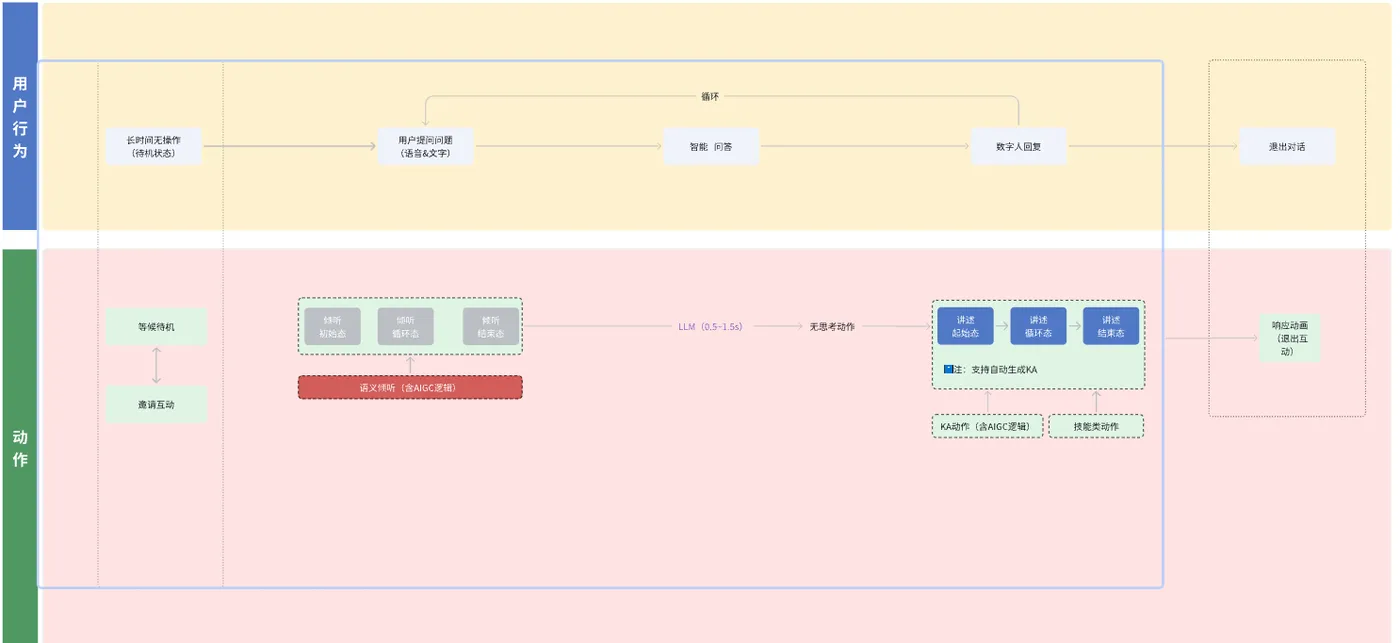

这是数字人状态流转图的架构搭建:

通过文生3D多模态动作大模型和AI端渲染解算技术,星云实现了在普通硬件上运行电影级数字人,甚至在RK3566这种没有独立GPU的芯片上都能流畅渲染720P画质。这对于想要大规模部署具身智能应用的开发者来说,简直是福音。

2 从零到数字人只需三步

我按照官方文档实际跑了一遍SDK,整个流程出乎意料的简单。这里分享下我的实操步骤。

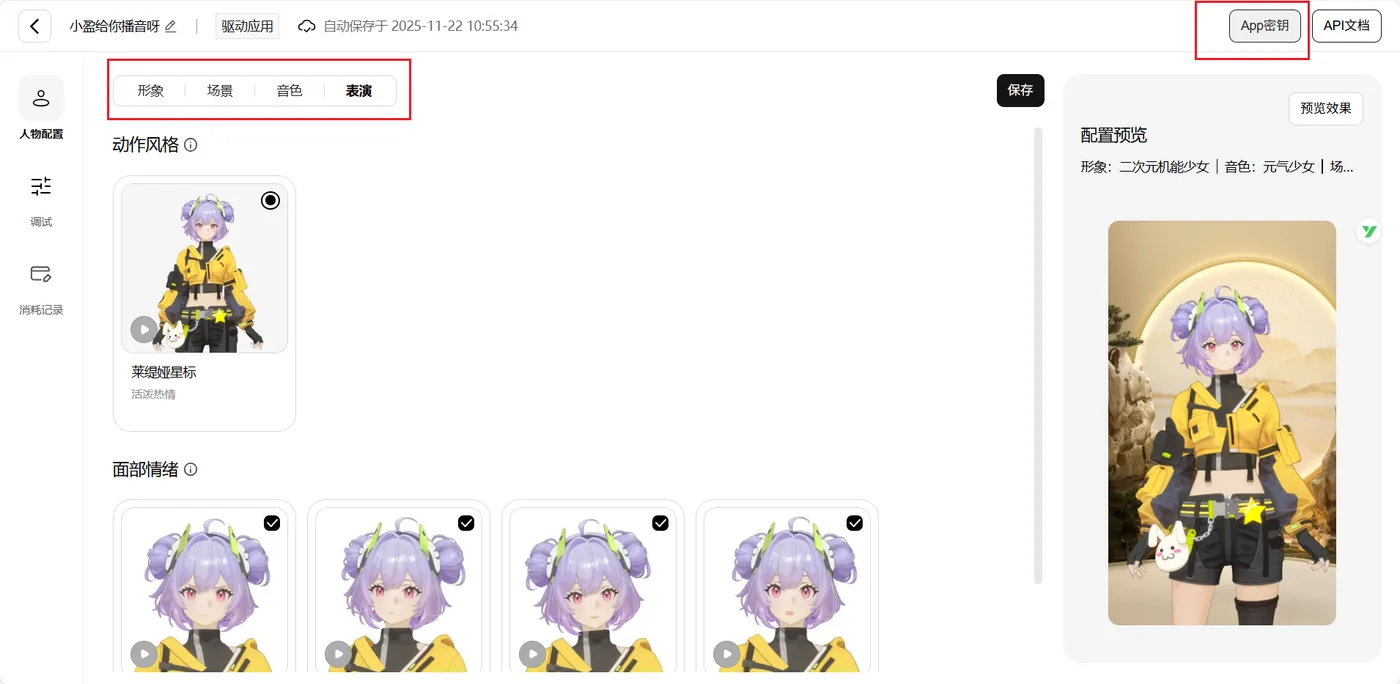

(1)平台配置与应用创建

首先需要在全球领先的具身智能3D数字人开放平台 - 魔珐星云 注册账号,进入应用中心创建一个具身驱动应用。

这个过程非常直观:

- 选择你想要的数字人角色(平台提供了多种预设角色)

- 配置音色(支持多种音色选择,还能调整语速、音调等参数)

- 设置表演风格(这个很有意思,不同风格会影响数字人的肢体语言和表情丰富度)

创建完成后,系统会生成对应的App ID和App Secret,这两个密钥后续要用在代码里。整个过程不超过5分钟,真正做到了"开箱即用"。

(2)引入SDK与初始化

魔珐星云的JS SDK采用CDN方式引入,省去了繁琐的npm包管理。

HTML页面只需要这样写:

<!DOCTYPE html>

<html lang="zh-CN">

<body>

<div style="width: 400px; height: 600px">

<div id="sdk"></div>

</div>

<script src="https://media.xingyun3d.com/xingyun3d/general/litesdk/xmovAvatar@latest.js"></script>

</body>

</html>

然后用不到20行代码就能完成SDK初始化:

const LiteSDK = new XmovAvatar({

containerId: '#sdk',

appId: 'your_app_id', // 替换成你的App ID

appSecret: 'your_app_secret', // 替换成你的App Secret

gatewayServer: 'https://nebula-agent.xingyun3d.com/user/v1/ttsa/session',

onMessage(message) {

console.log('SDK消息:', message);

},

onStateChange(state) {

console.log('数字人状态变化:', state);

},

onVoiceStateChange(status) {

console.log('语音播放状态:', status);

},

enableLogger: false // 生产环境建议关闭日志

});

这段代码主要是指定了数字人渲染的容器元素,配置了与星云服务的连接参数,注册了状态变化的回调函数。

注意容器元素必须有明确的宽高,否则会影响渲染效果。我第一次测试时就因为忘记设置高度,导致数字人显示不全。

(3)让数字人"活"起来

初始化完成后,调用init方法建立连接:

await LiteSDK.init({

onDownloadProgress(progress) {

console.log('资源加载进度:', progress + '%');

},

onError(error) {

console.error('初始化错误:', error);

},

onClose() {

console.log('连接已关闭');

}

});

连接成功后,就可以控制数字人说话了:

// 让数字人说一句话

LiteSDK.speak("你好,欢迎使用魔珐星云具身智能平台!", true, true);

这里的第二、三个参数分别表示is_start和is_end,用于标识流式输出的开始和结束。如果是单句话,两个都设为true即可。

3 让数字人做出丰富的KA动作

光会说话还不够,星云支持通过SSML(Speech Synthesis Markup Language)控制数字人做出各种动作。这个功能特别适合打造有个性的虚拟IP。

比如让数字人在说欢迎词时做个挥手动作:

const ssml = `

<speak>

<ue4event>

<type>ka</type>

<data>

<action_semantic>Hello</action_semantic>

</data>

</ue4event>

欢迎来到星云具身3D数字人平台,这里有超多精彩内容等你发现~

</speak>

`;

LiteSDK.speak(ssml, true, true);

这段SSML会让数字人在说话的同时做出"Hello"动作(通常是挥手)。

星云平台提供了KA查询接口,可以查看当前角色支持哪些动作,包括语义KA(如欢迎、再见)和技能KA(如跳舞、鼓掌)。

更强大的是,星云支持流式调用,能够对接大模型的流式输出,假设你在用大模型做对话系统,可以尝试这样处理:

let isFirst = true;

let isLast = false;

// 模拟大模型流式输出

streamFromLLM.on('data', (chunk) => {

if (chunk.done) {

isLast = true;

}

LiteSDK.speak(chunk.text, isFirst, isLast);

isFirst = false;

});

这样数字人就能跟随大模型的输出节奏实时说话,而不是等整段文字生成完才开始,大大降低了交互延迟。

官方建议首次流式调用时积攒一小段内容(比如20-30个字),保证后续数字人说话速度低于大模型输出速度,这样体验更流畅。

4 打造自然的交互循环

星云定义了几种数字人状态,合理切换能让交互更自然:

- idle(待机等待):长时间无互动时的状态。

- interactive_idle(待机互动):交互过程中的循环状态,可用于打断当前动作。

- listen(倾听):用户输入时数字人保持倾听姿态。

- think(思考):用户提问后、数字人回复前的思考状态。

- speak(说话):数字人正在表达。

一个典型的对话流程是:idle → listen → think → speak → interactive_idle。

通过监听onStateChange回调,可以根据业务逻辑在合适时机切换状态:

onStateChange(state) {

if (state === 'speak') {

// 数字人开始说话,可以禁用用户输入

disableUserInput();

} else if (state === 'interactive_idle') {

// 数字人回到待机,可以重新接受输入

enableUserInput();

}

}

还有就是,onVoiceStateChange回调会在音频播放开始和结束时触发,返回voice_start和voice_end事件,结合这两个回调,能精确控制交互流程。

5 情感陪伴虚拟IP

我基于星云SDK做了一个小实验——打造虚拟情感博主"小盈"。她的人设是温柔的倾听者,专门解答粉丝的情感问题。

核心实现思路是:

- 用户通过语音输入问题。

- 调用大模型生成回复文本。

- 将文本通过星云SDK转化为数字人的语音+表情+动作。

- 根据情感分析结果,插入对应的KA动作(比如安慰时的拥抱手势)。

下面是完整的代码流程( 注意需要修改代码中 第 233、234 行 的 CONFIG 配置区域,填入appId和appSecret ):

<!DOCTYPE html>

<html lang="zh-CN">

<head>

<meta charset="UTF-8">

<meta name="viewport" content="width=device-width, initial-scale=1.0">

<title>魔珐星云 Web SDK -- 小盈给你播音呀</title>

<style>

:root {

--primary: #6366f1;

--primary-dark: #4f46e5;

--secondary: #10b981;

--danger: #ef4444;

--dark: #0f172a;

--darker: #020617;

--light: #f1f5f9;

--glass: rgba(15, 23, 42, 0.7);

--glass-light: rgba(255, 255, 255, 0.1);

--glow: 0 0 20px rgba(99, 102, 241, 0.5);

}

* {

box-sizing: border-box;

}

body {

margin: 0;

overflow: hidden;

font-family: 'Segoe UI', sans-serif;

background: var(--darker);

color: var(--light);

}

#sdk {

width: 100vw;

height: 100vh;

background: url('https://images.unsplash.com/photo-1557683316-973673baf926?q=80&w=2029&auto=format&fit=crop') center/cover;

position: absolute;

top: 0;

left: 0;

z-index: 1;

}

#logs {

position: absolute;

top: 20px;

left: 20px;

color: #10f0c0;

background: var(--glass);

padding: 20px;

font-size: 13px;

width: 350px;

height: 220px;

border-radius: 16px;

overflow-y: auto;

pointer-events: none;

font-family: 'JetBrains Mono', monospace;

z-index: 999;

backdrop-filter: blur(10px);

border: 1px solid var(--glass-light);

box-shadow: var(--glow);

}

.log-entry {

margin-bottom: 8px;

line-height: 1.4;

}

.log-time {

color: #8b9bb4;

font-size: 11px;

}

#controls {

position: absolute;

bottom: 40px;

left: 50%;

transform: translateX(-50%);

display: flex;

gap: 12px;

z-index: 999;

background: var(--glass);

padding: 20px 30px;

border-radius: 20px;

backdrop-filter: blur(10px);

border: 1px solid var(--glass-light);

box-shadow: var(--glow);

}

.btn-group {

display: flex;

gap: 8px;

}

.btn-divider {

width: 1px;

background: var(--glass-light);

margin: 0 8px;

}

button {

padding: 12px 20px;

border: none;

border-radius: 12px;

color: white;

cursor: pointer;

font-weight: 600;

transition: all 0.3s ease;

white-space: nowrap;

display: flex;

align-items: center;

gap: 8px;

font-size: 14px;

position: relative;

overflow: hidden;

}

button::before {

content: '';

position: absolute;

top: 0;

left: -100%;

width: 100%;

height: 100%;

background: linear-gradient(90deg, transparent, rgba(255,255,255,0.2), transparent);

transition: left 0.5s;

}

button:hover::before {

left: 100%;

}

button:hover {

transform: translateY(-3px);

box-shadow: 0 8px 20px rgba(0,0,0,0.4);

}

button:active {

transform: scale(0.95);

}

button.action {

background: linear-gradient(135deg, var(--primary), var(--primary-dark));

}

button.state {

background: linear-gradient(135deg, var(--secondary), #059669);

}

button.stop {

background: linear-gradient(135deg, var(--danger), #dc2626);

}

/* 响应式设计 */

@media (max-width: 768px) {

#controls {

flex-direction: column;

width: 90%;

padding: 15px;

}

.btn-group {

justify-content: center;

}

#logs {

width: calc(100% - 40px);

height: 180px;

}

}

/* 滚动条样式 */

#logs::-webkit-scrollbar {

width: 6px;

}

#logs::-webkit-scrollbar-track {

background: rgba(0,0,0,0.2);

border-radius: 3px;

}

#logs::-webkit-scrollbar-thumb {

background: var(--primary);

border-radius: 3px;

}

</style>

</head>

<body>

<div id="logs">

<div class="log-entry">

<span class="log-time">[系统]</span> 准备连接...

</div>

</div>

<div id="sdk"></div>

<div id="controls">

<div class="btn-group">

<button class="action" onclick="doAction('Welcome', '我是小盈,大家好!')">

<span>👋</span> 欢迎

</button>

<button class="action" onclick="doAction('Thanks', '非常感谢您的支持!比心!')">

<span>🙏</span> 感谢

</button>

<button class="action" onclick="doAction('Bye', 'Bye~')">

<span>👋</span> 再见

</button>

</div>

<div class="btn-divider"></div>

<div class="btn-group">

<button class="state" onclick="setListen()">

<span>👂</span> 倾听模式

</button>

<button class="state" onclick="setThink()">

<span>🤔</span> 思考模式

</button>

</div>

<div class="btn-divider"></div>

<button class="stop" onclick="doStop()">

<span>🛑</span> 打断

</button>

</div>

<script src="https://media.xingyun3d.com/xingyun3d/general/litesdk/xmovAvatar@latest.js"></script>

<script>

const CONFIG = {

appId: '这里替换为你的AppID',

appSecret: '这里替换为你的AppSecret',

gatewayServer: 'https://nebula-agent.xingyun3d.com/user/v1/ttsa/session'

};

let avatar = null;

const logDiv = document.getElementById('logs');

function log(msg) {

const time = new Date().toLocaleTimeString();

const logEntry = document.createElement('div');

logEntry.className = 'log-entry';

logEntry.innerHTML = `<span class="log-time">[${

time}]</span> ${

msg}`;

logDiv.appendChild(logEntry);

logDiv.scrollTop = logDiv.scrollHeight;

console.log(msg);

}

async function init() {

log("🚀 开始初始化 SDK...");

try {

avatar = new XmovAvatar({

containerId: '#sdk',

appId: CONFIG.appId,

appSecret: CONFIG.appSecret,

gatewayServer: CONFIG.gatewayServer,

onStateChange: (state) => log(`⚡ 状态: ${

state}`),

onVoiceStateChange: (s) => {

if(s === 'start') log("🔊 开始说话");

if(s === 'end') log("🔇 说话结束");

}

});

log("⏳ 正在下载3D资源(请耐心等待)...");

await avatar.init({

onDownloadProgress: (p) => {

if(p % 10 === 0) log(`📦 下载进度: ${

p}%`);

}

});

log("✅ 初始化成功!请点击下方按钮测试");

setTimeout(() => doAction('Welcome', '我准备好啦!'), 1000);

} catch (err) {

log("❌ 错误: " + err.message);

}

}

function doAction(intent, text) {

if (!avatar) return log("⚠️ 等待初始化...");

const ssml = `

<speak>

<uc4event>

<type>ka_intent</type>

<data>${

intent}</data>

</uc4event>

${

text}

</speak>

`;

log(`▶️ 指令: [${

intent}]`);

avatar.speak(ssml, true, true);

}

function setListen() {

if (!avatar) return;

avatar.listen();

log("👂 进入倾听状态 (Listening)...");

}

function setThink() {

if (!avatar) return;

avatar.think();

log("🤔 进入思考状态 (Thinking)...");

}

function doStop() {

if (!avatar) return;

avatar.interactiveIdle();

log("🛑 已打断");

}

window.onload = init;

</script>

</body>

</html>

实测下来,整个交互流程从用户提问到数字人开始回复,延迟控制在1秒以内(主要耗时在大模型推理),体验非常接近真人对话。

更有意思的是,通过定制不同的角色和音色,可以快速复制这套方案,打造不同人设的虚拟IP。

比如科技博主、健身教练、历史讲解员等等,每一个IP都能"活"起来,真正与粉丝产生情感连接。

6 开发体验与踩坑记录

整体来说,星云SDK的易用性确实不错,但有几个需要注意的细节。

前一次speak的is_end=true之后,不能立即接着speak,中间需要用interactive_idle()或listen()做状态切换,我一开始不知道这个规则,导致第二次speak无效。

SDK中某些方法(如AudioContext)仅支持localhost或https环境,用IP地址访问会报错,开发时记得配置本地域名或用https。

还有就是,iOS的AudioContext初始状态是suspended,需要在用户交互后才能激活。SDK已经处理了这个问题,但如果自己管理音频,要注意这一点。

从技术角度看,星云平台的价值不仅在于降低了具身智能的开发门槛,更重要的是它提供了一套标准化的解决方案,就像当年iOS SDK统一了移动开发生态,星云有潜力成为具身智能领域的事实标准。

体验下来,魔珐星云确实刷新了我对数字人开发的认知。以前觉得做个能说会动的3D数字人得有一整个团队、几个月的开发周期,现在发现十几行代码、一下午时间就能跑起来一个demo。

特别是端侧渲染技术,让具身智能应用可以部署到边缘设备,这对于很多场景(如机器人、车载、展厅)是刚需。

如果你也在探索具身智能方向,强烈建议试试星云SDK,官方提供了完整的文档和demo,上手成本很低。说不定下一个爆款虚拟IP,就出自你手。

想要体验的小伙伴可以点击这个链接进行注册: 全球领先的具身智能3D数字人开放平台 - 魔珐星云

数字人的时代,真的要来了。