从 50 步到 4 步:LightX2V 如何把视频生成拉进20 秒时代?

还在为高质量视频生成「又慢又重」头疼吗?

传统扩散式视频生成模型往往需要20~50步迭代过程,即便生成几十帧的短视频,也需长时间占用GPU资源,日志持续输出却进度缓慢。

而LightX2V的核心目标,是从技术底层重构这一流程:仅需4步推理,即可输出影院级视频效果,推理效率提升20倍以上。

这是一套面向企业级生产环境的视频生成推理优化方案。

LightX2V 是什么?

LightX2V 是一个先进的轻量级视频生成推理框架,专为提供高效、高性能的视频合成解决方案而设计。该统一平台集成了多种前沿的视频生成技术,支持文本生成视频(T2V)和图像生成视频(I2V)等多样化生成任务。X2V 表示将不同的输入模态(X,如文本或图像)转换为视频输出(V)。

它有两个非常务实的设计选择:

- 非重复造轮子:不进行从零开始的模型构建,而是针对HuggingFace平台下载量领先、社区认可度最高的视频生成基线模型开展优化;

- 为部署而生:从一开始就假定这是要跑在企业、生产环境里的东西,而不是只跑在论文里的理想实验」

所以,LightX2V 更像是一套「高质量视频生成部署增强包」。

在技术路径上,LightX2V基于Self-Forcing/Plus方法,结合步数蒸馏与Classifier-Free Guidance(CFG)蒸馏技术,适用于自回归与双向视频生成模型,支持从1.3B到14B的模型规模,并覆盖文生视频(T2V)与图生视频(I2V)任务。

为什么要做 4 步蒸馏?

传统扩散模型迭代步数多,导致推理延迟高、计算资源消耗大。LightX2V的4步蒸馏技术旨在解决此瓶颈。其关键创新点在于:

- 连续时间一致性蒸馏:让 4 步模型在整个采样时间维度上与原模型保持行为一致,不是只在个别离散点上对齐。

- 潜在对抗蒸馏:在潜空间中加入对抗训练,让蒸馏后的模型不仅快,而且生成结果依旧锐利、自然、不糊。

最终实现的效果为:推理步数从数十步降至4步,生成耗时从分钟级压缩至20秒内,画质指标仍保持行业领先水平。

LightX2V 的步数蒸馏是怎么做的?

LightX2V 的目标很直接:把经典扩散 / 自回归视频模型从 几十步压到 4 步,同时尽量维持纹理、运动、色彩的一致性。它主要做了三件事:

1、沿用 DMD / DMD2 的分布匹配蒸馏思路

不直接改采样器,而是通过蒸馏,让一个 4 步学生模型在潜空间分布上逼近原始多步模型,避免变成“快但画面发糊”的玩具模型。

2、用 Self-Forcing 方式适配到视频场景

每次只在少量时间步上计算梯度,并结合 ODE 初始化,重点提升中间时间步的去噪质量和时序连贯性,让压步之后的视频不容易抖、不卡帧。

3、工程上把“4 步”做成可直接用的配置

在约 5 万条高质量 prompt 上完成蒸馏训练,提供完整的 T2V / I2V 配置与脚本,默认就是 infer_steps = 4 的推理逻辑,同时兼容 LoRA、int8/fp8 量化 等常见部署实践。

最终在工程可接受的训练成本下,把 40–50 步推理压缩至 4 步,在 Text2Video与Image2Video 场景下实现约 20× 的推理加速,且画面主观观感无显著损失,具备直接嵌入企业真实业务流程的能力。

一键体验视频生成

您可通过Lab4AI平台一键复现项目效果。平台提供了预配置的环境与Notebook教程,用户可快速运行示例,亲身体验4步生成的效果与速度。

Step 1 进入项目

在 Lab4AI 平台中:搜索或点击对应项目 「LightX2V 4 步蒸馏模型」,点击 「立即体验」,推荐使用1卡GPU即可。

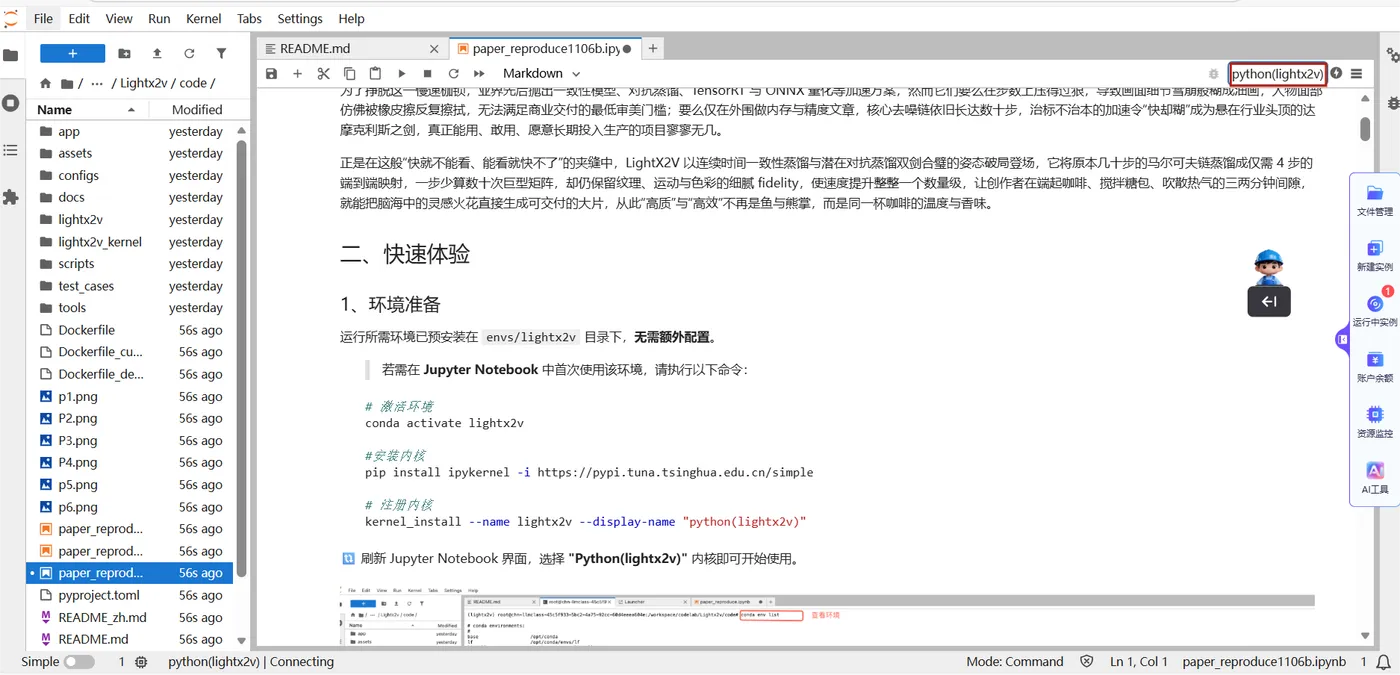

Step 2:打开复现 Notebook

进入工作区后:

打开路径:codelab/Lightx2v/code/

找到并打开:paper_reproduce1106b.ipynb

参考文档准备好环境后,在 Notebook 中选择内核:Python(lightx2v),即可进行快速体验

Step 3:跑推理 Demo,亲眼看一眼 4 步的效果

在 Notebook 的 推理 Demo 部分,可以直接运行四类示例:

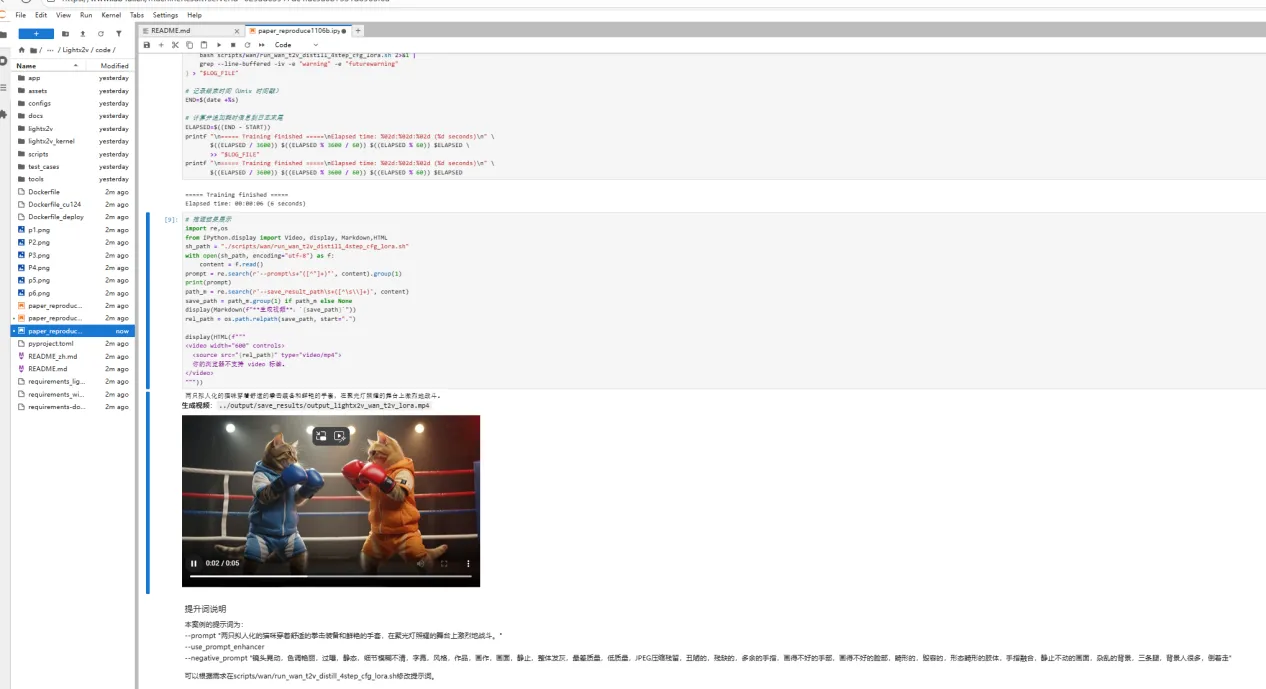

①文生视频(Text2Video):步数蒸馏的完整模型推理

提示词示例:"两只拟人化的猫咪穿着舒适的拳击装备和鲜艳的手套,在聚光灯照耀的舞台上激烈地战斗。"

纯推理时长:约 19 秒(总耗时约 125 秒,含加载与数据处理)

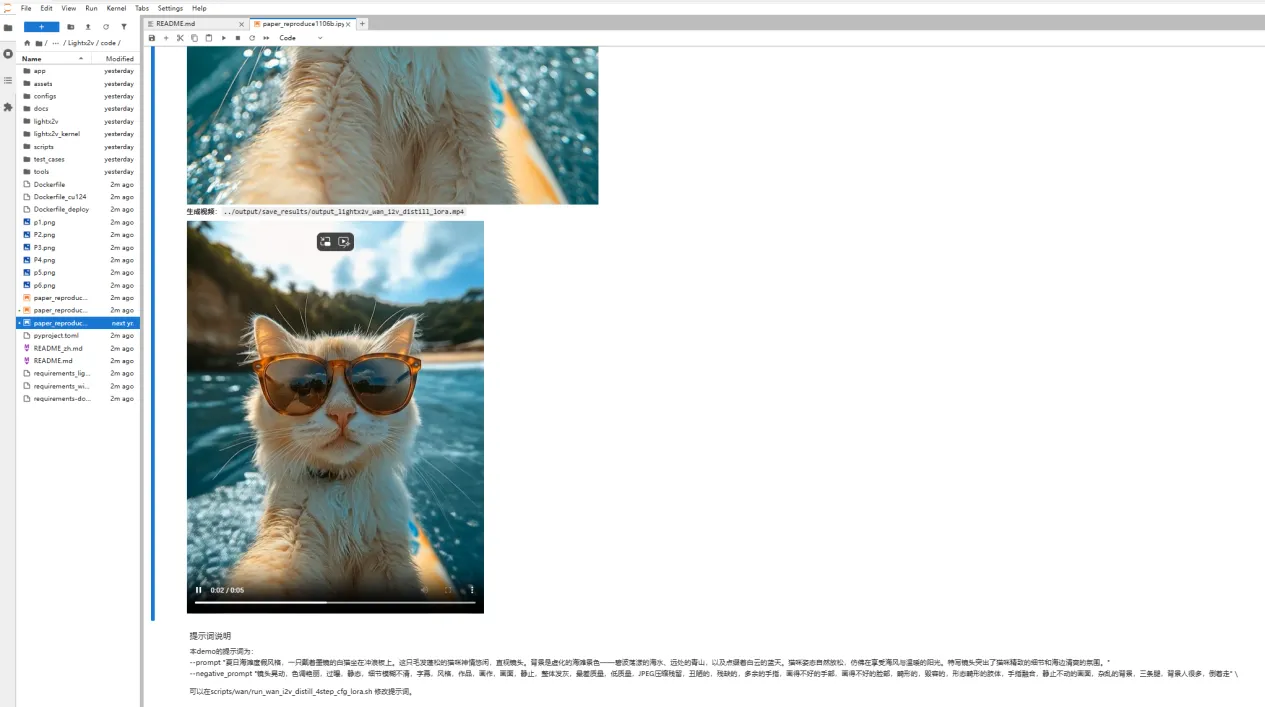

②图生视频(Image2Video):步数蒸馏的完整模型推理

提示词示例:“夏日海滩度假风格,一只戴着墨镜的白猫坐在冲浪板上。这只毛发蓬松的猫咪神情悠闲,直视镜头。背景是虚化的海滩景色——碧波荡漾的海水、远处的青山,以及点缀着白云的蓝天。猫咪姿态自然放松,仿佛在享受海风与温暖的阳光。特写镜头突出了猫咪精致的细节和海边清爽的氛围。”

纯推理时长:约 17 秒

③文生视频(Text2Video): Wan-T2V 模型 + 步数蒸馏 LoRA模型推理

在原始Wan-T2V基线模型上叠加步数蒸馏LoRA模块,纯推理耗时约20秒,支持根据业务需求更换LoRA实现风格/领域定制化生成

④图生视频(Image2Video):Wan-I2V 模型 + 步数蒸馏 LoRA模型推理

以单张图片为输入起点生成海边猫咪度假主题视频,

纯推理时长:约 19 秒

所有提示词与 negative prompt 参数,都可以在对应脚本中进行自定义修改。

如果你更喜欢在终端里操作,也可以参考复现文档,直接执行 bash 脚本,实现一键式视频生成。

让高质量视频生成,真正跑起来

过去,大家在做视频生成时,难免有一种无奈:模型效果很好,就是不太适合落地。

LightX2V 想做的,就是把这句话变成:效果不错,而且还能跑得很快。它不试图重新定义视频生成的全部,只是专注做好一件事:在不牺牲质量的前提下,把高质量视频生成真正拉进可部署、可扩展、可普及的区间。

如果你正在做多模态、内容生成、AIGC 产品,或者希望用更高效的方式玩转视频生成,不妨在 Lab4AI 上把这个项目跑一跑,看一看 4 步蒸馏能给你的业务带来多少想象空间。

更重要的是,在 LightX2V 背后,Lab4AI 不只是提供“一键复现”的实验环境,Lab4AI 不只是提供“一键复现”的实验环境,还在做一件更重要的事:把这些前沿能力打包成真正「可用、可学、可复用」的技术资产。

除了一键复现,Lab4AI 还能带来什么?

大模型实验室Lab4AI实现算力与实践场景无缝衔接,具备充足的H卡算力,支持模型复现、训练、推理全流程使用,且具备灵活弹性、按需计费、低价高效的特点,解决用户缺高端算力、算力成本高的核心痛点。